微软专利介绍控制计算机生成表情的方法,提高Avatar社交性

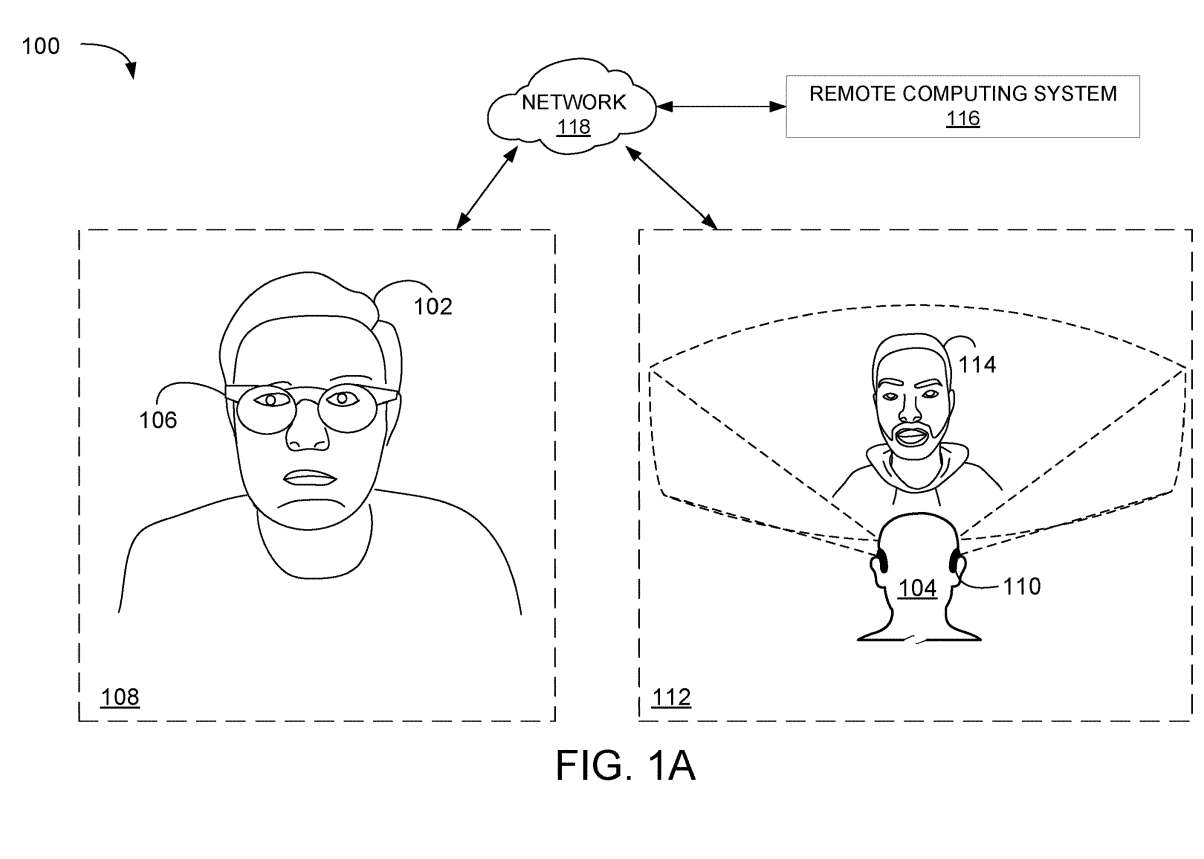

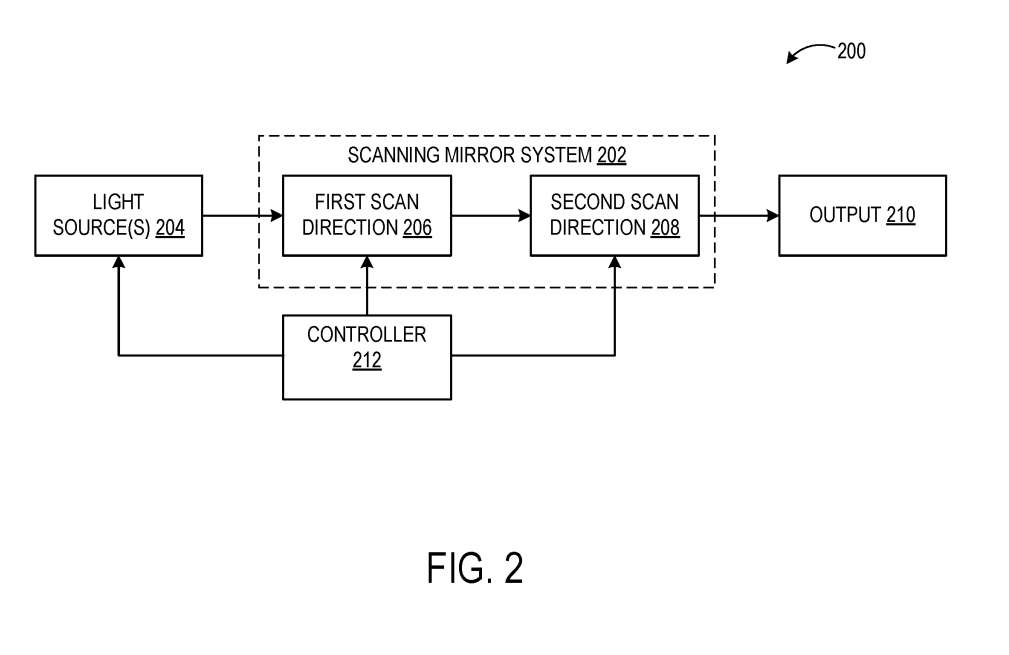

微软在两份同名为“Controlling computer-generated facial expressions”的专利申请中介绍了一种控制计算机生成表情的方法,以提高Avatar的社交性。该方法利用面部追踪传感器获得的传感器数据,将信号映射到代表Avatar面部表情的混合形状,并通过显示设备来显示Avatar的面部表情动画。头戴式设备包括面部追踪传感器、眼动追踪摄像头和麦克风,用于获取面部landmark的运动数据和音频数据。Avatar动画服务利用融合模块处理传感器数据,并向设备提供表情数据。

这种方法可以根据用户的面部动作生成逼真的Avatar表情,并能够将不同面部区域的运动连接起来,使不同位置的运动相互影响,提高Avatar的真实性和社交性。通过综合多个传感器的数据,可以更准确地捕捉用户面部表情的细节,从而提供更自然的动画效果。该技术有望应用于增强现实(AR)和虚拟现实(VR)等XR环境中,改善用户与Avatar之间的交互体验。