Meta正式推出IOBT和Generative Legs,用AI支持全身Avatar

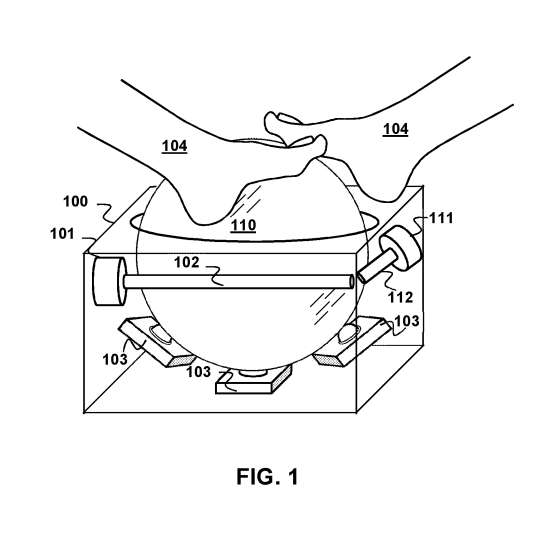

Meta早前发布的Inside-Out Body Tracking(IOBT)和Generative Legs已经正式通过v60支持Unity和Native(Unreal待支持),现在开发者可以实现逼真映射用户动作的全身Avatar。目前大多数头显只能追踪用户的头和手,而Meta的全新消费者头显Quest 3可以利用多个前置摄像头和先进的计算机视觉算法来追踪上半身,精确追踪手腕、手肘、肩膀和躯干,称之为内向外身体追踪(IOBT)。此外,Meta还提供了Generative Legs/生成式双腿,通过人工智能模型估算双腿的位置,可以提供更精确的双腿估计。不过由于只是估算,Generative Legs目前只能支持粗略的行走、跳跃、蹲下等动作。现在开发者可以同时结合Inside-Out Body Tracking(IOBT)和Generative Legs,并实现能够逼真映射用户动作的全身Avatar。此外,Meta还在不断优化Quest系统,包括在10月推出了Mesh API和实验性版本的Depth API,提高混合现实的交互和真实感。