Meta发布Llama 3.3,体积更小、性能更强

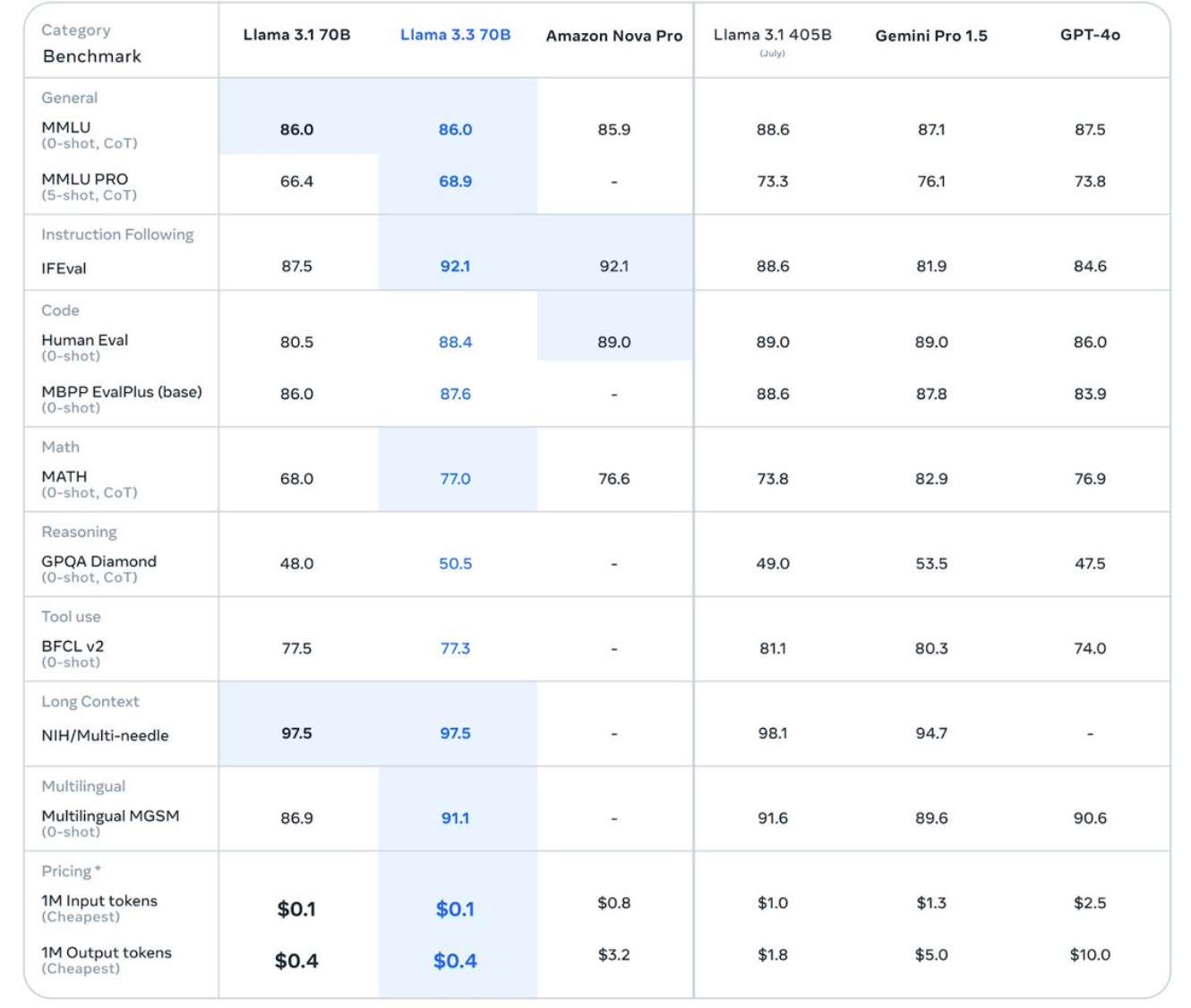

Meta的生成式AI副总裁Ahmad Al-Dahle正式发布了新的算法模型Llama 3.3。与之前版本相比,Llama 3.3体积更小、性能更强。此前Meta与高通合作,旨在优化Llama 3.3在智能手机、VR/AR头显等骁龙终端设备上的执行效果。随着Llama 3.3的发展,Meta预计Quest头显和AR眼镜等设备的AI性能有望进一步提升。据介绍,Llama 3.3仅有700亿参数,但性能与之前开源的Llama 3.1的4050亿参数模型相当,而部署和推理成本大幅降低,输入成本降低10倍,输出成本降低近5倍。通过最新的后训练技术,Llama 3.3在显著降低成本的同时提高了核心性能。据发布的图表显示,Llama 3.3 70B模型在多个基准测试中优于谷歌的Gemini 1.5 Pro、OpenAI的GPT-4o和亚马逊的Nova Pro,并具有较大的成本优势。详细信息请访问官方网站。