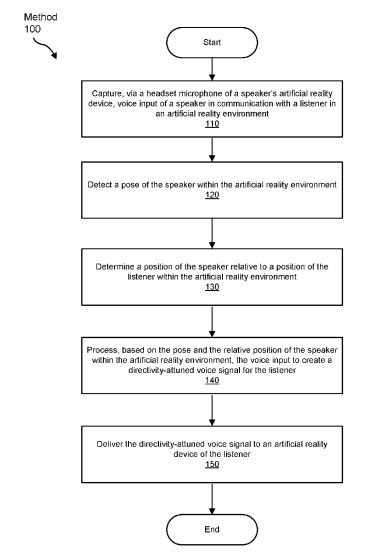

近日,美国专利及商标局公布了一批全新的AR/VR专利,共有78篇。其中一些专利包括Meta关于语音指向性再现和低密度奇偶校验编码的专利,以及显微网关于发光二极管中蚀刻保护和量子机械隔离的专利。另外还涉及到了用于用户与辅助系统交互的手势识别、控制和在虚拟世界之间旅行的虚拟个人界面、根据语音进行三维人脸动画化,以及浏览器支持在人工现实中切换虚拟世界等专利。这些专利涵盖了AR/VR领域的多个方面,包括用户交互、显示技术、感知和影音处理等。这些专利的公布显示了XR技术在不断创新和发展,为用户提供更好的虚拟体验。《Apple专利 | 注视行为检测》涉及一种通过眼睛和头部数据来识别注视行为状态的方法。该方法可以用于识别注视转移事件、注视保持事件和丢失事件。

《Apple专利 | 使用头部姿势控制设备设置》描述了一种使用头部姿势进行用户输入的方法。该方法中,头戴设备的显示器可以显示具有指示器的滑块,滑块可以用于表示设备设置的标量。根据头部姿势的变化,可以更新滑块上设备设置的标量和指示器的位置。

《Apple专利 | 带变形传感器的电子设备》描述了一种具有变形传感器的头戴式设备。该设备可以具有立体光学部件和变形传感器电路,用于补偿摄像头和显示系统的指向矢量未对准的测量变化。

《Apple专利 | 具有透镜位置感应功能的电子设备》涉及一种具有透镜位置感应功能的头戴式设备。该设备可以使用瞳孔间距离信息来调整透镜组件的位置,并使用感测电路来确保透镜组件不会施加过大的力。

《Apple专利 | 光学传感系统的处方镜片配准和切换》描述了一种识别处方镜片是否匹配的方法。系统可以识别处方镜片的处方,并与用户注册处方进行比较,以确定是否切换处方镜片。

《Apple专利 | AR地图》涉及一种在手持通信设备上显示增强现实地图的方法。该方法可以捕获实时视频流,检测设备的位置和摄像头方向,并在视频流上叠加指示符来指示前往感兴趣点的方向。

《Google专利 | 集成到达角数据的设备追踪》涉及一种使用到达角数据和惯性数据来识别设备姿态的方法。头戴式显示器使用数据集成技术将到达角数据与惯性数据融合。

《Google专利 | 基于眼动追踪的列表导航》描述了一种基于眼动追踪的列表导航方法。该方法可以在显示器上显示多个位置,并根据注视点的移动来显示列表元素的不同子集。

《Google专利 | 使用神经渲染的体积性能捕获》涉及一种使用神经渲染器进行体积性能捕获的方法。该方法使用深度数据和视图数据来生成描绘对象的输出图像。

《Sony专利 | 图像生成装置、图像生成方法和程序》描述了一种通过识别用户身体来生成图像的设备。设备可以识别用户的身体骨架并基于骨架生成图像。

《Sony专利 | 用于从捕获的图像数据中识别人的姿势的信息处理设备、方法、程序和记录介质》涉及一种从图像数据中识别人姿势的方法。该方法包括提取人的轮廓、提取特征量、估计姿势和确定估计精度。

《Sony专利 | 触觉反馈系统和方法》描述了一种触觉反馈方法。该方法包括使用骨传导触觉反馈单元来驱动音频信号以实现触觉反馈。

《Sony专利 | 显示装置》涉及一种用于通过反射全息透镜传送图像的显示设备。该设备包括导光板和反射全息透镜,可将对象图像传送到观察者的眼睛。

《Sony专利 | 信息处理设备、信息处理方法和记录介质》描述了一种通过视图信息来估计位置的方法。该方法可以使用预定成像部分捕获的图像来估计位置。

《Sony专利 |对用户在与虚拟现实内容交互时的不适程度进行分类》涉及一种用于分类虚拟现实内容用户不适程度的方法。该方法使用模型来识别可能引起不适的虚拟现实内容,并通知用户切换虚拟现实内容。

《Samsung专利 | 用于视频透视AR的视频渲染的方法和设备》描述了一种用于视频透视增强现实的视频渲染方法。该方法可以捕获图像并基于摄像头姿势和相对位置生成虚拟视图。

《Samsung专利 | 在虚拟环境中处理安全虚拟事件的方法和电子设备》涉及一种用于在虚拟环境中处理安全虚拟事件的方法。该方法可以基于输入和虚拟事件的性质来识别参与虚拟事件的用户化身。

《Samsung专利 | 用于提供扩展观看窗口的显示设备》描述了一种能够提供扩展观看窗口的显示设备。该设备包括导光板,用于在不同角度上传播图像。

《Samsung专利 | 显示模块及其头戴式显示设备》涉及一种显示模块。该模块包括多个发光元件和密封元件,密封元件具有不同深度的图案。

《Qualcomm专利 | 保护用户健康避免其过度沉迷元宇宙》描述了一种基于用户生物特征来预防过度沉迷于元宇宙的系统。系统通过监测用户的生物特征,例如血氧饱和度、心率等,来调整元宇宙的呈现方式。

《Qualcomm专利 | 扩展现实设备中的对象检测和追踪》涉及一种在扩展现实环境中检测和追踪对象的方法。方法可以通过识别对象的参数来对准和追踪对象的移动。

《Qualcomm专利 | 扩展现实数据的物理层关联》描述了一种物理层关联扩展现实数据的方法。方法可以基于数据集合来识别数据单元是否属于网络通信的一部分。

《Qualcomm专利 | 注视点压缩的方法和装置》涉及一种注视点压缩的方法。方法涉及对图像进行缩减和编码,并在解码后将图像进行upscale。

《Snap专利 | 全身分割》描述了一种基于图像生成全身分割的方法。方法涉及识别人的姿势并应用视觉效果。

《Snap专利 | 增强现实图像再现助手》涉及一种图像再现助手。助手使用增强现实技术在物理画布上生成数字图像。

《Snap专利 | 双摄像头流》描述了一种捕获和处理双摄像头流的方法。方法可以同时保存第二摄像头的图像流,并对其应用增强现实效果。

《Snap专利 | 虚拟自拍杆》涉及一种生成虚拟自拍杆图像的方法。方法使用设备的光学传感器生成原始自拍图像,并基于用户的姿势和移动来生成虚拟自拍杆图像。

《Snap专利 | 在新位置应用预生成的虚拟体验》描述了一种在新位置应用预生成虚拟体验的方法。方法基于先前捕获的真实环境的图像和与新环境相关的图像来生成虚拟体验。

《Snap专利 | 从姿势和语音输入推断意图》涉及一种从姿势和语音输入中推断意图的方法。方法基于图像中的姿势和语音输入来执行相应意图的操作。

《Snap专利 | 3D渲染对象的光线估计方法》描述了一种用于估计3D渲染对象光线的方法。方法使用预训练的机器学习模型和配对数据集来估计照明参数,并将其应用于虚拟对象的渲染。

《Snap专利 | 为三维渲染对象估计光照的方法》描述了一种估计三维渲染对象光照的方法。方法使用机器学习模型和合成数据集来估计照明参数,并将其应用于虚拟对象的渲染。

《Snap专利 | 从点云数据中识别物体边界的方法》描述了一种从点云数据中识别物体边界的方法。方法基于点云数据生成特征图并识别边界。

《Snap专利 | 表情识别和纹理处理方法和装置》涉及一种表情识别和纹理处理的方法。方法使用神经网络来识别表情并将纹理映射到人脸上。

《Snap专利 | 实时感兴趣区域检测方法和系统》描述了一种实时感兴趣区域检测的方法。方法使用深度学习模型来检测感兴趣区域。

《Snap专利 | 在虚拟现实场景中交互的头戴设备和方法》涉及一种用于在虚拟现实场景中交互的头戴设备和方法。头戴设备可以识别用户的手势,并在虚拟场景中相应地触发操作。

以上是《Snap专利 | 应用姿势和语音输入来推断意图》的内容。Snap专利描述了使用增强现实(AR)的机器人学习装配任务的方法。这个方法包括在AR设备的显示屏上显示第一个虚拟对象,并跟踪用户对该对象的操作。然后根据跟踪数据识别该对象的初始状态和最终状态,并使用这些数据编程机器人系统。另一个Snap专利描述了一种用于创建共享AR会话的方法和系统。该方法包括接收用户选择共享AR体验的输入,并确定与所选择的体验相关联的资源。该系统还通过检测用户在阈值附近的位置来激活所选择的共享AR体验。其他专利涉及低功耗手部追踪系统、增强现实波导、透视增强现实环境的颜色校准工具、增强现实骑程生成、可穿戴设备定位系统、头戴式显示器眼动追踪器、选择性照明的光学系统、光学验证表面的方法、图像光导和头戴式显示设备等。这些专利展示了Snap在AR和可穿戴设备领域的创新技术。