高通提出用于立体视频串流LLSS的低延迟神经编解码器

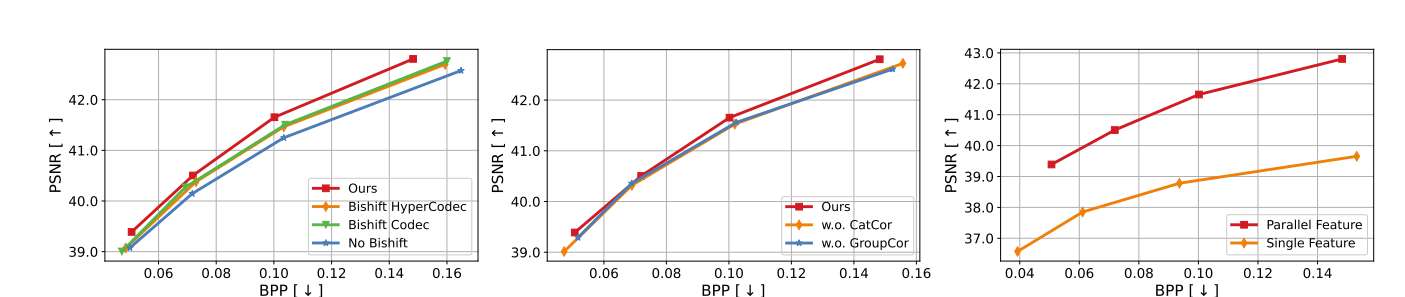

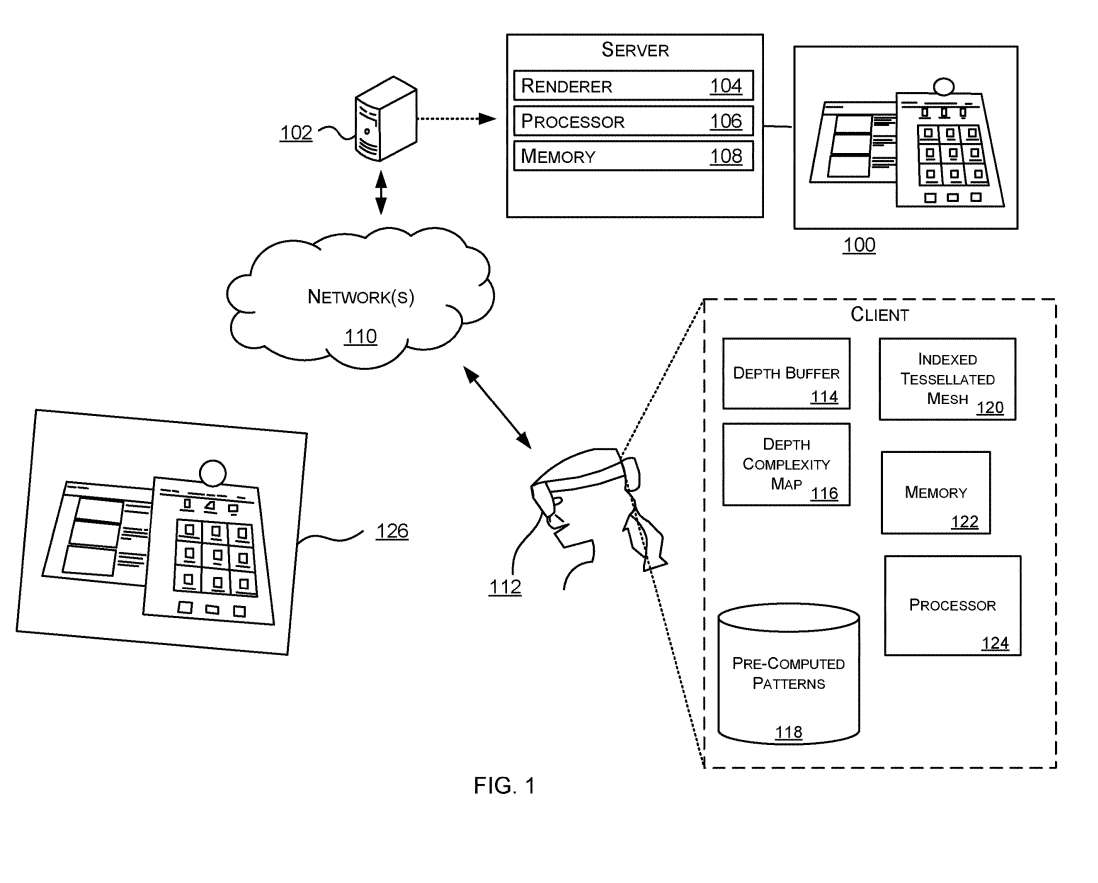

高通在虚拟现实等新视频模式的兴起中提出了一种低延迟神经立体视频压缩方法,称为LLSS。与传统方法不同,LLSS引入了双向特征移位模块,通过视图之间的相互信息和交叉视角先验模型进行编码,旨在实现快速高效的低延迟立体视频串流。该方法减少了延迟,并且相比于现有的神经和传统编解码器,性能得到了显著提高。

现有的立体视频编码方法采用了分别编码左右视图的单视图编解码器,而LLSS通过并行处理左右视图有效降低了延迟,同时利用视差补偿减少了视图之间的冗余。LLSS编解码器的开发采用了双向移位模块,促进了视图之间的连接和信息交换,实现了低延迟推理。研究表明,与最先进的方法相比,LLSS在立体视频基准上大幅提高了R-D性能。

总的来说,LLSS是一种低延迟的神经立体视频压缩方法,可以同时压缩左右视图,通过双向移位模块和并行自编码器来降低比特率和提高帧质量。