(

映维网Nweon

2024年11月22日

)Meta正在为XR头显开发合适的面部追踪功能。在一份专利申请中,这家公司介绍了一种用于面部追踪的短程雷达解决方案。

在一个实施例中,雷达天线可用于面部追踪,并配置为极短距离雷达。所述雷达配置为感知小于100毫米的对象。接收雷达天线可用于接收雷达返回信号,并将雷达返回信号与包含在表情数据库中的选定表情信号相匹配。然后可以将与所选表情信号相关联的表情动画发送到Avatar。

Meta指出,通过使用雷达技术代替摄像头进行面部追踪,这可以减少电能、减少处理资源、缩短处理时间来识别用户表情。另外,使用雷达技术可以降低对环境光条件的敏感性,并在遮挡发生时提供更好的结果。

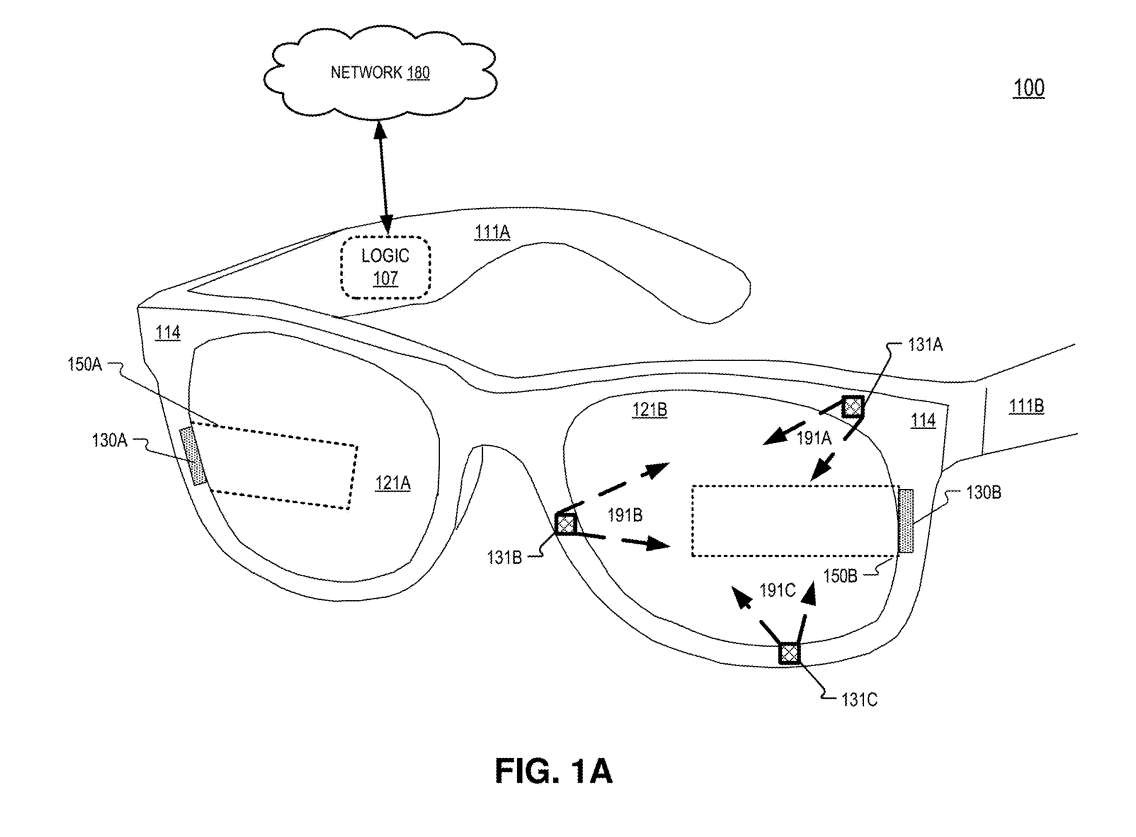

图1A示出了一种头戴式显示器 100。头显100包括连接到镜臂111A和111B的框架114。透镜组件121A和121B安装到框架104。透镜组件121A和121B可包括与头显100的特定用户匹配的处方镜头。

在图1A所示的头显100中,每个透镜组件121A/121B包括显示波导150A/150B,用于将显示器130A/130B产生的图像光引导到视窗区域。例如,显示器130A/130B可包括包括扫描镜的波束扫描显示器。

透镜组件121A和121B可以对用户显示为透明,以支持用户感知周围环境,同时接收通过波导150定向到眼睛的图像光。透镜组件121A和121B可包括用于不同功能的两个或多个光学层,例如显示、

眼动追踪

和面部追踪。

在一个实施例中,来自显示器130A或130B的图像光仅引导到头显用户的一只眼睛中。在实施例中,两个显示器130A和130B分别用于将图像光引导到波导150A和150B中。框架114和镜臂111可以包括头显100的支持硬件。

图1A示出设置在头显100不同位置的雷达传感器131A、131B和131C(统称为雷达传感器131)。在不同的实施方案中,可以在头戴式设备中实施更多或更少的雷达传感器131。

雷达传感器131A发送传输指向面部区域的雷达信号191A。雷达传感器131B和雷达传感器131C同时可以产生指向面部区域的传输雷达信号191B和191C。

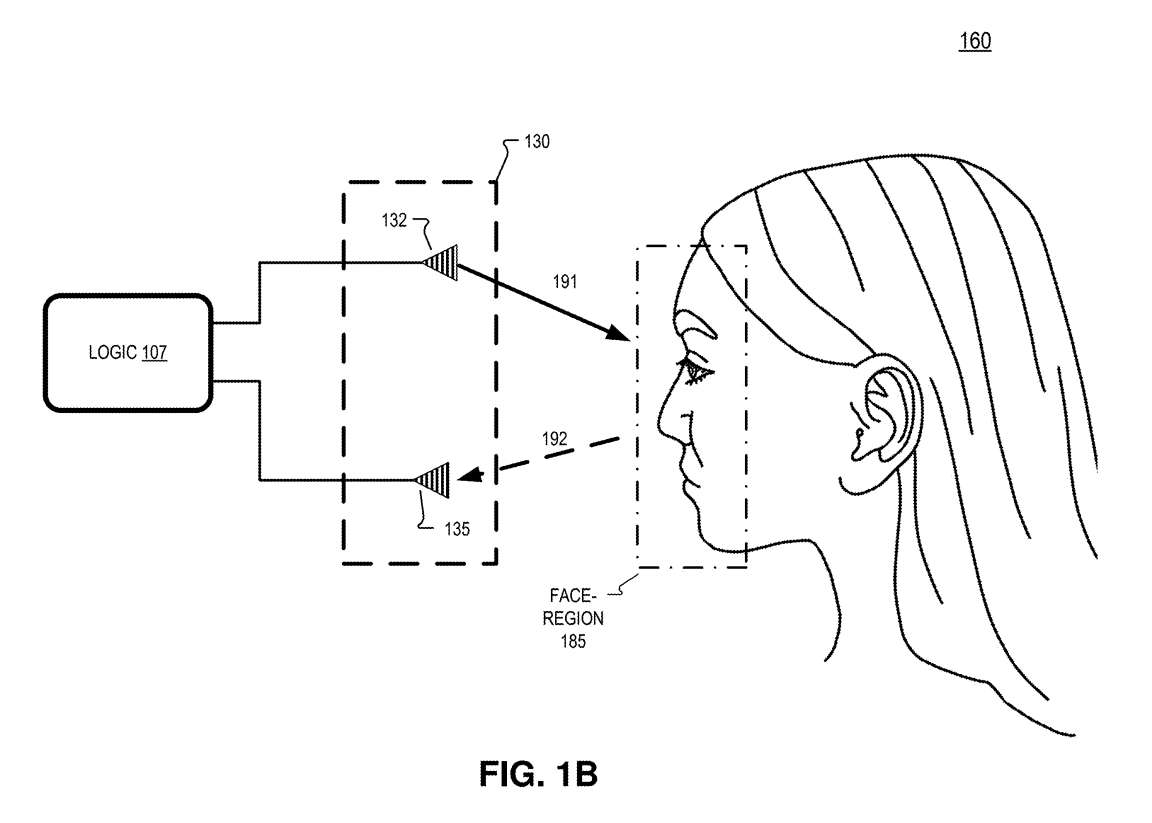

图1B示出具有处理逻辑107驱动雷达发射天线135可以将发射雷达信号191传输到面部区域185。发射雷达信号191可以从面部反射/散射,并作为返回雷达信号192传播回雷达接收天线135。然后,处理逻辑107可以接收来自雷达接收天线135的返回雷达信号192。

在图1B中,雷达传感器130中包括雷达发射天线132和雷达接收天线135。例如,雷达传感器130可以封装在单个电子芯片中。在其他实施例中,雷达接收和/或发射天线位于雷达传感器的外部,并耦合到雷达传感器。

在一个施例中,系统160包括一个雷达发射天线和一个以上雷达接收天线。当考虑到占空比时,雷达传感器的功耗为10mw或更低。发射雷达信号191可能在5ghz ~ 100ghz范围内。在一个实施例中,传输雷达信号191在55 GHz到80 GHz之间。发射雷达信号191可以chirp。可以改变诸如带宽、斜率、chirp重复时间和帧重复时间等参数,以感知面部区域的不同方面。

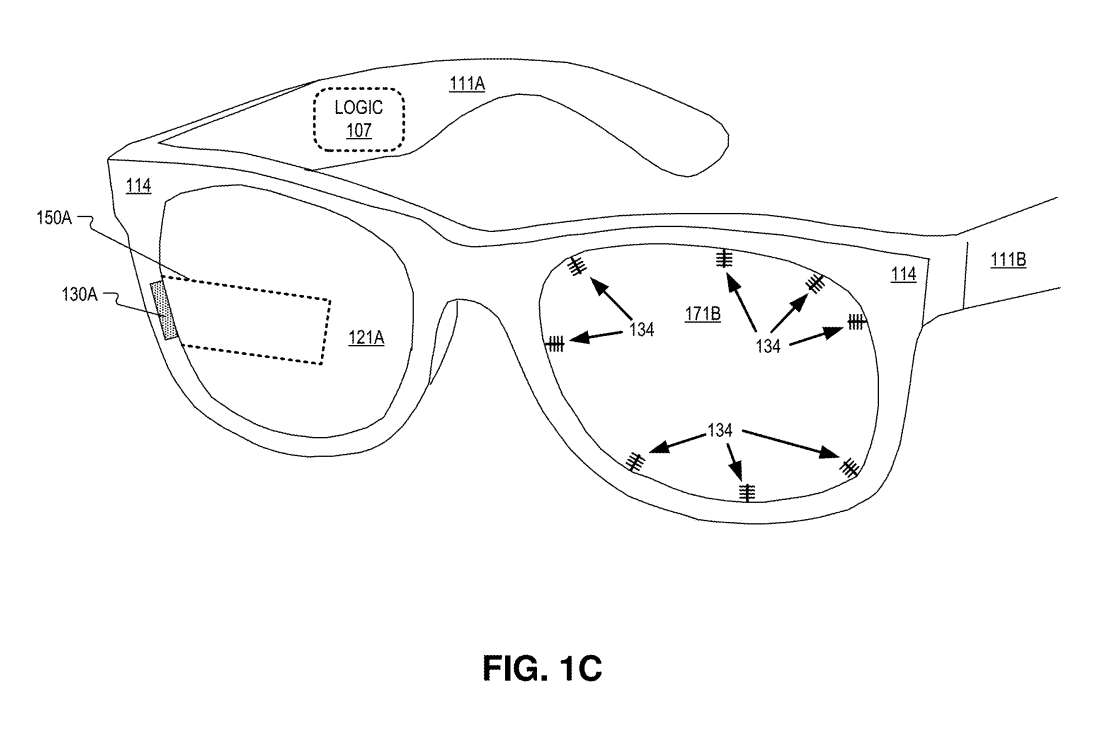

图1C示出的头戴式设备190包括设置在透镜层171B中的雷达天线134。尽管雷达天线134设置在用户的视场中,但用于形成天线的导体对于用户而言可能是不引起注意的。形成雷达天线134的导体可以是透明的、半透明的或不透明的。在一个实施例中,对可见光基本上透明的半导体形成雷达天线134的迹线。例如,雷达天线134可包括氧化铟锡或铜。

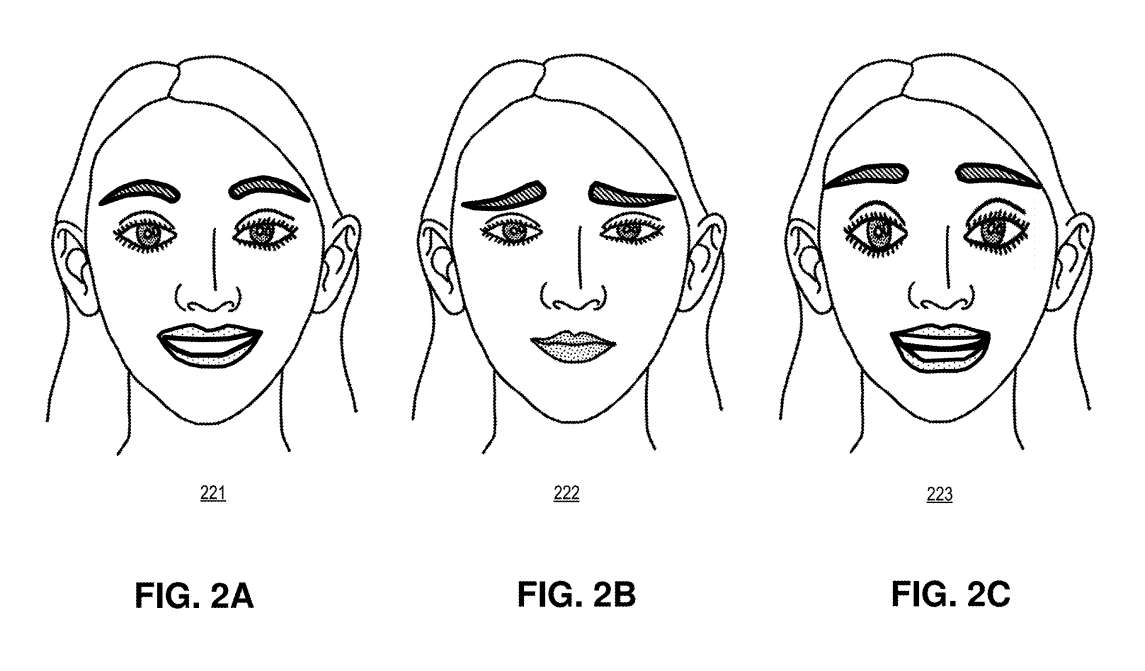

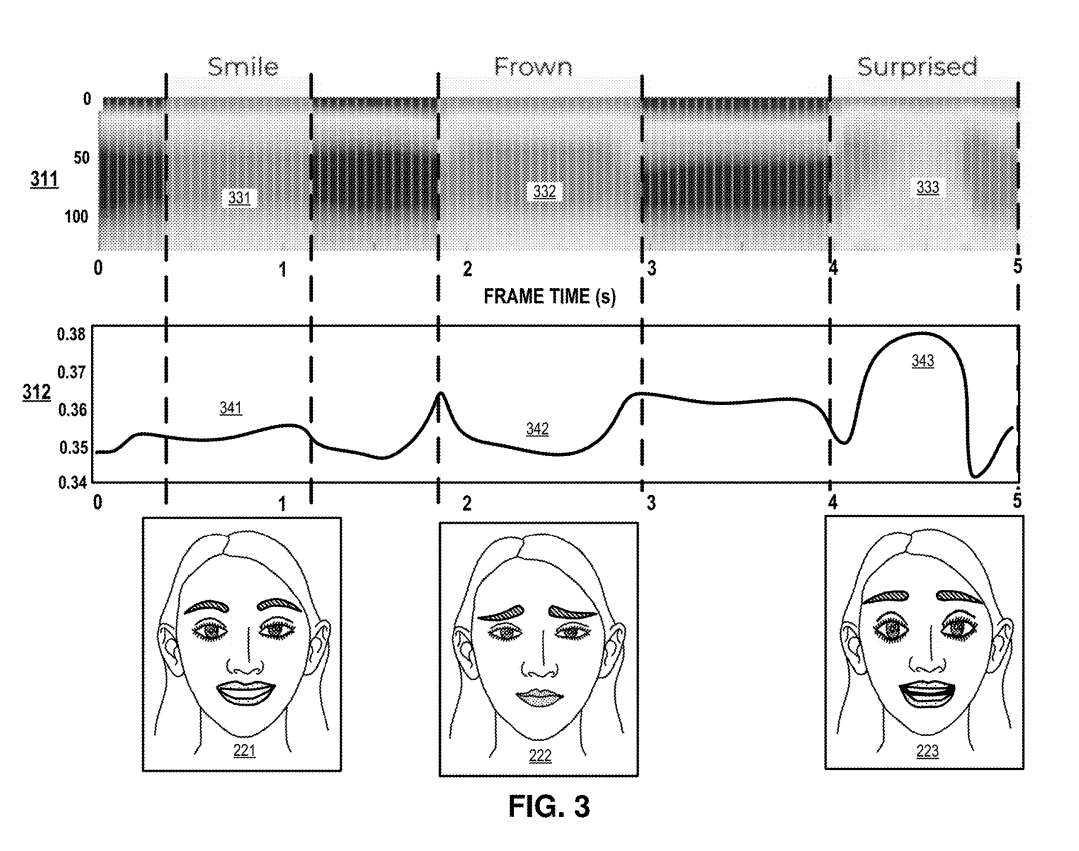

图2A-2C给出三个面部表情的例子。图2A示出微笑的人221;图2B显示了一个皱眉的人222;图2C显示了一个惊讶的人。

图3示出了对应于面部表情的雷达信号。信号311显示了一个原始的chirp返回雷达信号311超过五秒的周期。信号312是从原始chirp返回雷达信号311在相同的5秒周期内提取的特征,其特征幅度在0.34和0.38单位之间。

在所示实施例中,当面部区域包括微笑的人221时,原始chirp返回雷达信号311的部分331和信号312的部分341是由一个或多个雷达接收天线接收的返回雷达信号。

同样,当面部区域包括皱眉的人222时,原始chirp返回雷达信号311的部分332和信号312的部分342是由一个或多个雷达接收天线接收的返回雷达信号,而当面部区域包括惊讶的人223时,信号312的部分343是由一个或多个雷达接收天线接收的返回雷达信号。

因此,雷达返回信号可以指示用户的面部表情。

在图3中,信号311和312包括所述区域在一段时间内的深度、运动和位移的测量。在一个实施例中,指示某个表情的返回雷达信号在一秒或更短的时间段内进行测量。

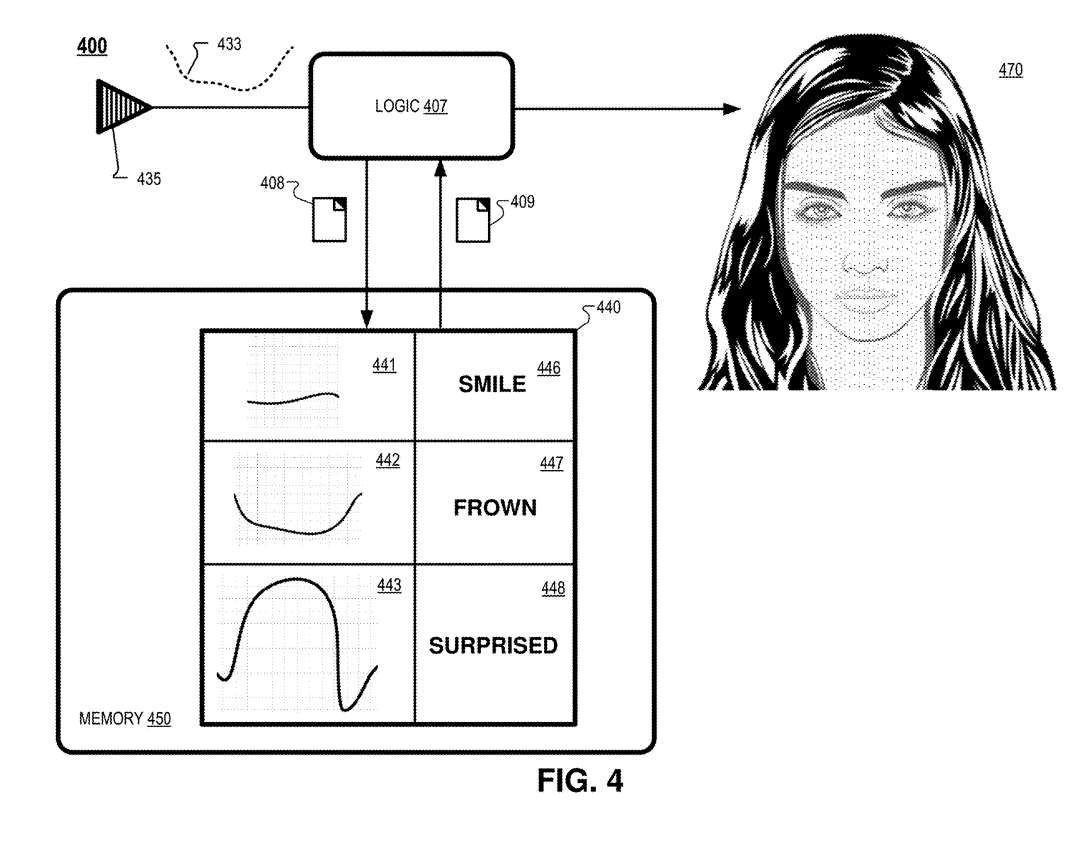

图4示出响应返回雷达信号来动画化Avatar的系统400。系统400包括雷达接收天线435、处理逻辑407和存储器450。例如,雷达接收天线435可包括在雷达传感器中。多个雷达接收天线包括在系统400中。在图4的示例中,处理逻辑407通信耦合到存储器450,并且存储器450可以包括在头戴式设备中。

在操作中,处理逻辑407可以接收来自雷达接收天线435的返回雷达信号433。处理逻辑407接收来自系统400中所包括的多个雷达接收天线的返回雷达信号433。处理逻辑407可将基于返回雷达信号433的查询408发送到存储器450,以将返回雷达信号433与存储在表达式数据库440中的多个表情信号中所包含的选定表情信号相匹配。

在图4中,表情信号包括微笑表情信号441、皱眉表情信号442和惊讶表情信号443。同样在图4的示例示例中,表情数据库440中的每个表情信号与选定的Avatar表情相关联。微笑表情信号441与表情446相关联,皱眉表情信号442与表情447相关联,惊讶表情信号443与表情448相关联。

因此,如果所选表情信号为微笑表情信号441,则所关联的Avatar表情为微笑表情446,所述返回409中包含微笑表情446。然后,处理逻辑407可以用返回409中包含的表情来动画化Avatar470。

在一个实施例中,将返回雷达信号与所选表情信号的匹配包括将返回雷达信号与多个表情信号进行比较。所选的表情信号可以是数据库440中多个表情信号中最接近的比较。

在所示示例中,返回雷达信号433可能最接近皱眉表情信号442。所以,皱眉表情信号442是所选的表情信号,皱眉表情447是所选的表情并包含在返回值409中。然后,处理逻辑407可以用所选的Avatr表情来动画化Avatar470动画化。

尽管可以利用摄像头和图像来分别将表情信号441、442和443与Avatar表情446、447、448相关联,但在建立数据库440之后,不需要图像和摄像头来确定一个人的表情。相反,雷达特征(例如信号433)可以用来确定用户的表情。

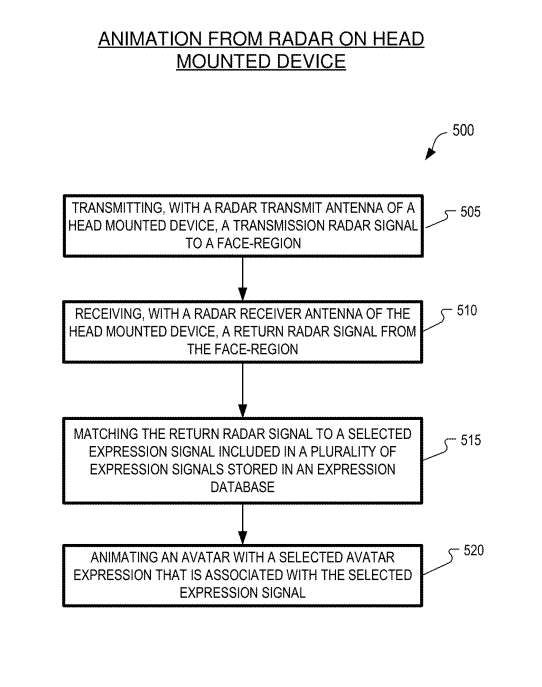

图5示出相关的流程图:

在505,头戴设备的雷达发射天线将发射雷达信号发送到面部区域。

在510,头戴设备的雷达接收天线接收来自面部区域的返回雷达信号。

在515,返回雷达信号与包含在存储在表达式数据库中的多个表情信号中的选定表情信号相匹配。在一个实施例中,将返回雷达信号与所选表情信号进行的匹配包括将返回雷达信号与多个表情信号进行比较。所选的表情信号可以是多个表情信号中最接近的比较。

在520中,用与所选表情信号相关联的Avatar表情来动画化所选Avatar。

相关专利

:

Meta Patent | Short range radar for face tracking

名为“Short range radar for face tracking”的Meta专利申请最初在2023年2月提交,并在日前由美国专利商标局公布。