(

映维网Nweon

2024年10月28日

)机器人可以成为头显测试和实验的一个重要工具。然而,机器人“眼睛”的眼球运动速度有时不够快,无法实时模拟人眼扫视的情况。

针对这个问题,

索尼

提出了一种机器人快速眼动模拟人眼扫视的技术。图像捕获时间可以进行调整,以跟踪致动器的速度。然后,生成的图像序列时间压缩回视频播放速度,这样视频看起来就像机器人的眼睛以人眼的速度进行扫视。

执行机器学习可能涉及访问然后在训练数据上训练模型,以使模型能够处理进一步的数据以进行推断。因此,通过机器学习训练的人工神经网络/人工智能模型可以包括输入层、输出层和中间的多个隐藏层,这些隐藏层被配置和加权以对适当的输出进行推断。

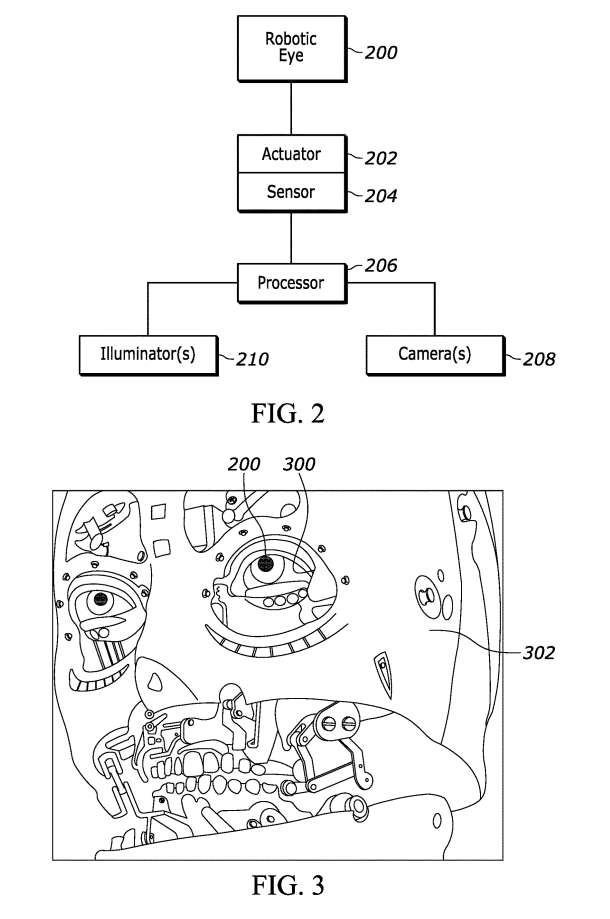

图2示出通过与传感器204相关联的致动器202控制机器人眼200在其插槽中移动。传感器204感知致动器202的位置,从而感知机器人眼200的姿态。

致动器202和传感器204可以通信耦合到一个或多个处理器206,处理器206通信耦合到一个或多个摄像头208和一个或多个照明器210,例如

眼动追踪

光源,比方说发光二极管LED。

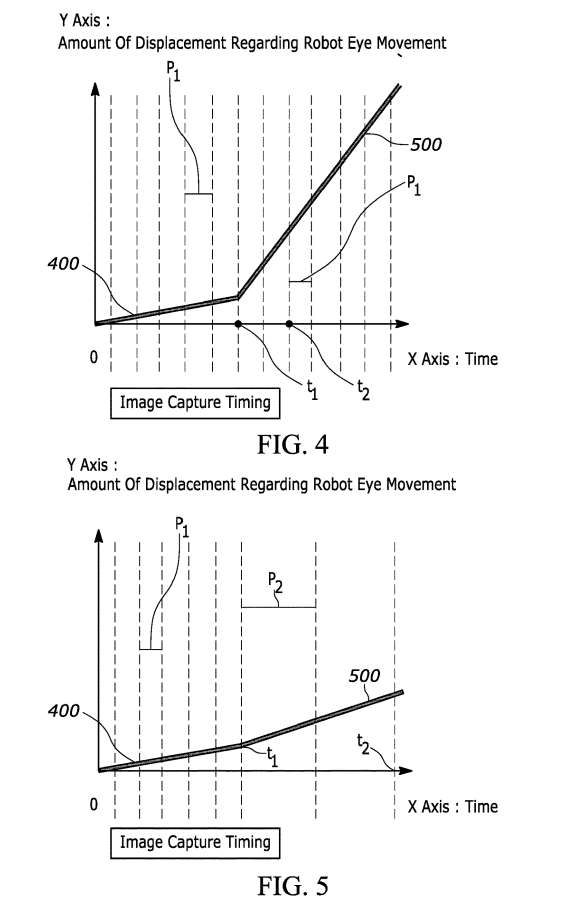

图3示出位于机器人头302的机器眼200。

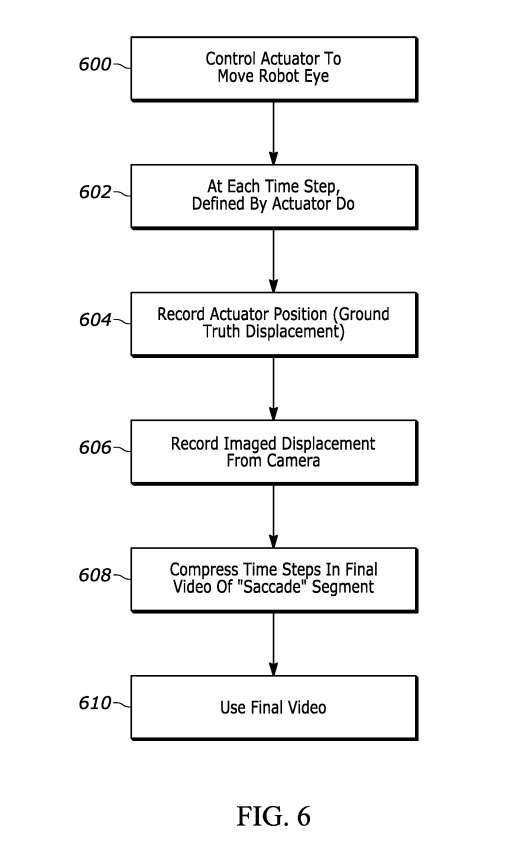

图4-6进一步阐明发明。当使用机器人测试或校准眼动追踪系统时,由于致动器的限制,可能难以重现包括快速运动的眼动,例如扫视。

为了解决这个问题,可以通过拍摄机器人眼球200运动作为慢动作现象来模拟快速眼球运动,例如扫视,并以更快的动作播放由此产生的视频。

通过这种方式,即便致动器不够快,无法以扫视速度移动机器人的眼睛,系统都可以虚拟地再现扫视。

另外,由于所有眼动都采用慢动作会消耗过多的时间,所以可以将慢视频与正常视频运动相结合,从而有效地在机器人眼200再现眼动。

如图所示,在时间0到t1的400期间,机器人眼从时间=0的原始姿态到时间=t1的所需姿态位移(y轴上所示)所需的运动速度200足够慢,以至于致动器202可以实现以所需速度移动眼睛。因此,获取连续帧之间的时间周期P1处于较短或正常的拍摄周期。

相反,假设在从t1到t2(及以后)的周期500中,为实现眼睛从t1到t2的所需姿势位移,机械眼所需的运动速度200对于致动器202来说太快,无法实现。

在这种情况下,机器人眼200的运动速度确定为,例如与致动器202可以实现的速度一样快,并且将图像捕获时间调整为比从t=0到t1的时间慢。

这意味着在t1时间之后(模拟扫视时)连续帧的采集间隔时间为P2(图5),间隔时间相对较长,即P2>P1。

然而,如图4所示,在播放机器人眼运动的完整视频时,以获取图像的速度播放到time=t1的视频片段,而以比需要图像的速度更快的速度播放t1之后的连续视频帧。在所示示例中,在时间=t1之前和之后的所有视频中,以P1帧之间的间隔播放,如图4所示。

图6以示例流程图格式提供进一步的说明。

从600开始,为以足够快的机器人眼球运动模拟扫视,致动器202控制成移动眼球,例如,与致动器移动眼球的速度一样快。致动器的速度称为跳跳所需速度,所以可以根据跳跳所需速度与致动器最大速度之差建立时间段P2。

在602,对于周期P2建立的每个图像捕获时间步,传感器204感知到的致动器位置记录在604,作为ground truth机器人眼姿态的指示,并且机器人眼在该位移处的图像记录在606。

对于608,在所需的扫视期间,图像之间的时间步长压缩,即在正常周期P1回放图像,如图4所示。

在610,使用图4时间步长所示的最终视频,将ground truth眼姿与来自摄像头208的成像眼姿进行比较,以确定处理图像以指示眼姿的眼动追踪算法的准确性和/或校准处理图像以指示眼姿的眼动追踪硬件。

可以在任何音频和/或视频显示设备输出指示,以指示眼动追踪精度至少部分地基于从致动器的ground truth姿势与由基于眼睛的视频图像的眼动追踪算法输出的姿势的比较。

相关专利

:

Sony Patent | Reproducing fast eye movement using imaging of robot with limited actuator speed

名为“Reproducing fast eye movement using imaging of robot with limited actuator speed”的索尼专利申请最初在2023年4月提交,并在日前由美国专利商标局公布。