(映维网Nweon 2025年05月29日)眼动追踪正逐渐成为头显的标配功能。然而,不准确的眼动追踪软件会给头显造成不利影响。所以,有必要提供一定的技术解决方案来验证眼动追踪软件的准确性。

在一份专利申请中,索尼提出可以利用机器人眼系统来进行眼动追踪验证。

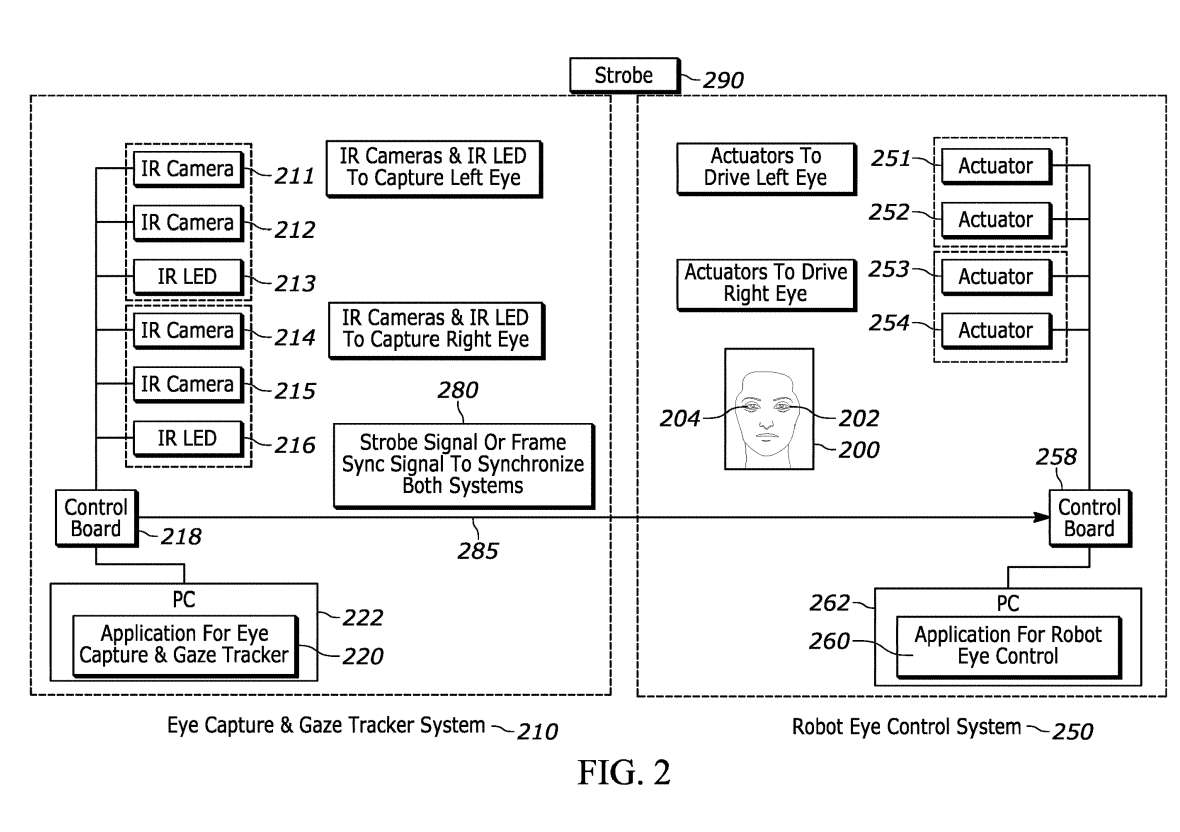

图2示出机器人眼睛控制系统250,它可以包括左眼致动器251、252,其可以包括电动机、齿轮、机械连杆和/或其他用于移动左眼202的硬件。所以,可将致动器251、252包括在机器人头200内以驱动左眼202的运动。

类似地,机器人眼睛控制系统250可包括右眼致动器253、254,其可包括电动机、齿轮、传感器、机械连杆和/或其他用于移动右眼204的硬件。所以,致动器器253、254同样可以包括在机器人头200内以用于驱动右眼204的运动。

如图2所示,所述系统250可进一步包括包括开关和其它电路元件的控制板258。电路板258可以电耦合到组件251-254并与组件251-254通信,以控制机器人眼睛202、204的眼球运动。

在一个实施例中,可以命令机器人眼睛202、204至少在X和Y维度旋转,并进一步在Z维度移动,以实现六自由度的眼球运动,从而帮助验证追踪六自由度运动的主眼动追踪系统。

对于眼动追踪验证,包括红外摄像头的眼睛追踪器系统210可以与250同步,使得作为系统250输出的同期眼角度数据可以与分别在相同时间生成的系统210的相应注视图像相匹配并进行分析。为了精确起见,这种同步可能包括精确到可接受公差水平的同步,例如百万分之一秒。

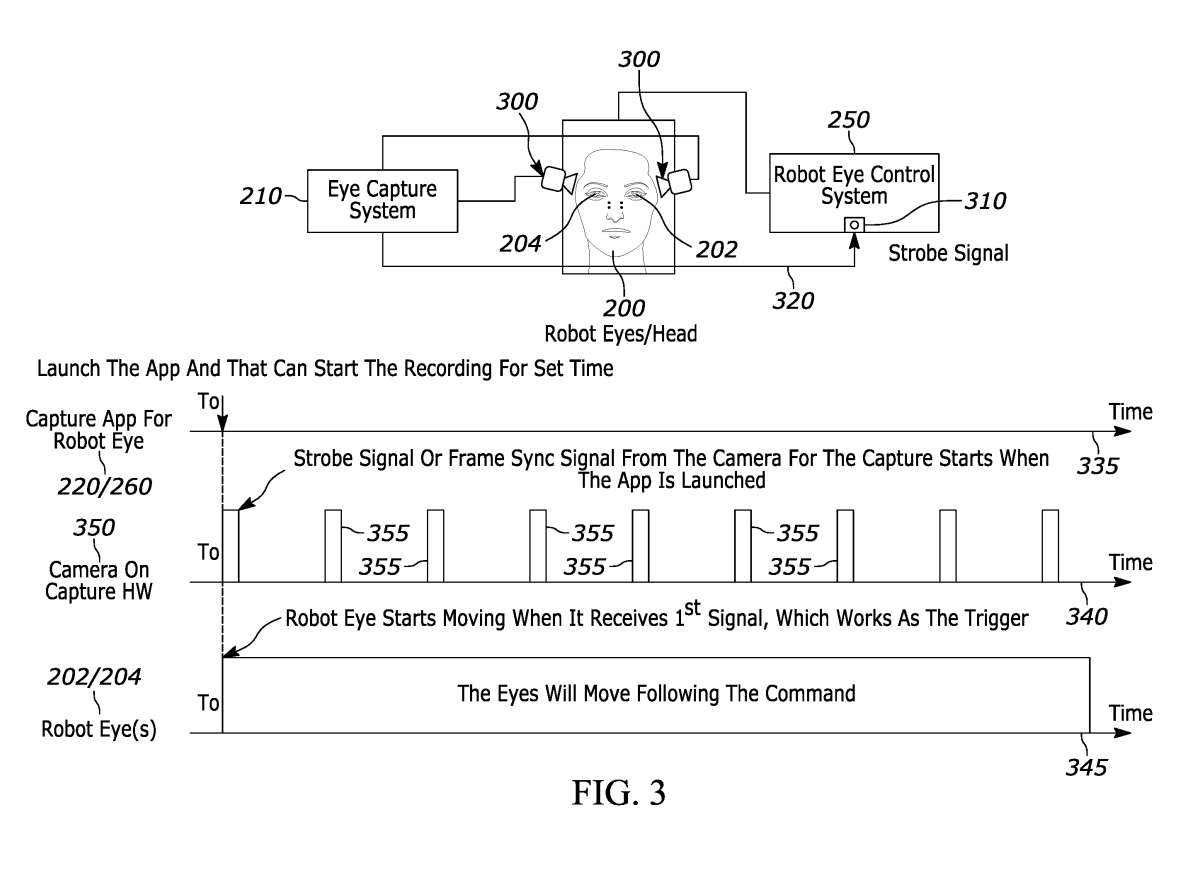

图3进一步说明了如何同步机器人眼睛和眼睛捕获系统。放置在机器人眼睛202、204周围的一个或多个摄像头300可用于通过系统210检测频闪光信号,其中所述频闪光信号可由系统210本身发射。

注意,摄像头300可以与摄像头211、212、214和215相同或不同。另外,同样的频闪光信号可以由系统250的一个或多个独立摄像头310检测到,如频闪信号路径320所示。

图3进一步展示了两个系统210、250之间随时间的相互作用,所示的三个时间线335、340、345中的每一个都展示了相同时间跨度的进展。

在T0时刻,可以启动220/260应用程序,然后开始录制,以确定设置/开始时间。元件350然后指示捕获硬件系统210的摄像头(例如211、212、214、215和/或300)可以基于各自的频闪光检测和两者之间的无光周期输出高/低信号或其他类型的信号。

所以,时间轴340的垂直条355演示了通过所述摄像头检测所述频闪光信号的时间。请注意,频闪信号和/或数字帧同步信号开始基于应用220/260启动而传输。

进一步注意,系统250可以基于第一帧同步和/或频闪光信号而开始移动一个或两个机器人眼睛202、204。这样,第一帧同步或频闪光信号可以建立用于随后的眼动追踪验证的触发器。所以,时间线345指示机器人的眼睛随时间移动以响应触发器(其作为开始命令)。

因此,机器人眼系统250和捕获系统210可以同步。再次注意,系统210、250可以集成到同一个整体系统中,或可以保持独立。无论哪种方式,应用220/260都可以将捕获的红外图像与实际机器人眼睛位置进行比较。通过同步每个样本集/组合到同一时间,可以进行最准确的眼动追踪分析。

另外,用于发射频闪光信号的光的亮度可以根据经验确定,以使捕获频闪信号的所得图像产生满意的图像亮度。这样做可以确保眼动追踪使用检测频闪光信号的相同摄像头同时执行。

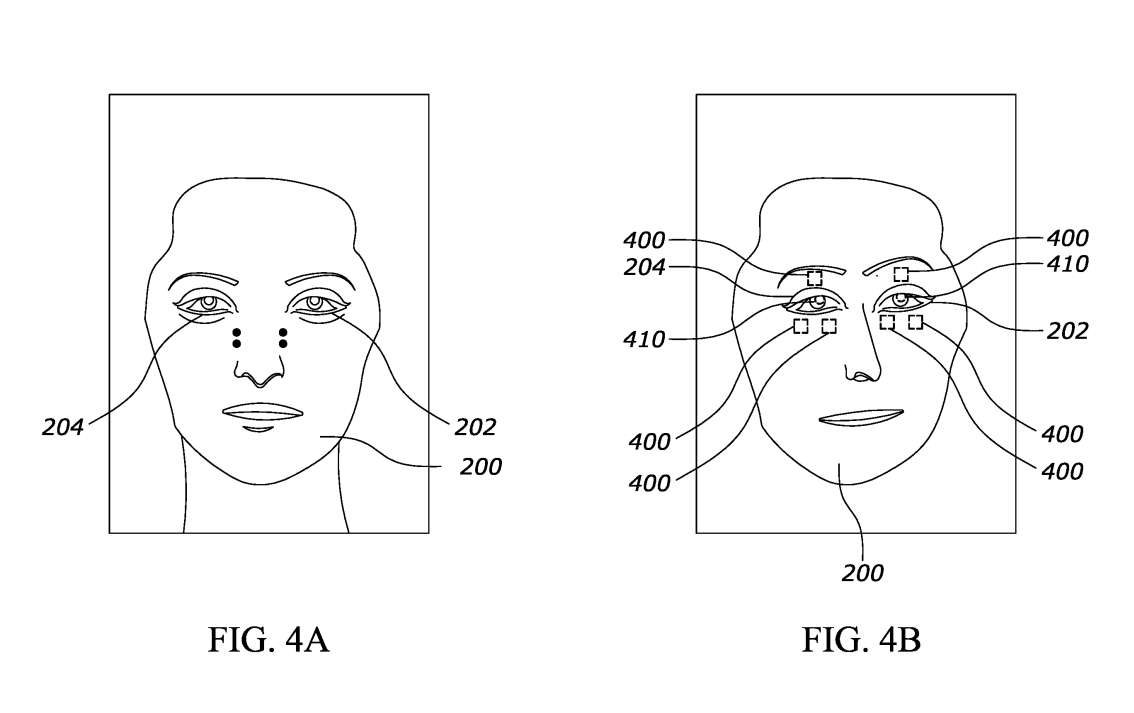

图4-7中讨论可耦合到机器人眼睛202、204的不同示例组件。

磁传感器可以放置在每个眼睛202、204的周围,以便系统确定机器人眼睛202、204的绝对位置。图4A显示了机器人头200本身,而图4B显示了磁性传感器400嵌入机器人头200的人造面部皮肤下。

图4B进一步显示,可以在每只眼202、204中嵌入各自的磁铁410。每个磁铁410可以嵌入在眼睛的人工晶状体和瞳孔后面的各自的眼睛内,以便磁铁410不妨碍晶状体和瞳孔的外部视图。

然而,为了获得每只眼睛的瞳孔的3D位置,各自的磁铁410可位于瞳孔本身的三维几何中心,以便通过传感器400进行跟踪。

磁铁410同时可以具有其极点之一,通过瞳孔的X-Y中心直接面向眼睛外,以便通过磁性传感器400进行极点追踪。这样做可以令极方向和瞳孔的观察轴同轴,从而能够对主眼动追踪系统进行准确验证。

或者,每个磁铁410的极方向可以面向眼睛外的另一个方向,然后在通过传感器400追踪眼球运动时可以确定并施加与正前方的偏移。所以,如果传感器400的位置导致从另一个极点方向比直接从瞳孔外更准确地追踪,则可以使用非同轴极点方向。

另外,可以在每个机器人眼睛202、204周围设置至少三个磁传感器400。这样做可以使用来自三个传感器400中的每一个的测量值来执行三角测量算法,以通过假设所述观察轴与所述确定的磁极方向同轴来确定各自眼睛的确切角度/位置。

每只眼睛的三个传感器400中的每一个甚至可以测量三个轴(X, Y和Z维度)中的不同一个的磁场强度。另外,如果机器人眼睛与用于主要光学眼动追踪的摄像头之间的距离已知,则额外的数据对眼动追踪应用程序有用(在3D空间中知道眼睛的绝对位置是有帮助的)。

根据图4B可以理解,每个机器人眼202、204的绝对位置可以在几乎没有间隙或误差的情况下确定。所以,这种直接磁场采样实现可以避免通过存在于具有传感器的眼睛致动器和具有多个自由度的移动眼睛部分之间的众多结构引入其他间隙或误差。

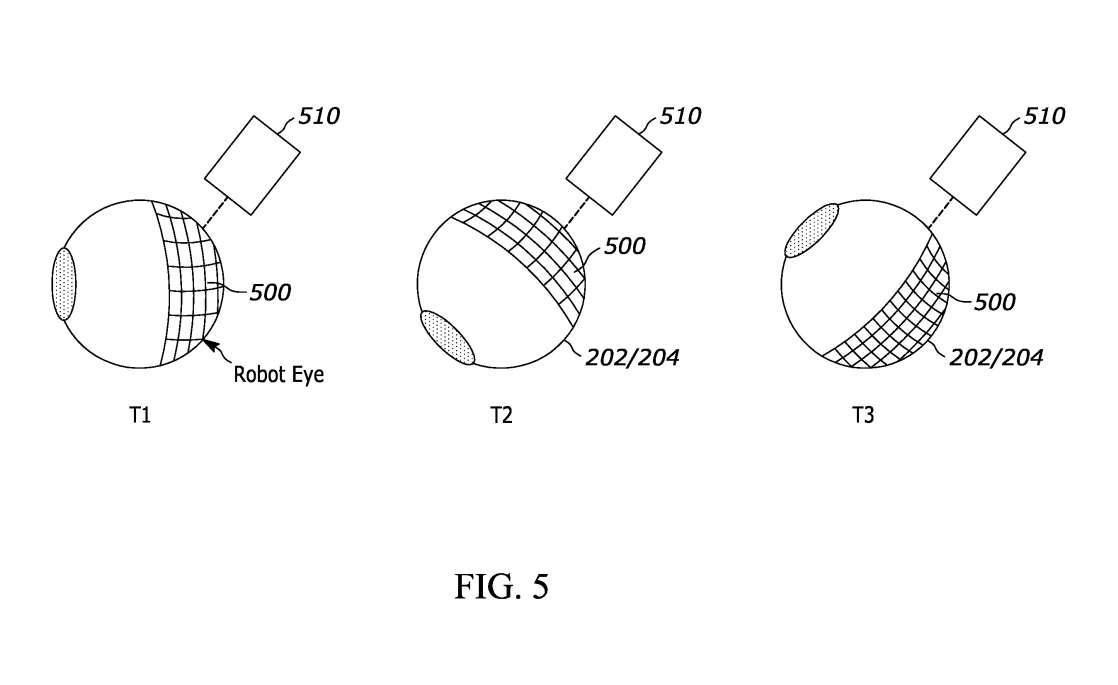

转向图5,每只眼202/204可在其内部具有纹理图案500。图案500可以球形地印在眼睛外壁的内表面。然后可以使用光学传感器510以3D方式追踪纹理图案500。光学传感器510例如可以是光电二极管/二极管阵列。

如图5所示,传感器510可以设置在机器人眼睛的后方。这样做可以使眼睛背面的纹理500依然可以追踪,但使得传感器510不会阻碍将在眼睛前面使用摄像头同时执行的主要光学眼动追踪。

可以理解的是,来自光学传感器510的输出可用于基于相应的追踪图案500旋转来确定眼睛旋转。这反过来可用于推断瞳孔方向/位置,因为机器人眼睛202/204的瞳孔相对于图案500的位置已知。

如图5所示,在第一时间T1,机器人眼睛直视前方时被追踪。然后在时间T2,机器人眼睛向下看,所以追踪图案500向上移动。然后在时间T3,机器人眼睛向上看,追踪图案500向下移动。在这里,绝对瞳孔位置可以通过二次眼动追踪技术来识别,并且几乎没有间隙或误差。

与图5一致,眼睛背面的纹理500可以是红外透明,RGB反射。所以,光学传感器510可以是RGB光学传感器,并追踪用于辅助眼动追踪技术的RGB反射纹理500,从而验证使用红外摄像头的主要光学眼动追踪系统。因此,两种不同的光谱和两种光学眼动追踪方法不会相互干扰。

请注意,尽管每只眼睛只能使用一个传感器510,但对于甚至更高保真度的眼动追踪,每只眼睛可以使用多个光学传感器510。同样,所述图案500可以是非均匀的,以便所述图案500的不同区域具有不同的唯一可识别对象,以进一步提高眼动追踪精度。

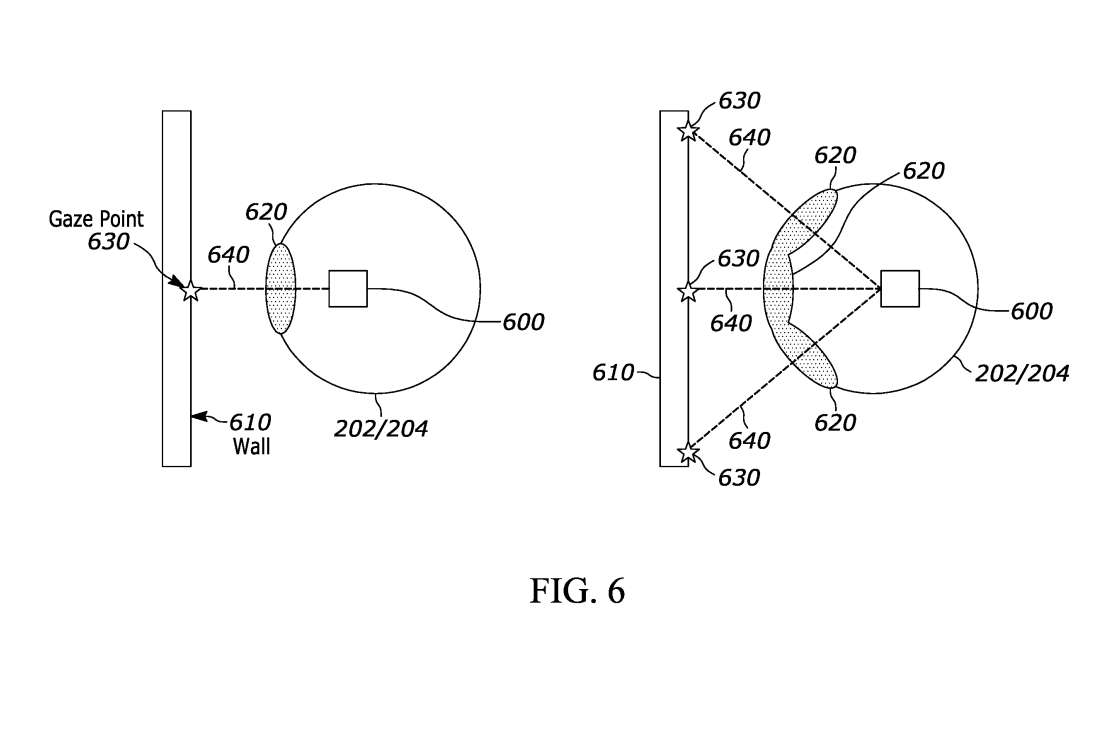

图6示出了可用于验证主要光学眼动追踪算法的另一次要眼动追踪形式。如图所示,激光器600可以设置在各自的眼202/204内。激光600可以固定地安装在眼睛202/204本身内。

然后,可以将头200直接放置在墙壁610(或其他平坦的垂直表面)的前面,而不将头显放置在其上,使得眼睛202/204的面向前方的视线与墙壁610正交。由激光600发射的激光640的方向然后可以从瞳孔620的X-Y中心正交地延伸,所以与眼睛的实际视线相匹配。

这样,激光640击中墙壁610的注视点630可以视觉识别,然后在眼睛移动时使用三角函数进行追踪(从而计算眼睛本身的绝对旋转)。

因此,图6右侧示例显示了不同时间的瞳孔620,其对应的注视点630在不同位置击中墙壁610。然后,使用三角学和激光600识别得到的眼旋转值可用于验证系统从主要光学眼动追踪算法接收到的不同眼旋转值。

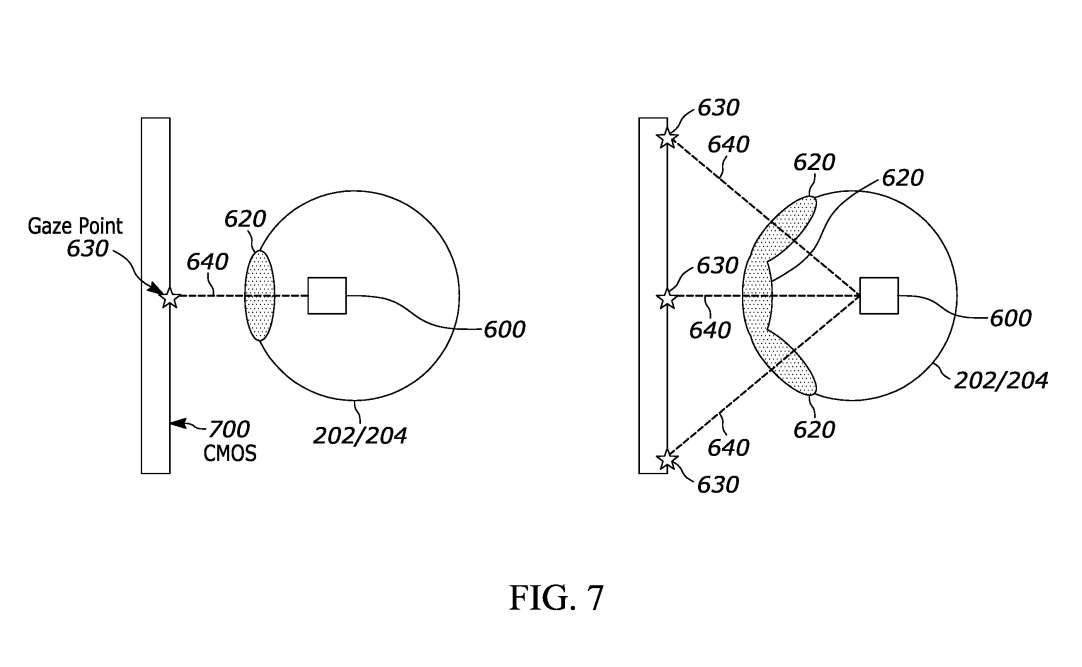

图7示出类似于图6的另一个实施例,其中激光600可以嵌入如上所述的眼睛202/204中。然而,可以在眼睛202/204前面放置CMOS传感器/传感器阵列700,而不是使用墙壁610。

图7所示技术可以与头显和头显传感器/阵列700一起使用。所以,激光640可以再次与眼睛202/204的视线相关联,CMOS传感器/阵列700在注视点630移动时检测注视点630。

所以,可以追踪激光击中传感器/阵列700的注视点630,以便可以使用三角法识别相应的眼睛旋转。然后,使用三角学和激光600识别得到的眼旋转值可用于验证系统从主要光学眼动追踪算法接收到的不同眼旋转值。

有利的是,眼睛的注视可以根据头显显示器本身进行追踪,从而验证头显实现中使用的主要眼动追踪方法。

相关专利:Sony Patent | Eye tracking validation using robot eye system

名为“Eye tracking validation using robot eye system”的索尼专利申请最初在2023年10月提交,并在日前由美国专利商标局公布。