(映维网Nweon 2025年05月12日)对于不提供控制器的头显设备而言,基于眼动追踪的眼睛操作是UI交互的一个重要手段。在一份专利申请中,谷歌就提出了混合头部运动和眼动追踪的UI交互方法。

在一个实施例中,可以提供一个用于头部锁定UI并混有眼睛注视的交互系统。眼睛注视可以与相应的头部运动相关联,以生成一个姿态来实现离散的UI选择。团队指出,除了可以带来自然的用户体验优势外,这种混有眼动追踪的头部锁定UI系统同时可以降低眼动追踪技术的精度和校准要求。

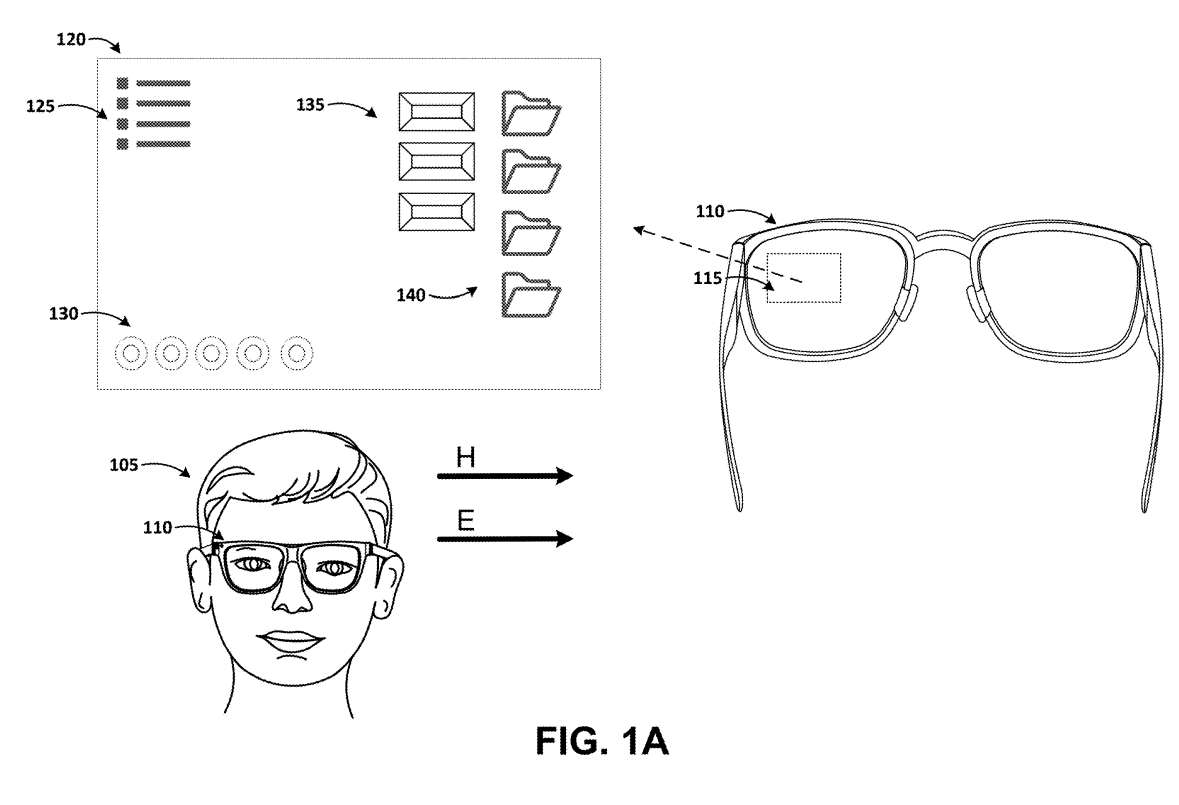

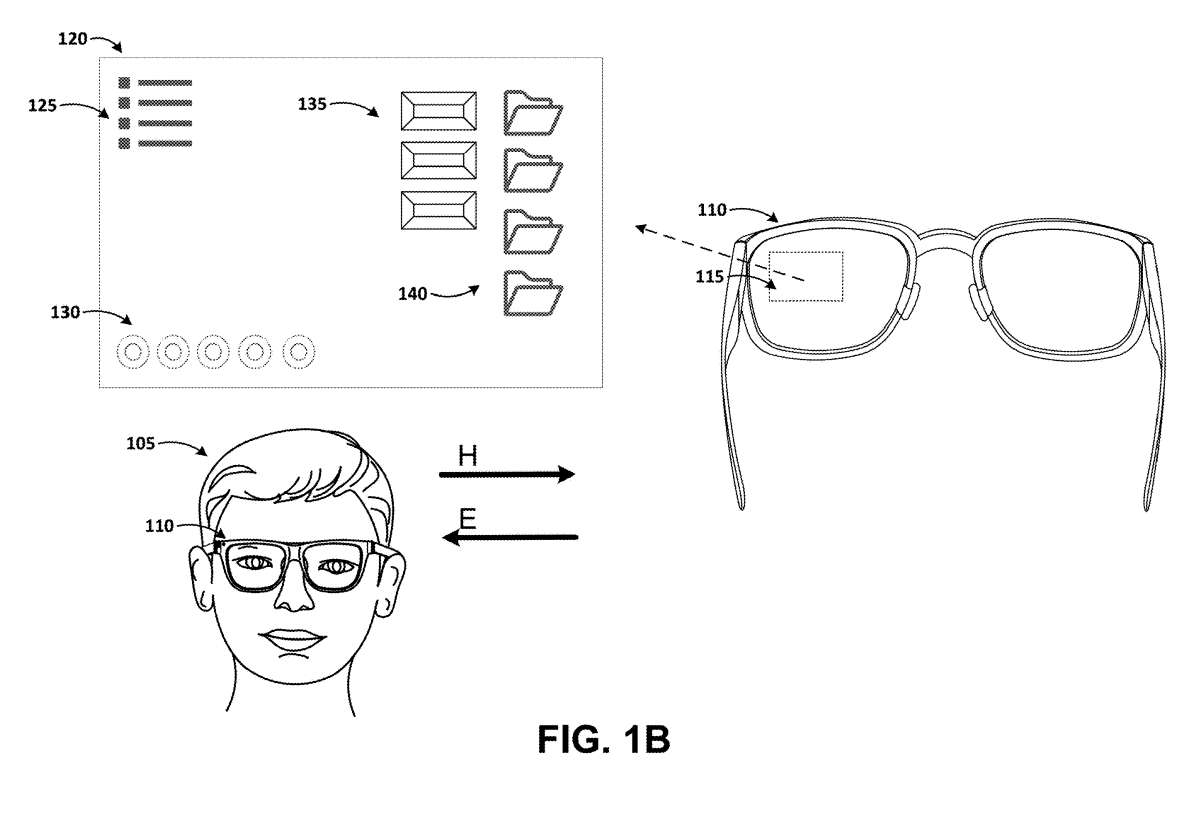

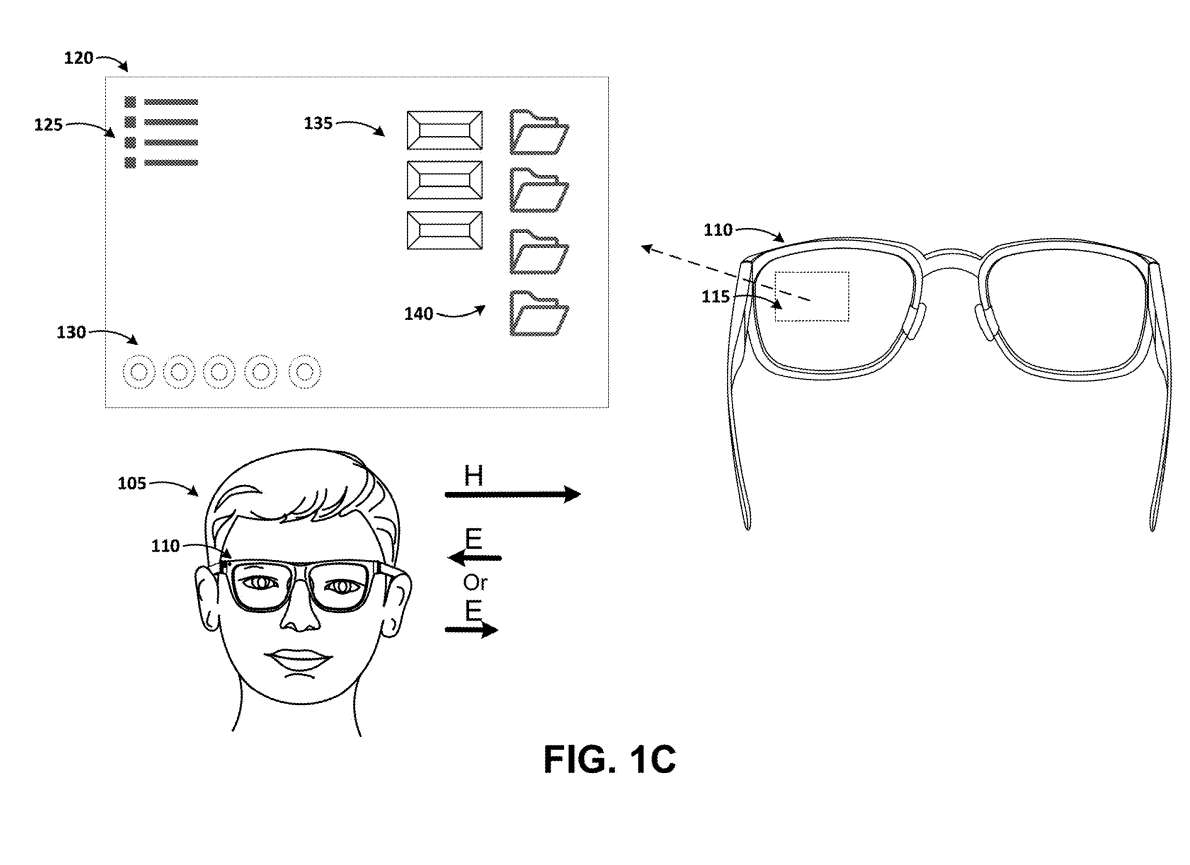

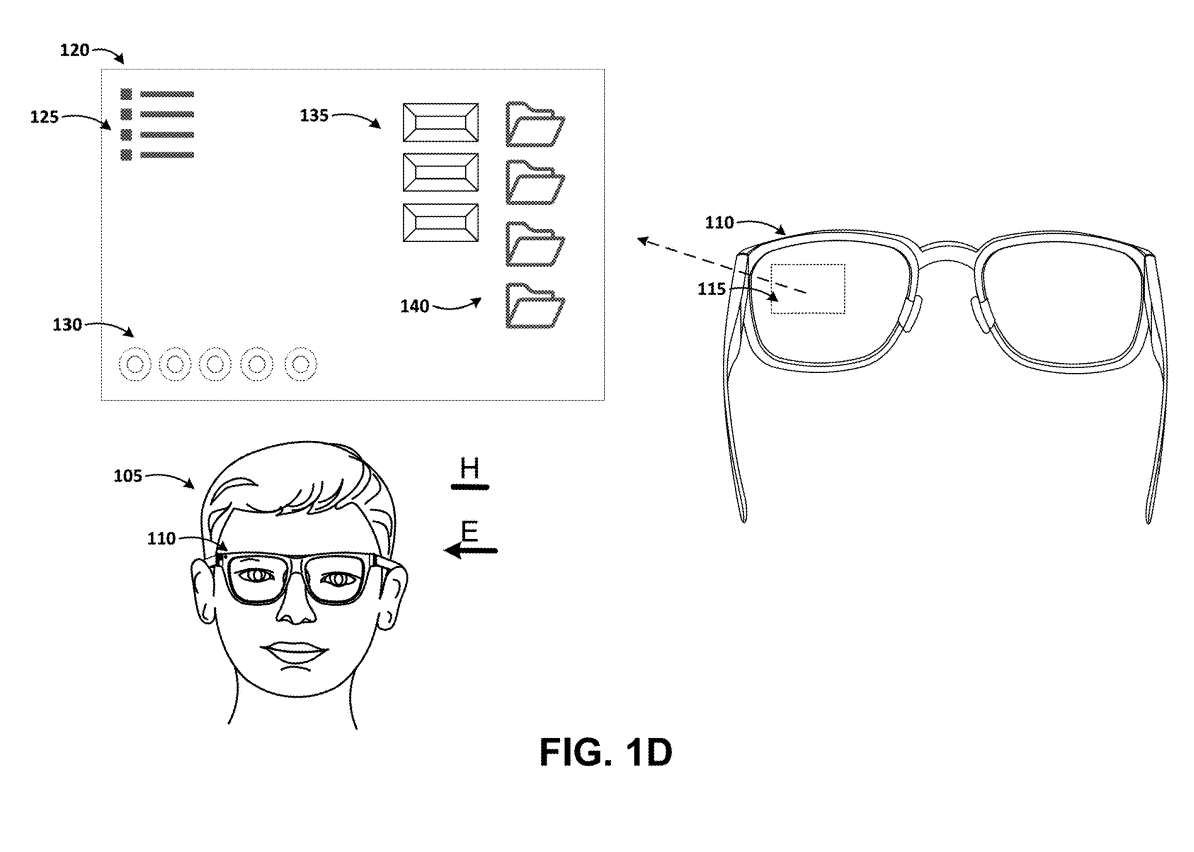

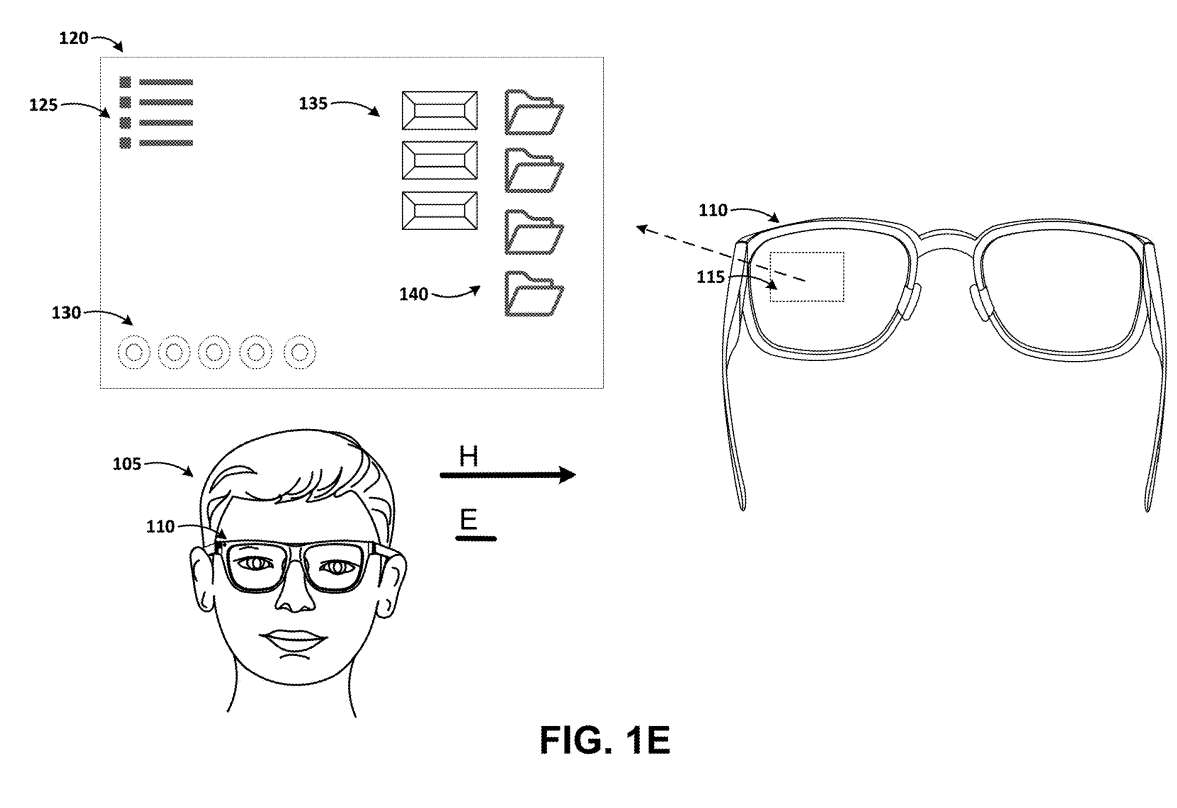

1A-1E示出了相关的场景。其中,用户105可以佩戴AR可穿戴设备110。可以将显示区域115配置为显示用户界面(UI) 120。所述UI 120可包括多个UI元素125、130、135、140。

可以提供离散的UI选择,以选择UI元素125、130、135、140中的一个,例如作为图标、菜单项、文件夹、单选按钮等。眼睛注视和/或头部运动可以对应于可以致使选择UI元素125、130、135、140中的一个的特定姿态。换句话说,眼睛注视和头部运动之间的对应关系可用于指示和/或识别姿态。

参考图1A,箭头H表示用户105的头部运动方向。箭头E指示用户105的眼睛注视方向。如果头部运动方向和眼睛运动方向相同,并且移动的距离符合一个标准,则眼睛在UI 120的边界内可以表示正在执行姿态。另外,眼睛注视的位置可以指示UI元素125、130、135、140中一个的选择。换句话说,微小的眼睛注视和/或头部运动可以表明用户105正在执行一个姿态。

如果头部运动的方向和眼睛运动的方向相同,并且移动的距离不符合标准,则运动可以表明用户正在观察现实世界中的特定对象。换句话说,大幅度眼睛注视和/或头部运动可以表明用户105不是在执行姿态,而是在观察现实世界和/或在看UI 120的边界之外。

参考图1B,头部运动方向与眼睛运动方向不一致。如果头部运动的方向和眼睛运动的方向不同,则用户105可能不打算执行姿态。例如,特定事件可能导致用户105头部移动(比方说被撞),而用户的眼睛继续将目光保持在UI 120的基本相同位置。所以,头部运动的方向和眼睛运动的方向不同,而这可以表明用户105不打算执行姿态。

参考图1C,头部运动方向和眼睛运动方向可以是同一方向,或可以是不同(如相反)方向。然而,即便头部运动方向和眼睛运动方向相同或不同,但头部运动距离不符合标准,则所述运动可以表明用户正在观察现实世界中的特定物对象。

参考图1D,眼睛注视运动的方向不影响用户105是否打算执行姿态的确定。即便没有头部运动,但眼睛运动的距离符合标准,则在UI 120边界内的眼睛运动可以指示正在执行姿态。

参考图1E,头部运动方向表示为头部向右运动。如果头部移动距离不符合标准,则移动可以表明用户正在观察现实世界中的特定对象。

换句话说,如果用户105的姿态已经完成(或确定正在完成),则可以使用UI 120的最终眼睛注视位置来确定用户105的意图。例如,姿态可用于确定用户105打算与UI元素125、130、135、140中的哪个元素进行交互。与UI元素125、130、135、140中的一个交互,可以配置为基于所选UI元素触发UI操作。

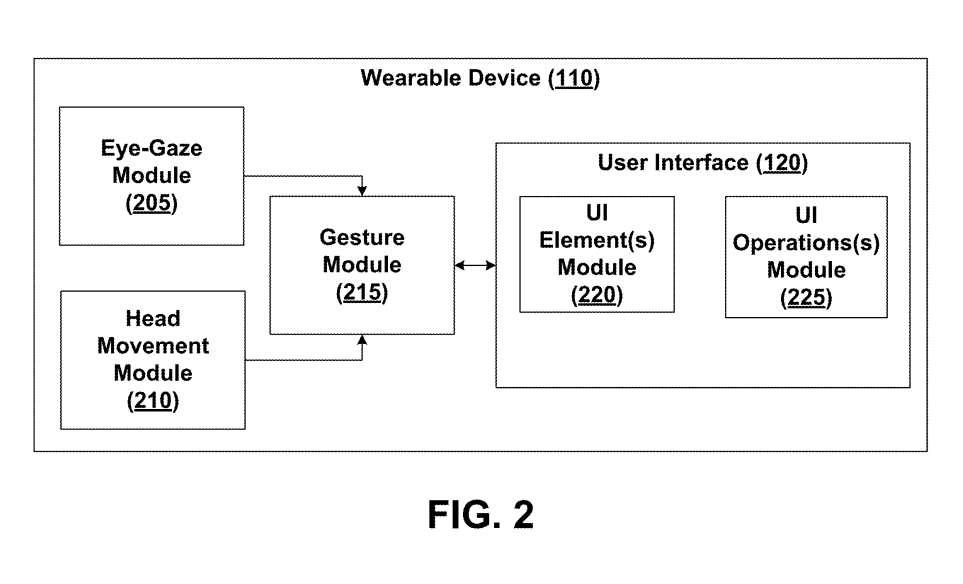

在图2示出的框图中,眼睛注视模块205可配置为追踪可穿戴设备110的用户的眼睛注视。头部运动模块210可以配置为确定用户的头部运动。

姿态模块215可以配置为基于眼睛注视特征、头部运动以及眼睛注视特征与头部运动之间的相关性来确定姿态。

另外,当用户的眼睛注视改变时,头部运动应该沿着与眼睛注视矢量相同的矢量,从而确认眼睛注视。沿着同一向量移动可以表明眼睛注视特征和头部运动之间的相关性。姿态模块215可被配置为基于所述姿态确定注视点。

UI 120可以是一个头部锁定的可视化UI,并包括一个UI元素模块220和一个UI操作模块225。UI元素可以是图标、菜单等。UI元素模块220可以配置为管理UI 120可视化显示的UI元素。例如,UI元素模块220可以配置为管理UI元素的位置、由UI元素触发的操作、UI元素的维度、UI元素的特征、UI元素之间的关联等等。

UI元素模块220可配置为选择基于姿态在可穿戴设备操作的头锁UI的UI元素。例如,UI元素模块220可以配置为基于与姿态相关的固定来选择UI元素。

在一个实施例中,UI元素模块220可以包括包含固定点和UI元素之间的映射的映射。所以,可以将UI元素模块220配置为使用由姿态模块215确定的注视点来选择UI元素。

UI操作模块225可以配置为触发UI操作。UI操作可以由UI元素触发。例如,与图标的交互可以导致显示一个或多个联系人。无需与图标交互即可触发UI操作。为了响应选择UI元素,UI操作模块225可以配置为触发基于UI元素的UI操作。

UI 120可以显示或隐藏,无需与图标交互。例如,UI 120可以根据标准显示或隐藏。例如,UI 120可以在没有用户交互的阈值周期后隐藏。所述UI操作可与可穿戴设备110组件相关联,并可由UI元素触发。例如,与图标的交互可以致使由可穿戴设备110的摄像头捕获的图像。

在可视化UI中,用户通常会查看与之交互的UI元素。

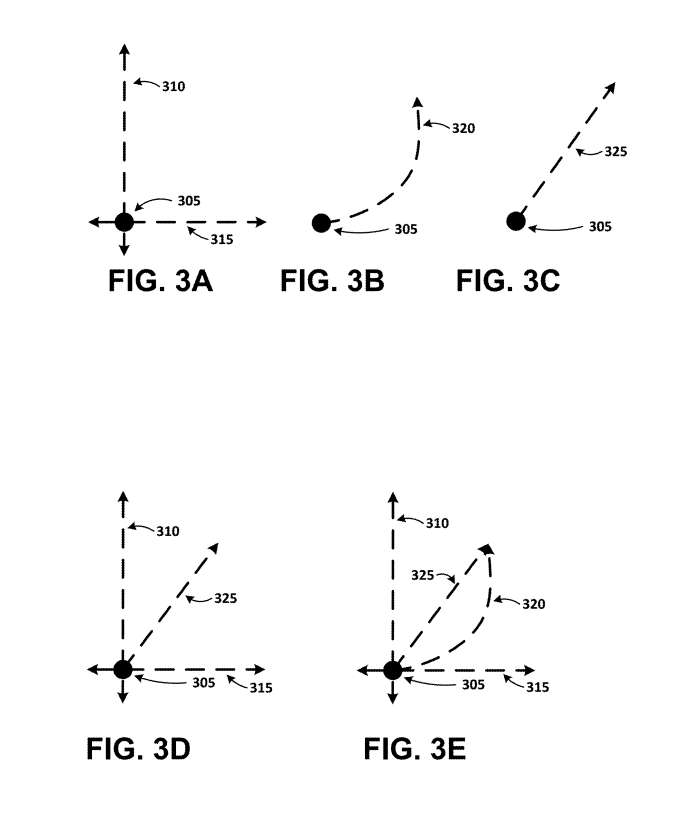

参考图3A,用户当前可以看着注视位置305所表示的UI元素。从绝对眼动追踪角度来看,注视位置305位于UI(例如UI 120)内沿x轴315和y轴310的某个点。当用户移动头部时,这种移动通常是非线性的。

参照图3B,用户可以沿行320进行头部运动。当用户移动用户的目光时,这种运动通常是线性的。参照图3C,用户可以沿着325行进行注视运动。

在一个实施例中,使用注视点追踪来确定姿态可以通过结合当前注视位置(图3A)和注视运动(图3C)来完成。例如,可以通过确定当前注视位置305和确定注视运动并将两者组合为姿态来确定姿态。

在一个实施例中,姿态可以与基于注视的用户输入相关,用户输入配置为与可穿戴设备操作的UI元素交互。

参照图3D,可以根据注视位置305和注视沿325行的移动来确定姿态。图3D所示的技术是确定姿态的有效工具。然而,这种技术可能依赖于UI内的边距和/或填充来识别可能基于姿态选择的UI元素,并可能会减少内容的可用空间。另外,注视位置可能取决于校准的准确性。

在一个示例实现中,使用注视跟踪来确定姿态可以通过结合当前注视位置(图3A)、头部运动(图3B)和注视运动(图3C)来完成。例如,可以通过确定当前注视位置305、确定头部运动和确定注视运动并将三者组合为姿态来确定姿态。参照图3E,可以根据注视位置305、头部沿320行的运动和注视运动来确定姿态。

在示例实现中,矢量可以包括方向和速度数据。方向和速度可以使用眼动追踪数据来确定。例如,眼动追踪数据可以包含闪烁矢量。

闪烁矢量可以基于基于瞳孔中心和角膜反射的相对位置的闪烁点。眼睛注视矢量可以是从闪烁点到瞳孔中心的矢量,这表明眼睛相对于摄像头指向的方向。所以,注视运动可以基于眼注视矢量和注视位置305。

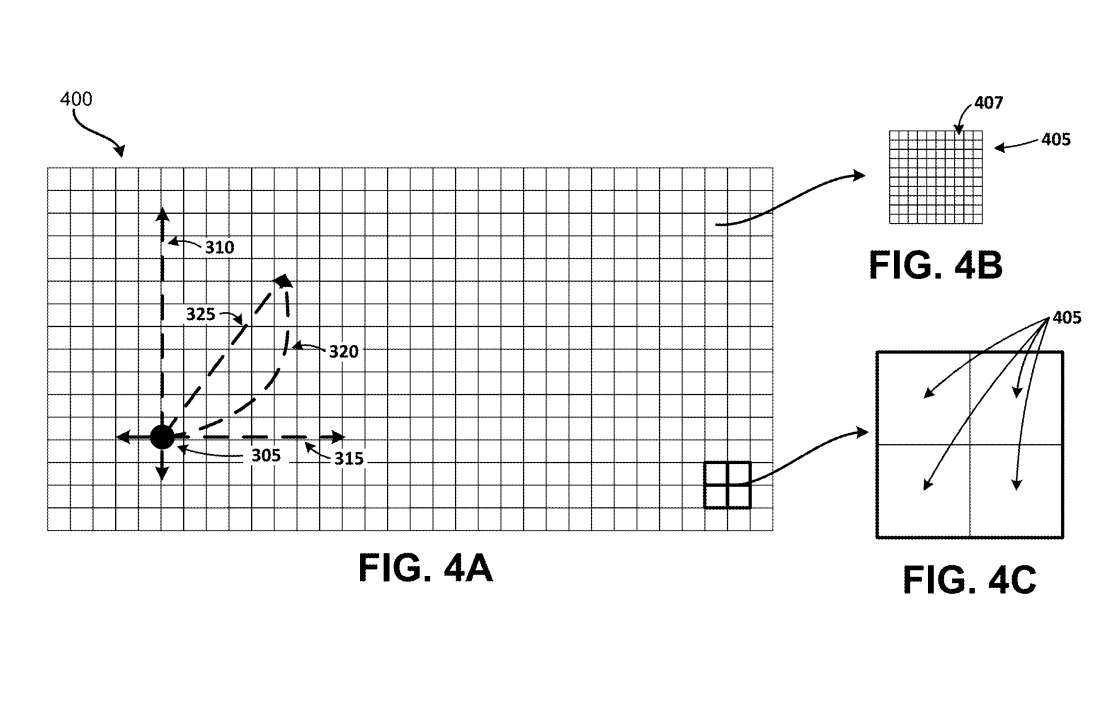

4A、4B和4C示出可穿戴设备用户界面(UI)设计框图,

如图4A所示,UI 300可以包括多个扇区。在图4B中,扇区305可包括与所述可穿戴设备的显示相关联的多个像素307。

注视点可对应于多个像素307中的一个或多个。注视点的位置可以是与UI 300关联的x轴和y轴相关联的笛卡尔坐标。所以,可以根据像素的笛卡尔坐标确定注视点和/或注视点位置。像素的笛卡尔坐标可以通过和/或使用眼动追踪数据来确定。

图4D示出可穿戴设备UI 300设计框图。UI可以包括302、304、306、308、410、412、414、416、418、420、422、424、426、428、430、432、434、436、438、440。

扇区302-340中的一个或多个扇区可以包括UI元素442。可以在N×N扇区网格中配置UI 300,以提高UI元素442选择的准确性。换句话说,UI 300可以具有这样的设计,即一个UI元素可以包含在N×N扇区网格中。

UI 300可以包括离散的指向向量444,指向从一个N×N扇区网格到另一个N×N扇区网格的点。如上所述,在一个实施例中,每个N×N扇区网格可以包含一个UI元素442。姿态模块215可以存储预定义的眼睛注视运动。

数据映射可以与UI相关联。与UI元素相关联的眼睛注视扫视可用于识别眼睛注视是否在一个UI元素内移动或移动到另一个UI元素。UI元素可以是包含多个菜单项的菜单。相关的眼睛注视扫视可以指示眼睛注视是否在菜单项之间移动或移动到不同的UI元素。

眼注视模块205可以接收和/或生成眼动追踪数据。眼睛注视模块205可以确定用户的注视是否发生了变化,如果注视发生了变化,则眼睛追踪数据可以传递给姿态模块215。

姿态模块215可以根据眼动追踪数据确定可穿戴设备110用户的眼睛注视特征。眼睛注视特征可以包括眼睛注视跳和注视点,并生成一个向量。眼睛注视模块205可以配置为基于生成的矢量选择UI 300的指向矢量444。

同时,头部运动模块210接收来自例如可穿戴设备110的集成惯性测量单元的头部运动数据。头部运动模块210可以确定用户的头部是否正在运动,并且如果头部正在运动,则可以将头部运动数据传达给姿态模块215。姿态模块215可以确定头部运动。

在示例实现中,头部移动可以最小化,因为UI是头部锁定的UI。所以与头部运动相比,在姿态确定中,眼睛注视的权重更大。可以根据头部运动向量来确定眼睛注视特征。例如,如果头部运动矢量与眼睛注视矢量的方向相同,则可以确认眼睛注视特征是正确的。

在一个实施例中,每当用户的目光从一个注视点改变到另一个注视点并且头部运动沿着同一向量时,可以根据姿态识别和突出显示UI元素。例如,姿态模块215可以与UI元素模块220通信,并基于所选的指向向量444和/或头部运动向量识别UI元素。

每个UI元素可以有一个或多个对应的指向向量444。换句话说,UI元素可以具有多个对应的指向向量,因为UI 120上的初始注视点可以在UI 120的任何位置。

所选的指向向量444可以指示该姿态与N×N扇区网格相关联,包括扇区304、306、414和416。因此,姿态模块215选择UI元素442。另外,UI元素442可以突出显示。如图4F所示,可以修改UI元素442的大小以突出显示UI元素442。

另外,姿态错误可能导致UI操作无法执行。或者,未执行的UI操作可能导致姿态错误。在一个实施例中,姿态错误可以包括检测到错误的眼睛注视、检测到错误的头部运动和/或检测到错过了交互或姿态。

用户可以重新执行姿态以进行纠正。修正运动与常规运动有明显的区别。

在示例实现中,可以使用头部运动或眼睛运动来确定姿态。例如,如果眼睛注视模块205无法生成眼睛运动数据或头部运动模块210无法生成头部运动数据,则可以使用另一个来确定姿态。

例如,可以使用眼动数据或头部运动数据来生成指向向量,并且可以根据指向向量确定姿态。同时,可以将姿态模块215配置为在使用眼动数据、头部运动数据或同时使用眼动数据和头动数据之间切换以确定姿态。

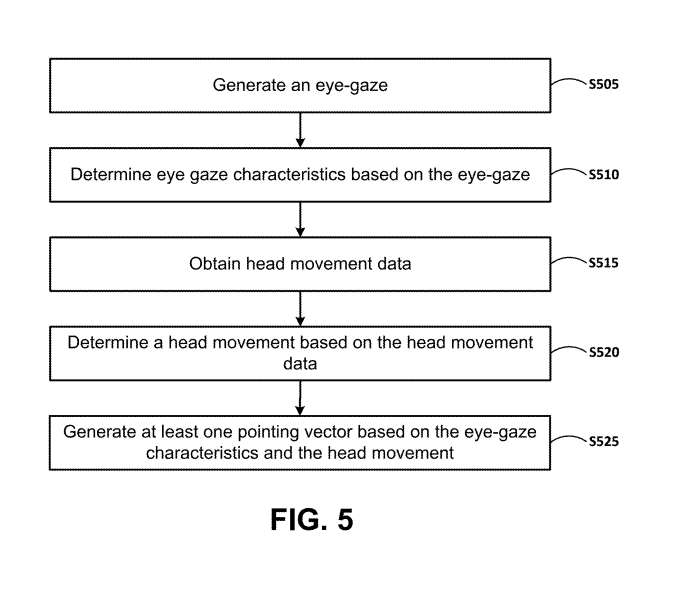

图5示出了生成姿态数据的方法。

在步骤S505中,产生眼睛注视。

在步骤S510中,根据人眼注视确定人眼注视特征。

在步骤S515中,获取头部运动数据。

在步骤S520中,根据所述头部运动数据确定头部运动。

在步骤S525中,根据眼睛注视特征和头的运动确定至少一个指向向量。

相关专利:Google Patent | Wearable device mixed gaze tracking

名为“Wearable device mixed gaze tracking”的谷歌专利申请最初在2023年9月提交,并在日前由美国专利商标局公布。