(映维网Nweon 2025年04月26日)近期美国专利及商标局公布了一批全新的AR/VR专利,以下是映维网的整理(详情请点击专利标题),一共40篇。更多专利披露请访问映维网专利板块https://patent.nweon.com/进行检索,你同时可以加入映维网AR/VR专利交流微信群(详见文末)。

1. 《Meta Patent | Methods, apparatuses and computer program products for providing active vibration control systems(Meta专利:用于提供主动振动控制系统的方法、装置和计算机程序产品)》

在一个实施例中,专利描述的系统可以通过系统的麦克风检测至少一个音频信号,音频信号包括从至少一个扬声器输出的音频内容和来自一个或多个其他源的其他音频数据,或者由一个或更多个其他源引起的音频信号。其他音频数据可以包括所确定的导致至少一个音频信号失真的非期望振动噪声。系统可以部分地基于确定用户至少一个运动或一个或多个其他用户的运动,通过至少一种传感器来确定其他音频数据的子集。系统可以从至少一个音频信号中去除或减少非期望振动噪声,以能够输出与至少一个视频信号的修改相关的声音。

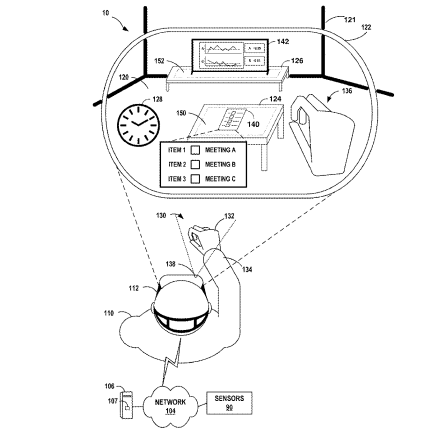

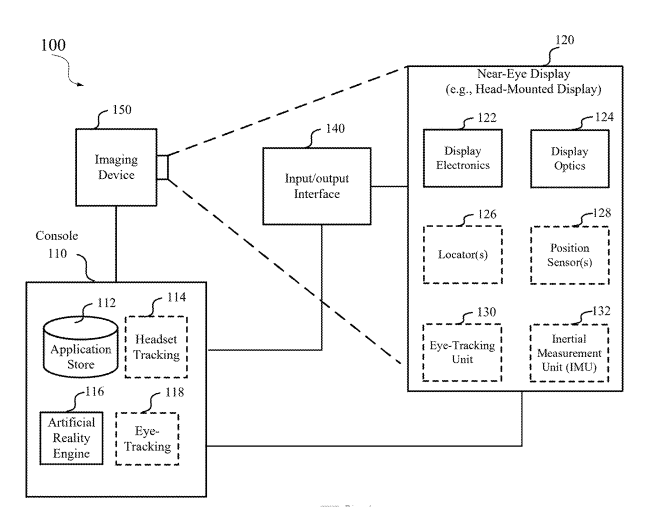

2. 《Meta Patent | Artificial reality system architecture for concurrent application execution and collaborative 3d scene rendering(Meta专利:用于并发应用执行和协同3D场景渲染的人工现实系统架构)》

在一个实施例中,AR系统包括图像捕获设备,其配置为捕获表示物理环境的图像数据。AR系统包括配置为输出人工现实内容的头戴式显示器。AR系统包括多个并发执行的人工现实客户端应用程序。AR系统包括并发应用引擎,其配置为控制将人工现实内容渲染为公共场景,公共场景包括来自多个人工现实应用中的每一个的一个或多个对象。

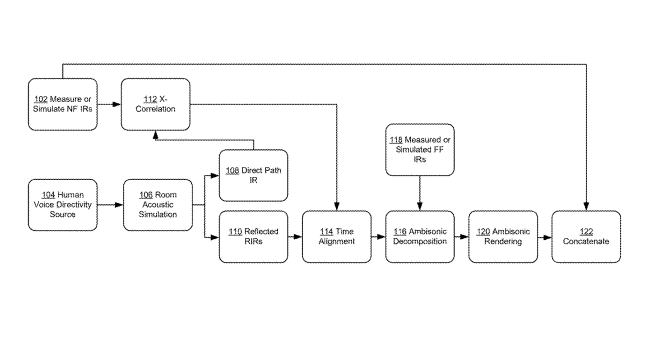

3. 《Meta Patent | Modifying audio inputs to provide realistic audio outputs in an extended-reality environment, and systems and methods of use thereof(Meta专利:修改音频输入以在扩展现实环境中提供逼真的音频输出,及其使用系统和方法)》

在一个实施例中,将音频输入与扩展现实环境相匹配的示例方法包括,从头戴式扩展现实设备处的麦克风接收音频输入,并且音频输入发生在模拟环境中的模拟位置。所述方法同时包括通过基于模拟环境内的模拟对象改变音频来将音频输入处理为处理后的音频。经处理的音频配置为以好像音频输入正被模拟环境改变的方式被感知。示例方法包括将处理后的音频传输到设备进行回放,使得音频被感知为在模拟环境中说话。

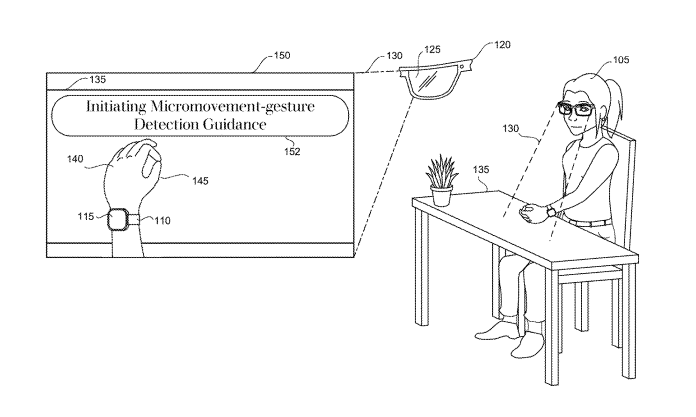

4. 《Meta Patent | Systems and methods for guiding users to perform detectable biopotential-based gestures tied to specific motor units, and actionable feedback associated therewith(Meta专利:用于引导用户执行与特定运动单元相关的可检测的基生物电位手势的系统和方法,以及与之相关的可操作反馈)》

在一个实施例中,呈现用于执行与MU的激活相关联的移动的指令,以及与MU的启动相关联的图形元素。响应于检测到MU的激活,基于在执行运动期间捕获的生物电势传感器数据,确定用户要执行的额外运动和对图形元素的更改。呈现用于执行附加移动和对图形元素的更改的附加指令。响应于检测到MU的额外激活,根据在执行额外运动期间捕获的额外生物电位传感器数据满足阈值的确定,将额外生物电位传感数据与基于生物电位的手势相关联,并向图形元素呈现额外的变化。

5. 《Meta Patent | Methods, apparatuses and computer program products for gaze-driven adaptive content generation(Meta专利:用于视线驱动的自适应内容生成方法、装置和计算机程序产品)》

在一个实施例中,系统可以实现机器学习模型,模型包括基于捕获的内容或与用户的注视、瞳孔扩张、面部表情、肌肉运动、心率或先前或实时确定的用户注视停留时间相关联的预训练或实时训练的训练数据。系统可以确定用户眼睛的注视或与用户通过设备查看环境中的内容项相关联的面部特征。系统可以包括基于注视或面部特征确定用户的状态或兴趣。系统可以通过实现机器学习模型并基于用户的状态或兴趣来确定内容,以生成内容项的修改或生成与内容项相关联的新内容项。

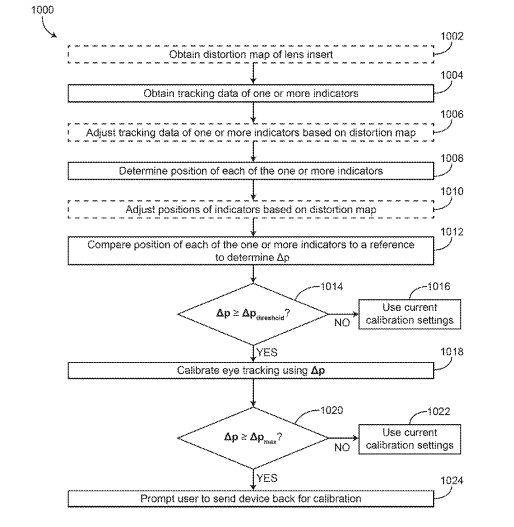

6. 《Meta Patent | Systems and methods for calibrating eye tracking(Meta专利:用于校准眼动追踪的系统和方法)》

在一个实施例中,专利描述的方法包括从朝向组合器的成像设备接收眼动追踪数据。基于眼动追踪数据确定用户眼睛的注视方向。从成像设备接收校准数据,并至少部分地基于从成像设备接收到的校准数据来确定注视方向。

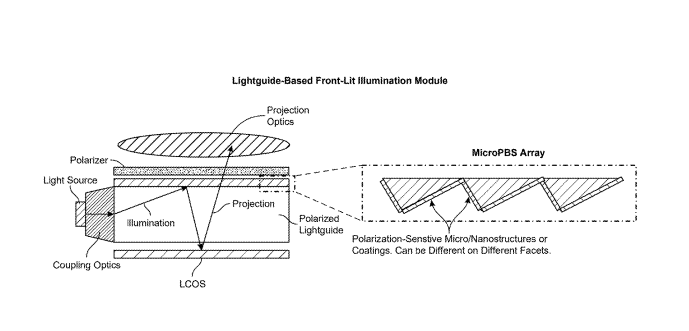

7. 《Meta Patent | Front-lit illumination module(Meta专利:前照式照明模块)》

在一个实施例中,照明模块包括LCoS面板、配置为产生照明光的多个光源、以及经由耦合光学器件光学耦合到多个光源并适于将照明光引导到LCoS板的光导,光导配置为透射第一偏振态的光并反射与第一偏振态正交的第二偏振态的光线。多个光源可以包括Micro LED阵列。

8. 《Meta Patent | Vr luminance-optimized lcd design seen through the lens(Meta专利:VR亮度优化的LCD设计)》

在一个实施例中,近眼显示器包括配置为显示图像的显示面板和配置为将图像投影到用户眼睛的显示光学器件。显示面板的多个区域中的每个区域处的峰值亮度角与通过显示光学器件看到的区域的视角相匹配。显示面板包括液晶显示LCD面板,并且通过相对于LCD面板区域处的遮光结构移动黑矩阵元件,使每个区域处的峰值亮度角与通过显示光学器件看到的区域的视角相匹配。

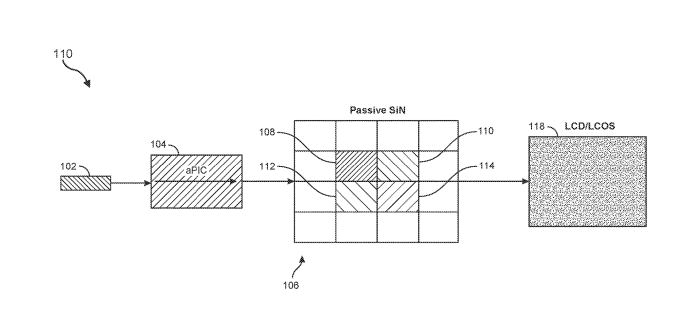

9. 《Meta Patent | Zonal illumination with photonic circuits for displays(Meta专利:用于显示器的光子电路区域照明)》

在一个实施例中,光源可以将光引导到有源光子电路中。有源光子电路可以包括可控制的光学开关,以分配光来照亮显示区域。有源光子电路可以包括光学开关的布置,其配置为允许特定区域进行光栅扫描,例如,使用光分布并进一步使用无源光子电路进行外耦合。每个区域的照明强度可以使用光学开关和/或通过光源强度的变化来控制。每个区域的照明强度可以根据显示的内容而变化,从而提高对比度。可以基于显示的内容以区域照明强度同时照亮所有区域。

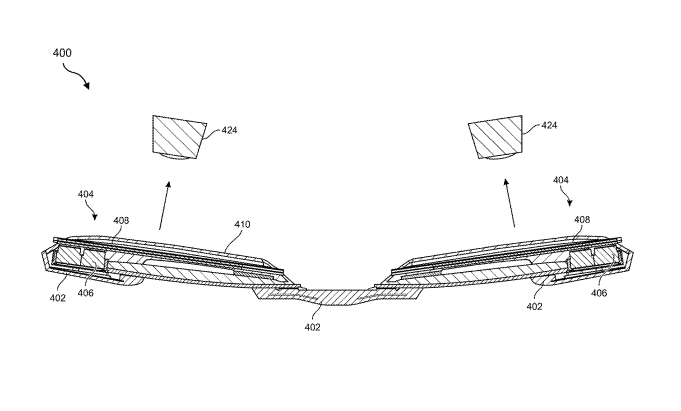

10. 《Meta Patent | Systems and methods for assembling a head-mounted display(Meta专利:用于组装头戴式显示器的系统和方法)》

在一个实施例中,组装头显的方法可以包括将第一数字投影仪组件耦合到HMD框架,将第二数字投影仪组件耦接到头显框架,然后翘曲头显框架以将第一数字投影组件与第二数字投影组件光学对准。翘曲的头显框架可以固定,使得第一数字投影仪组件和第二数字投影仪组件在光学上对齐到预定阈值内。

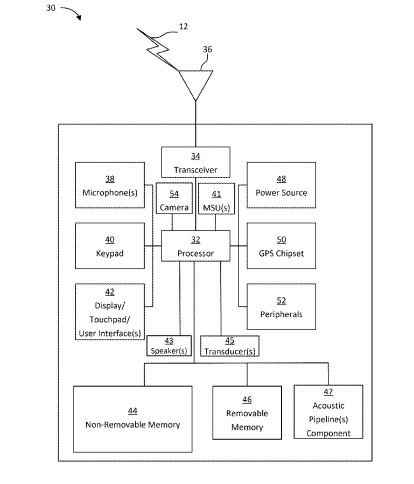

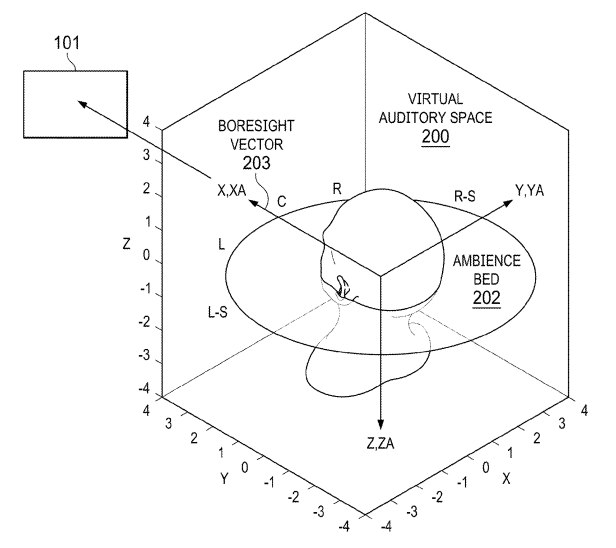

11. 《Apple Patent | Head tracking correlated motion detection for spatial audio applications(苹果专利:用于空间音频应用的头追踪相关运动检测)》

在一个实施例中,专利描述的方法包括:使用源设备的一个或多个处理器从源设备获得源设备运动数据,从头显获得头显运动数据;使用一个或多个处理器,通过所述源设备运动数据和所述头显运动数据来确定相关性度量;基于所确定的相关性度量,使用所述一个或多个处理器更新运动追踪状态;以及根据更新的运动追踪状态启动头部姿势追踪。

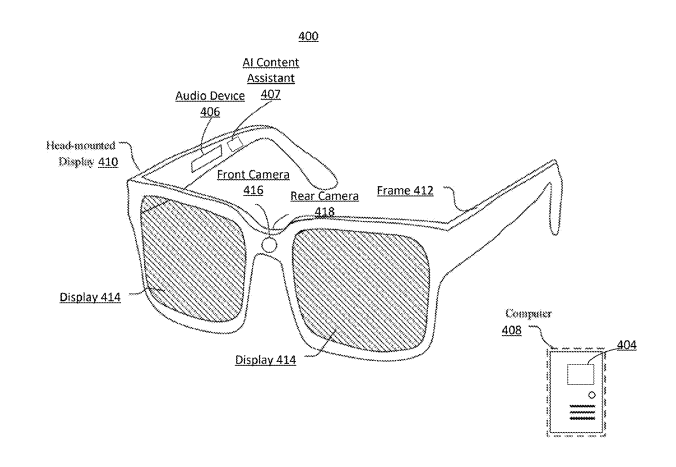

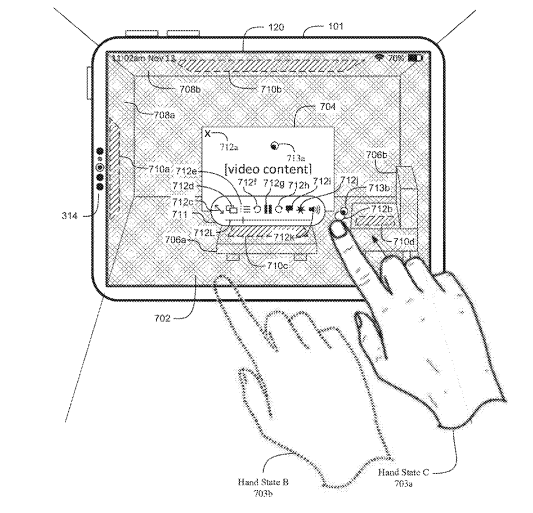

12. 《Apple Patent | Devices, methods, and graphical user interfaces for content applications(苹果专利:用于内容应用程序的设备、方法和图形用户界面)》

在一个实施例中,电子设备在呈现内容项的同时生成虚拟照明效果。在一个实施例中,电子设备增强了对内容项的相应回放位置的导航。在一个实施例中,电子设备在三维环境中显示媒体内容。在一个实施例中,电子设备以不同的呈现模式呈现媒体内容。

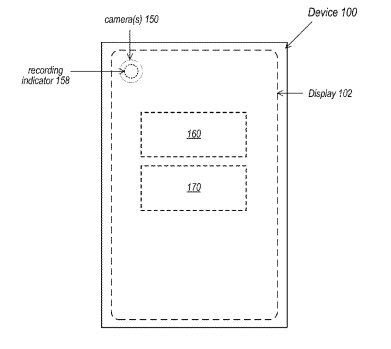

13. 《Apple Patent | External recording indicators(苹果专利:外部录音指示器)》

在一个实施例中,记录指示器提供防篡改保护,使记录指示器不易禁用或屏蔽。设备可以处理捕获帧以检测加密模式;如果无法检测到加密模式,则禁用记录。另外,用户必须接到设备上以进行记录的模块化附件;模块化附件的存在向环境中的人指示他们可能正在被记录。

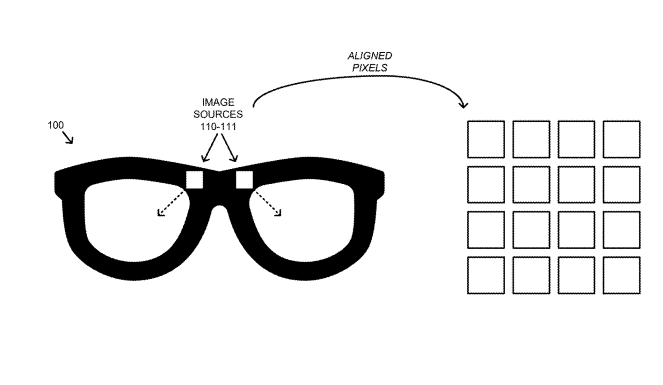

14. 《Google Patent | Pixel alignment for binocular display systems(谷歌专利:双目显示系统的像素对齐)》

在一个实施例中,系统包括用于左眼的第一图像源和用于右眼的第二图像源。系统包括用于第一图像源的第一光路或用于第二图像源的第二光路中的至少一个窗口,至少一个窗口配置为将来自第一图像源地第一像素与来自第二图像来源地第二像素对准。

15. 《Google Patent | Active control of virtual image depth positioning(谷歌专利:虚拟图像深度定位的主动控制)》

在一个实施例中,头戴式显示设备包括配置为激活头戴式显示器设备的显示器的控制器。头戴式显示设备包括眼睛侧透镜和世界侧透镜。控制器可以激活眼睛侧透镜和世界侧透镜,以在第一虚拟深度显示虚拟内容。控制器可以停用眼睛侧透镜和世界侧透镜,以在第二虚拟深度显示虚拟内容,其中第二虚拟高度大于第一虚拟深度。

16. 《Google Patent | Reference projection for a wearable display(谷歌专利:可穿戴显示器的参考投影)》

在一个实施例中,专利描述的方法包括从第一图像源生成第一投影,从第二图像源生成第二投影,基于第一投影和第二投影识别与第一图像源相关联的对准中的至少一个误差。

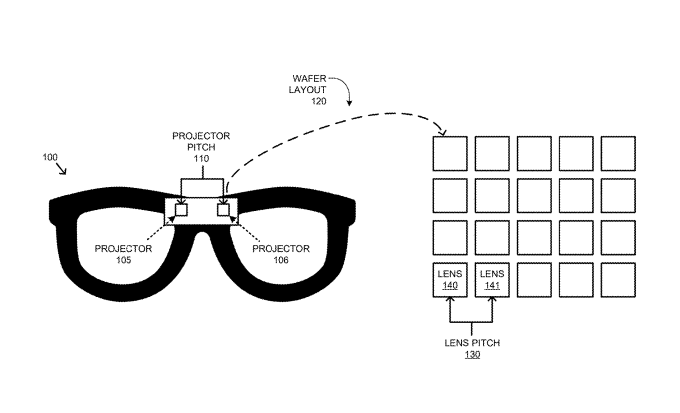

17. 《Google Patent | Projector spacing as a function of lens spacing on a wafer(谷歌专利:投影仪间距与晶片透镜间距的函数关系)》

在一个实施例中,括识别与晶片相关联的透镜间距。基于透镜间距确定晶片上第一投影仪和第二投影仪的投影仪间距。基于投影仪间距为设备选择晶片的一部分。

18. 《Samsung Patent | Display device and method for fabricating the same(三星专利:显示设备和制造所述显示设备的方法)》

在一个实施例中,专利描述的显示设备包括:基板;基板上的第一电极;第一电极上的发光层;发光层上的像素限定层;以及发光层上的第二电极。发光层的第一和第二相对侧位于像素限定层之上,并且具有相对于像素限定层的上表面倾斜一定角度的直线形状。

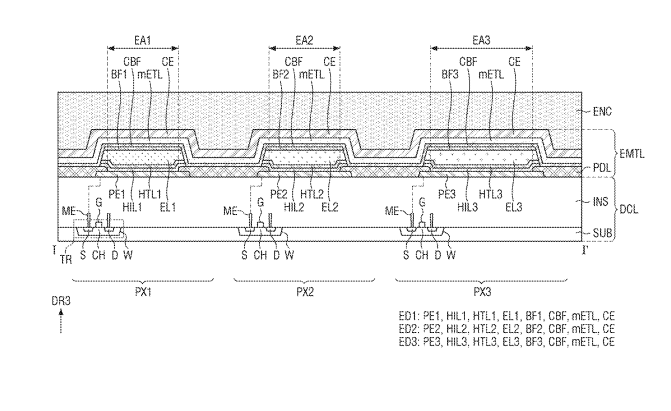

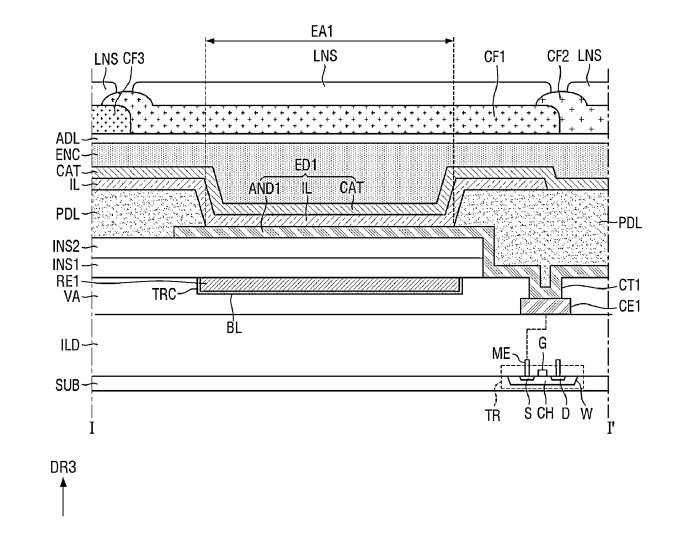

19. 《Samsung Patent | Display device(三星专利:显示设备)》

在一个实施例中,专利描述的显示设备包括基板、设置在基板上的晶体管、设置在晶体管上的平坦化层、设置在平坦化层上以连接到晶体管的第一电极、设置在第一电极上的中间层、设置于中间层上的第二电极、设置于平坦化层的沟槽中并与第一电极分离的反射层、以及设置在沟槽内壁和反射层之间的接合层。

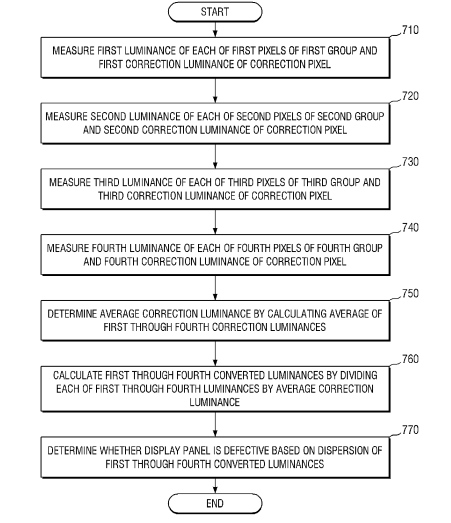

20. 《Samsung Patent | Method of inspecting display panel and display device(三星专利:显示面板和显示设备的检查方法)》

在一个实施例中,检查显示设备的方法可以包括测量第一组中包括的每个第一像素的第一亮度,并在第一组和校正像素打开时测量校正像素的第一校正亮度,测量第二组和校正像素打开时包括的每个第二像素的第二亮度,并测量校正像素中的第二校正亮度,在第三组和校正象素打开时测量包括第三组中的每个第三像素的第三亮度,并对校正像素的第四校正亮度进行测量,测量包括第四组中的每一个第四像素的第四亮度,并在第四组和校正画素打开时测量纠正像素的第五校正亮度。

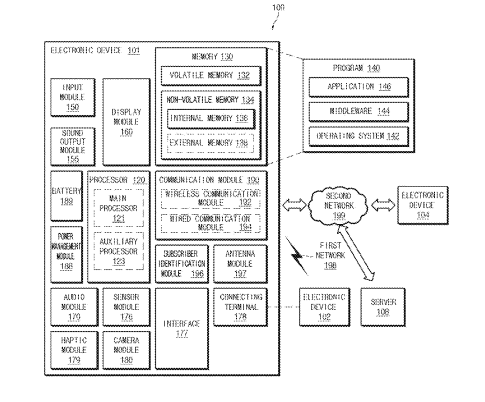

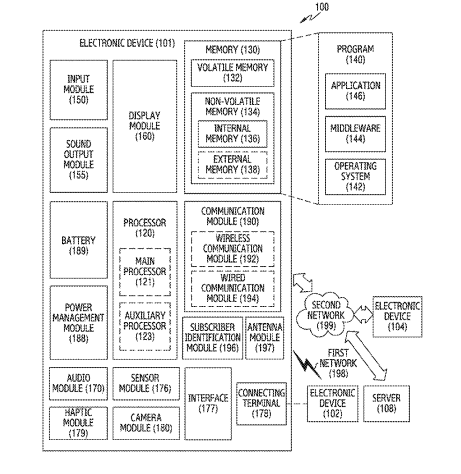

21. 《Samsung Patent | Wearable electronic device for displaying obstacle-related information, operating method, and storage medium(三星专利:用于显示障碍物相关信息的可穿戴电子设备、操作方法和存储介质)》

在一个实施例中,可穿戴电子设备基于通过所述摄像头获得的图像来确定指示周围环境对用户的危险程度的环境水平,根据所确定的环境水平来确定是否使用所述传感器、所述摄像头和所述麦克风,基于通过传感器、摄像头或所述麦克风中确定要使用的至少一个输入的数据来获得障碍物信息和障碍物与用户之间的估计脉冲,基于所述环境水平、障碍物信息以及估计脉冲来确定用于显示障碍物和用户之间的碰撞危险的UI水平,根据UI水平生成指示障碍物的方向和危险程度的图形实体,并显示障碍物相关UI,包括显示器上的图形实体。

22. 《Samsung Patent | Method for determining user’s gaze and electronic device therefor(三星专利:确定用户视线的方法及其电子设备)》

在一个实施例中,处理器识别在获取包括用户眼睛的第一图像时从传感器测量的特征值是否满足指定条件。当特征值满足指定条件时,处理器基于与指定图案的匹配,使用提取特征点的第一方案来识别第一图像中的瞳孔位置,获取包括用户眼睛的第二图像,并参考第一图像识别第二图像中的变化量。当第二图像中的变化量大于或等于指定水平时,处理器计算第一方案的精度,并根据计算的精度,使用第一方案或基于训练网络提取特征点的第二方案识别第二图像的瞳孔位置。

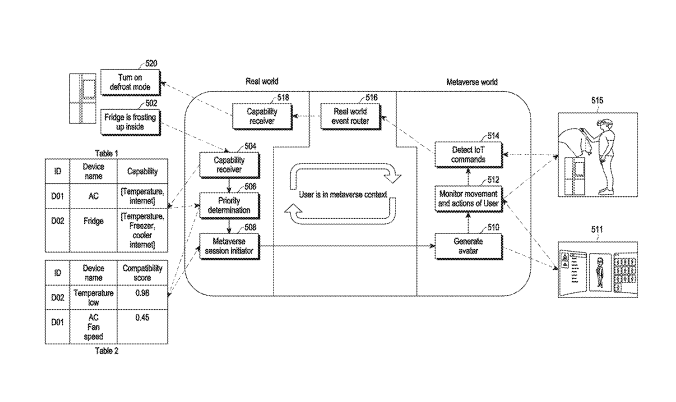

23. 《Samsung Patent | Electronic device and method for managing iot devices in a metaverse environment(三星专利:在元宇宙环境中管理物联网设备的电子设备和方法)》

在一个实施例中,检测用户参与元宇宙环境,在检测到用户参与元世界环境时,监测现实世界环境中一个或多个物联网设备中的每一个的操作状态,基于监测到的一个或更多个物联网的操作状态从需要用户注意的一个或者更多个物联设备中确定至少一个物联网,并在元宇宙环境中生成所确定的需要用户注意的至少一个物联网设备的可交互化身,其中可交互化身代表至少一个物联网设备的操作状态。

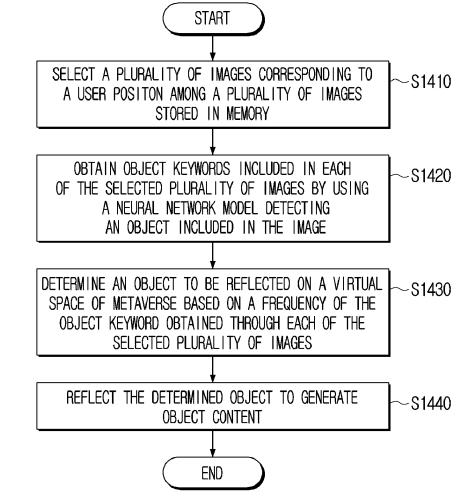

24. 《Samsung Patent | Electronic device for providing user-customized metaverse content and control method therefor(三星专利:提供用户定制元宇宙内容的电子设备及其控制方法)》

在一个实施例中,使用多个图像生成要在元宇宙的虚拟空间中显示的内容,从多个图像中选择与用户位置对应的多个图像;获得包括在所选择的多个图像中的每一个中的对象关键字;基于通过所选多个图像中的每一个获得的对象关键字的频率,确定要反映到元宇宙的虚拟空间上的对象;并生成与所确定的对象相对应的对象内容。

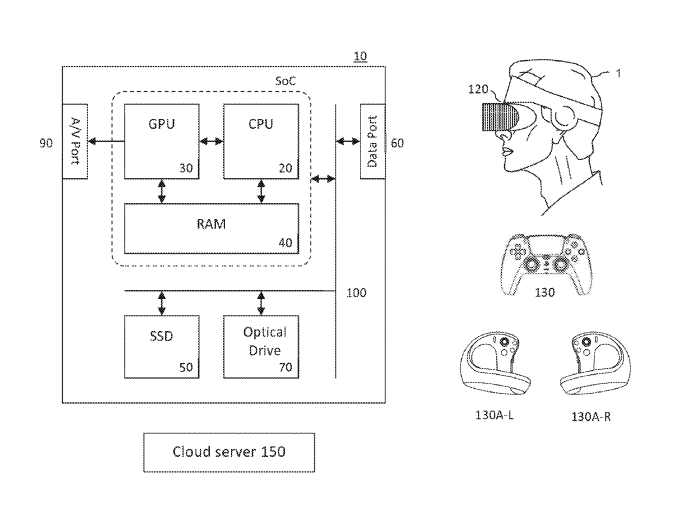

25. 《Sony Patent | Data processing method and system(索尼专利:数据处理方法和系统)》

在一个实施例中,渲染虚拟环境的图像,获得虚拟环境的至少一部分的一个或多个叠加图像,叠加图像用于叠加在虚拟环境的渲染图像的至少一部分上,并且虚拟环境的所述渲染图像的所述至少一部分和所述一个或更多个叠加图像具有一种或更多种不同的视觉特性。

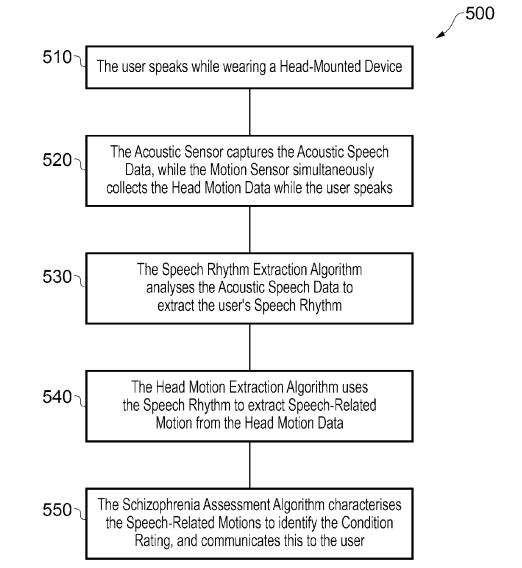

26. 《Sony Patent | A system, computer program and method(索尼专利:系统,计算机程序和方法)》

在一个实施例中,专利描述的系统用于确定用户是否存在精神分裂症。系统包括配置为接收与用户说话相关的语音数据和指示用户头部运动的运动数据的电路。所述运动数据由用户佩戴的设备捕获。然后,比较语音数据和运动数据以预测与语音相关的运动,并基于语音相关运动确定精神分裂症参数。

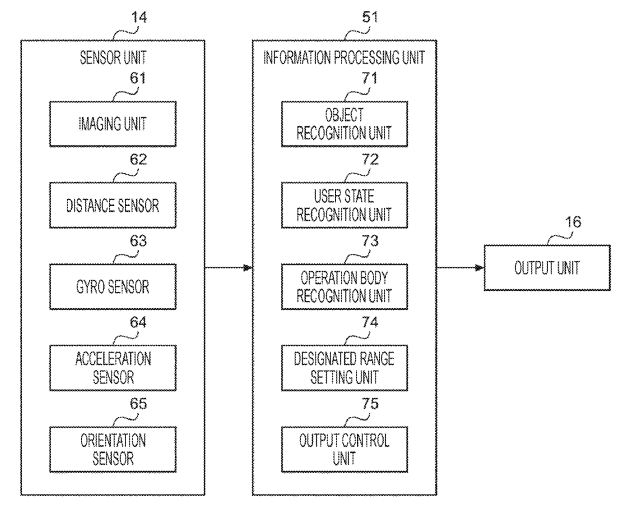

27. 《Sony Patent | Information processing device and information processing method(索尼专利:信息处理设备和信息处理方法)》

在一个实施例中,信息处理设备包括:识别目标对象状态的对象识别单元;识别操作体的状态的操作体识别单元;以及指定范围设置单元,其基于目标对象的状态或操作体的状态中的至少一个来设置指定范围。

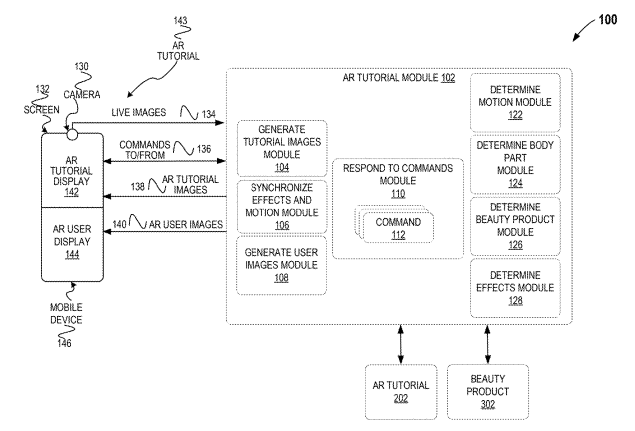

28. 《Snap Patent | Augmented reality beauty product tutorials(Snap专利:增强现实美容产品教程)》

在一个实施例中,在屏幕的第一部分上显示美容产品教程,教程包括演示者将美容产品应用于演示者身体部位的预录图像,并确定指示对用户实时图像进行更改的第一效果,以模拟将美容产品应用于用户身体部位。处理用户的实时图像以添加美容产品的第一效果和运动指示,并在屏幕的第二部分显示处理后的用户实时图像。

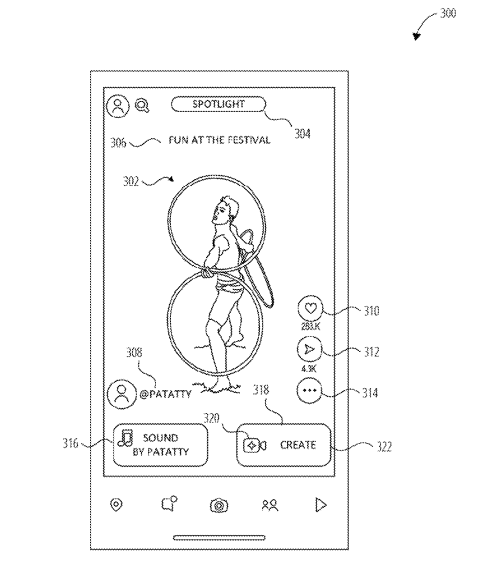

29. 《Snap Patent | Generative model for creating sharable content items(Snap专利:创建可共享内容项的生成模型)》

在一个实施例中,系统通过交互应用程序访问多个先前捕获的内容项,并识别与可共享内容对应的一个或多个标准匹配的多个先前捕获的内容项中的一组内容项。系统对内容项集进行排名。系统通过生成式机器学习模型分析每个排名的内容项集合,以自动修改排名的内容项目集合中的每个内容项,对排名的内容条目集合中的每一个内容项应用唯一的修改。系统生成可共享的内容项馈送,所述内容项馈送包括经修改的内容项的排名集。

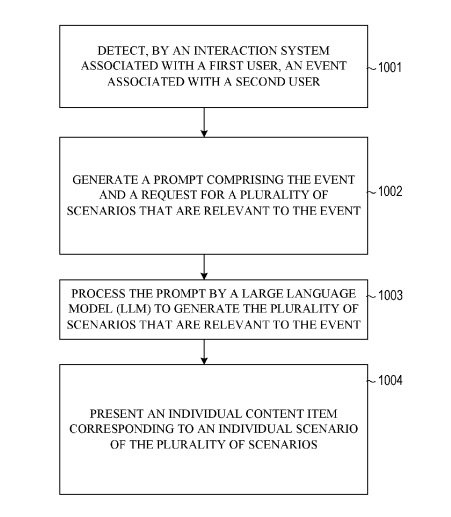

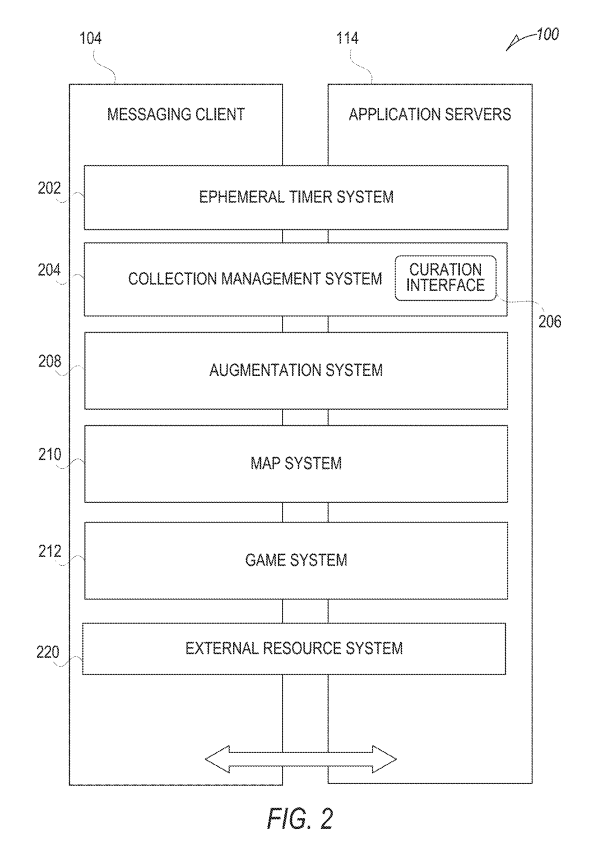

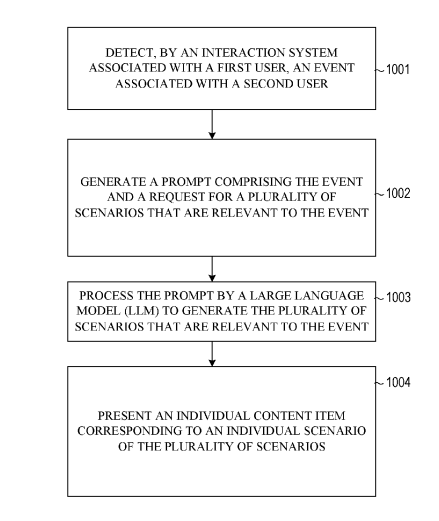

30. 《Snap Patent | Generating image scenarios based on events(Snap专利:基于事件生成图像场景)》

在一个实施例中,系统通过与第一用户相关联的交互系统检测与第二用户相关的事件,并生成包括该事件和对与该事件相关的多个场景的请求的提示。系统通过大型语言模型(LLM)处理提示,以生成与事件相关的多个场景,并呈现与多个场景中的单个场景相对应的单个内容项。

31. 《Snap Patent | Mirror-based augmented reality experience(Snap专利:基于镜像的增强现实体验)》

在一个实施例中,接收描绘人的视频。识别人的一组骨骼关节。基于该组骨骼关节的定位来识别视频中描绘的人的姿势。基于人的姿势确定视频包括人的镜面反射。响应于确定所述视频包括所述人的镜像,在所述视频中显示3D虚拟对象。

32. 《Snap Patent | Generative model for suggesting image modifications(Snap专利:用于建议图像修改的生成模型)》

在一个实施例中,系统通过交互应用从多个先前捕获内容项中选择与对应于可共享内容的一个或多个标准匹配的单个内容项,并生成包括单个内容项和对单个内容项的多个建议修改的请求的提示。系统通过大型语言模型(LLM)处理提示,以生成对单个内容项的多个建议修改,并生成与多个建议的修改中的单个建议修改相对应的修改后的单个内容项。

33. 《Snap Patent | Generating image scenarios based on llm prompts(Snap专利:基于LLM提示生成图像场景)》

在一实施例中,设备生成包括个人统计和日期的第一提示,并通过大型语言模型(LLM)处理第一提示,以生成多个想法,每个想法包括各自的描述和氛围。所述方法和系统生成第二提示,所述第二提示包括从所述多个想法中选择的想法和对与所选想法相关的多个场景的请求,由LLM处理第二提示以生成与所选思想相关的多个子场景,并呈现与所述多个子场景中的单个场景相对应的单个内容项。

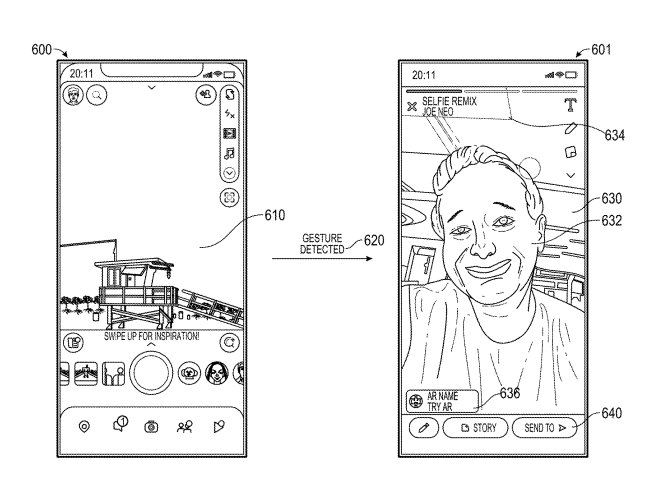

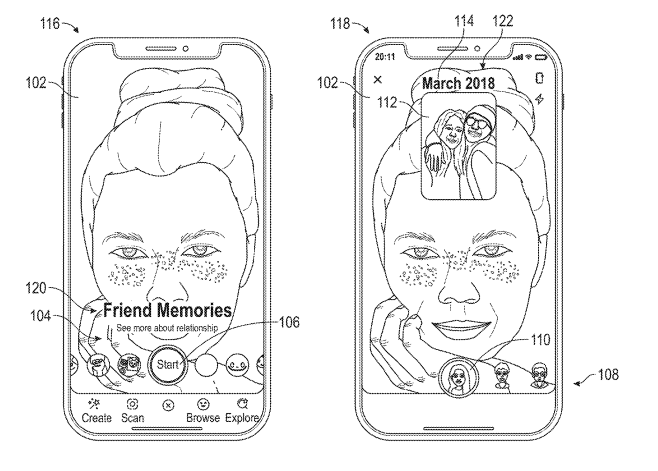

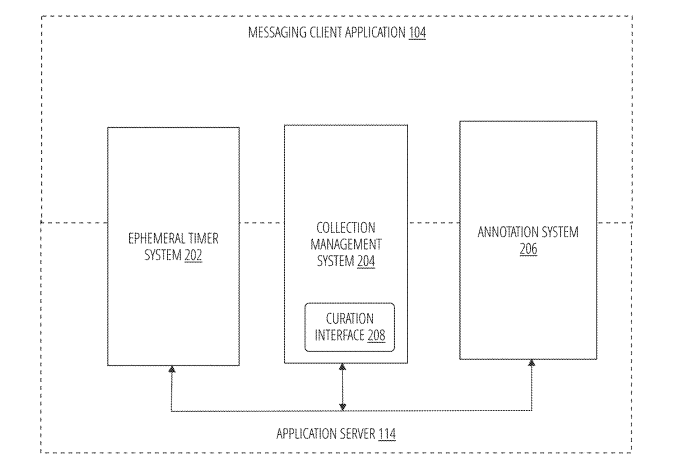

34. 《Snap Patent | Memories and moments in augmented reality (ar)(Snap专利:增强现实中的记忆和时刻)》

在一个实施例中,呈现摄像头界面,摄像头界面显示由第一用户的计算设备的摄像头捕获的第一图像,在摄像头界面内呈现多个增强图标,每个图像增强图标与相应的图像增强机制相关联,检测用户对多个图像增强图标中的辅助增强图标的选择,第二图像图标与第二图像增强机制相关联,确定第二图像扩展机制的第二图像选择标准,基于第二图像选择标准选择第二图像,第二图像是从与第一用户相关联的多张照片中选择的,并将第二图像叠加在第一图像上以生成合成图像。

35. 《Snap Patent | Camera effects shortcut with audio track selection option(Snap专利:带音轨选择项的摄像头效果快捷方式)》

在一个实施例中,显示现有视频,视频包括指定应用于现有视频的增强效果数据和效果指示器。选择效果指示器会将增强效果应用于来自摄像头的视频馈送。与现有视频一起显示的包括音频上下文指示器,以用于标识与现有视频播放的音轨。音频上下文指示器的选择提供了一个用户界面选项,以用于捕获新视频以及伴随新视频的音轨。

36. 《Snap Patent | Speech-based selection of augmented reality content(Snap专利:基于语音的增强现实内容选择)》

在一个实施例中,专利描述的系统包括存储用于显示增强现实内容的程序和方法的计算机可读存储介质。系统提供由设备接收语音输入以选择用于显示的增强现实内容;确定语音输入中包括的至少一个关键字;从多个增强现实内容项中识别与所述至少一个关键字对应的增强现实内容项目;以及将增强现实内容项与设备摄像头捕获的图像一起显示。

37. 《Snap Patent | Efficient avatar creation with mesh penetration avoidance(Snap专利:避免网格渗透的高效Avatar创建)》

在一个实施例中,接收第一Avatar的第一身体特征、访问与第一身体特征对应的第一Avatar中的第一身体网格、接收第一Avatar的第一附件特征、访问对应于第一附件特征的第一附件网格以及识别第一身体网格的确定为穿透第一附件网格的第一部分来有效创建具有网格穿透避免的Avatar。穿透是在接收第一身体特征之前确定。系统修改第一身体网格的确定为穿透第一附件网格的第一部分以生成更新的身体网格,将第一附件网格应用于更新的第一身体网格以生成第一Avatar,并显示第一Avatar。

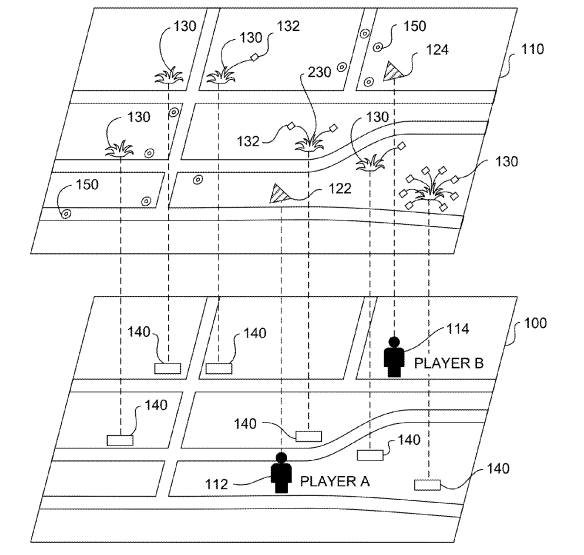

38. 《Niantic Patent | Llm-based animation selection for an ar character(Niantic专利:基于LLM的AR角色动画选择)》

在一个实施例中,客户端设备通过提示大型语言模型(LLM)从AR角色的一组可能动画中进行选择来选择AR角色的动画。客户端设备使用摄像头捕获其环境的图像,并识别图像中描绘的对象。客户端设备为LLM生成提示,指示LLM基于识别的对象从AR角色的一组候选动作中进行选择。LLM向客户端设备返回响应,客户端设备从LLM的响应中提取一组选定的操作。客户端设备识别与LLM选择的动作相对应的一组动画,并渲染描绘执行动作的AR角色的AR内容。客户端设备增强捕获的图像以包括AR内容,并显示增强的图像。

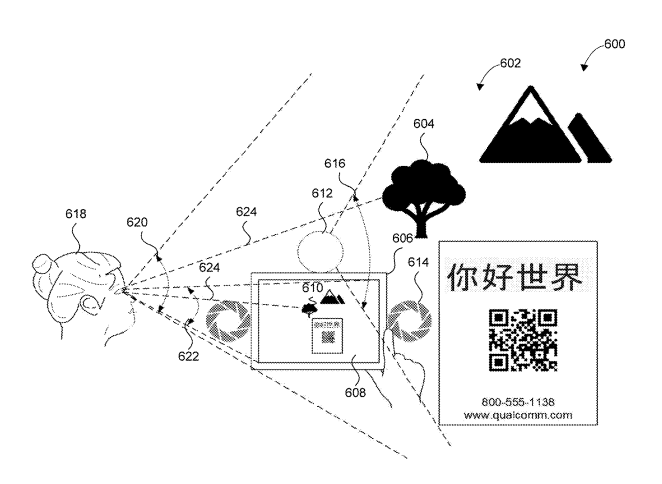

39. 《Qualcomm Patent | Displaying information based on gaze(高通专利:基于注视显示信息)》

在一个实施例中,专利描述的设备配置为:检测从第一摄像头获得的场景的图像中的对象;基于从第二摄像头获得的用户的图像,确定用户正在注视显示器显示的对象表示;并且基于相关确定,经由显示器显示与对象相关联的信息。

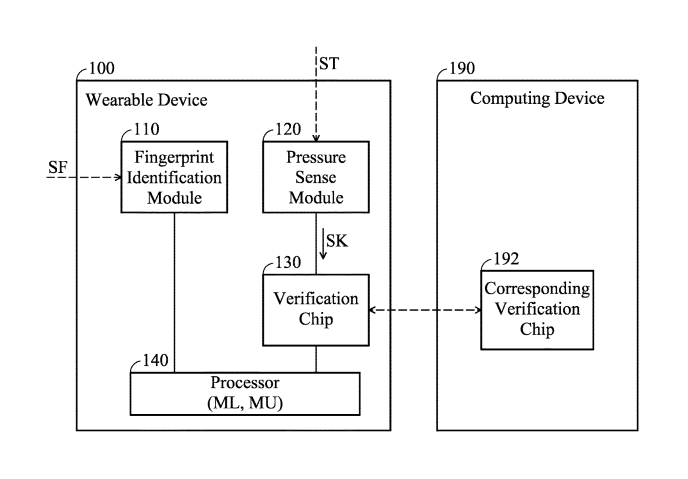

40. 《HTC Patent | Wearable device and control method thereof(HTC专利:可穿戴设备和控制方法)》

在一个实施例中,与计算设备交互的可穿戴设备包括指纹识别模块、压力感测模块、验证芯片和处理器。指纹识别模块接收指纹信号。指纹识别模块对指纹信号执行第一验证过程。压力感测模块接收触摸信号。压力感测模块根据触摸信号产生待处理信号。验证芯片对未决信号执行第二验证过程。处理器耦合到指纹识别模块和验证芯片。处理器选择性地在锁定模式或解锁模式下操作。如果第一验证过程和第二验证过程都通过,则处理器将进入解锁模式。