(

映维网Nweon

2024年11月06日

)对于好莱坞式的精确全身动捕技术,相关的设置成本相当高昂和繁杂。尽管负责Reality Labs事业群的准Meta首席技术官安德鲁·博斯沃思(Andrew Bosworth)先前表示

Quest

当前的内向外追踪无法支持全身动捕,而且未来更加难以实现,但这家公司依然在积极地进行探索,并希望能够早日研发出用于消费者头显的全身动捕技术。

根据美国专利商标局公布的一份专利申请,Meta探索的其中一项技术是利用机器学习模型来推断全身姿态。

其中,可以将来自摄像头、惯性运动单元(IMU)、陀螺仪甚至心电图(E

CG

)或心血管传感器的多个信号组合在一起,并与下半身的物理模拟相结合,以作为ML或AI模型的输入,从而确定用户下半身的可能运动。

图1示出一种示例架构10。可穿戴设备100可以包括智能眼镜100-1和腕带102(或“手表”)。

在一个实施例中,智能眼镜100-1可以包括多个传感器121,诸如惯性测量单元、陀螺仪、麦克风、摄像头等。可包括在可穿戴设备100中的其他传感器121可以是磁力计、光电二极管和相机、触碰传感器和诸如电容传感器、压力传感器等的其他电磁设备。智能眼镜100-1可进一步包括声学麦克风125-1和接触式麦克风125-2。

在一个实施例中,用户101可以使用移动设备110收集下半身的图像,并将数据输入经过训练以生成用户101下半身化身的ML或AI算法。

所以,来自传感器121和麦克风125的数据可以包括在数据集103中,并通过运行在头显100、移动设备110或服务器130中的沉浸式现实应用进行分析,以馈送下半身动画模型并为沉浸式现实应用中的用户101提供全身化身。

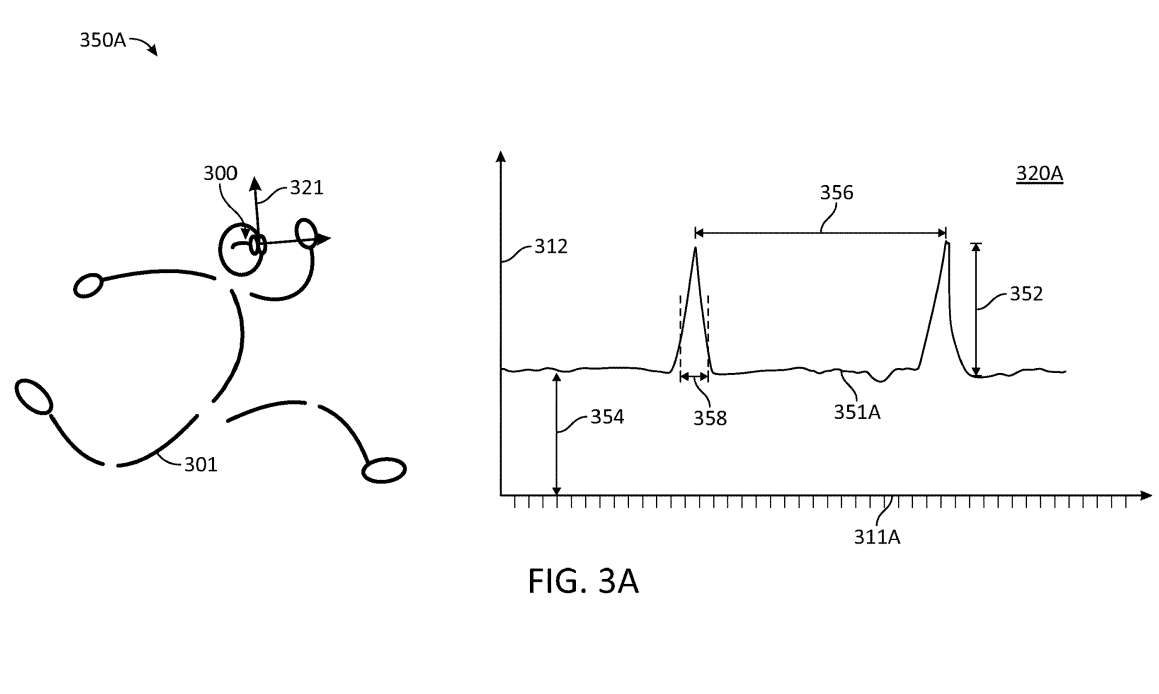

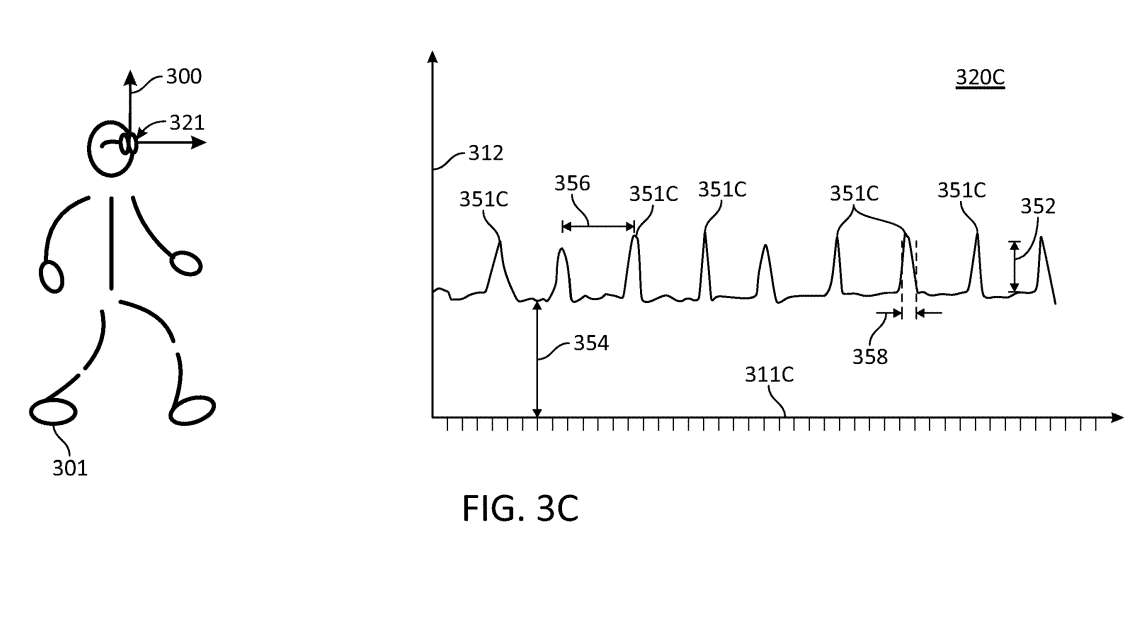

图3A-3C说明了用于用户301的下身运动的不同配置350A、350B和350C,以及指示其的相关信号351A、351B和351C。

信号351可由智能眼镜300中的传感器321收集。传感器321可以是IMU传感器、PPG传感器、ECG传感器或麦克风。图320包括纵坐标中的幅度312(例如,电压、电流、电阻、磁场、电感等的电输出),以及横坐标中的时间标度311A、311B和311C。

在配置350A中,用户301以较快的速度跑步。信号351A包括在时间尺度311A中广泛分离的宽强峰。

在配置350B中,用户301以比配置350A更慢的速度跑步。信号351B包括在可能类似于时间尺度311A的时间尺度311B中更窄地分离的可变峰。

在配置350C中,用户301正在行走,并且始终有一只脚与地板接触。信号351C在较宽的时间尺度311A中包含较宽和较弱的峰。

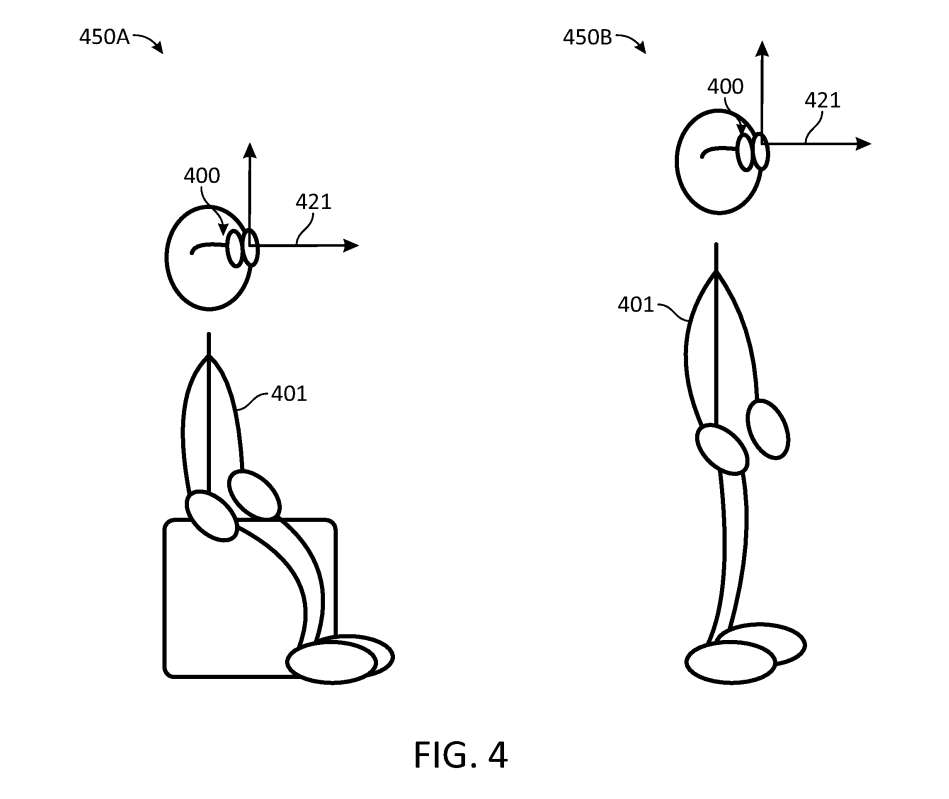

图4示出用户401的不同姿势450导致不同的下身配置450A和450B。所以,系统将确定配置450中用户401的下半身姿势,并提供与用户的上半身合并的模型,以合并为用户401的全身化身。

在配置450A中,用户401处于坐位状态。传感器421可以检测头显400相对于地面的较低高度,结合对用户401高度的先验知识,可以得出用户正坐着的合理指示。另外,用户的膝盖或脚可能出现在头显400摄像头的视场中,从而进一步确认用户的姿态。

在配置450B中,用户为站立状态。传感器421可以检测到头显400相对于地面的较高位置。预先知道用户401的高度可以作为用户站立的证据。另外,传感器421可以包括一个摄像头,其中用户401的下肢缺失,就像站立配置450B中的情况一样。

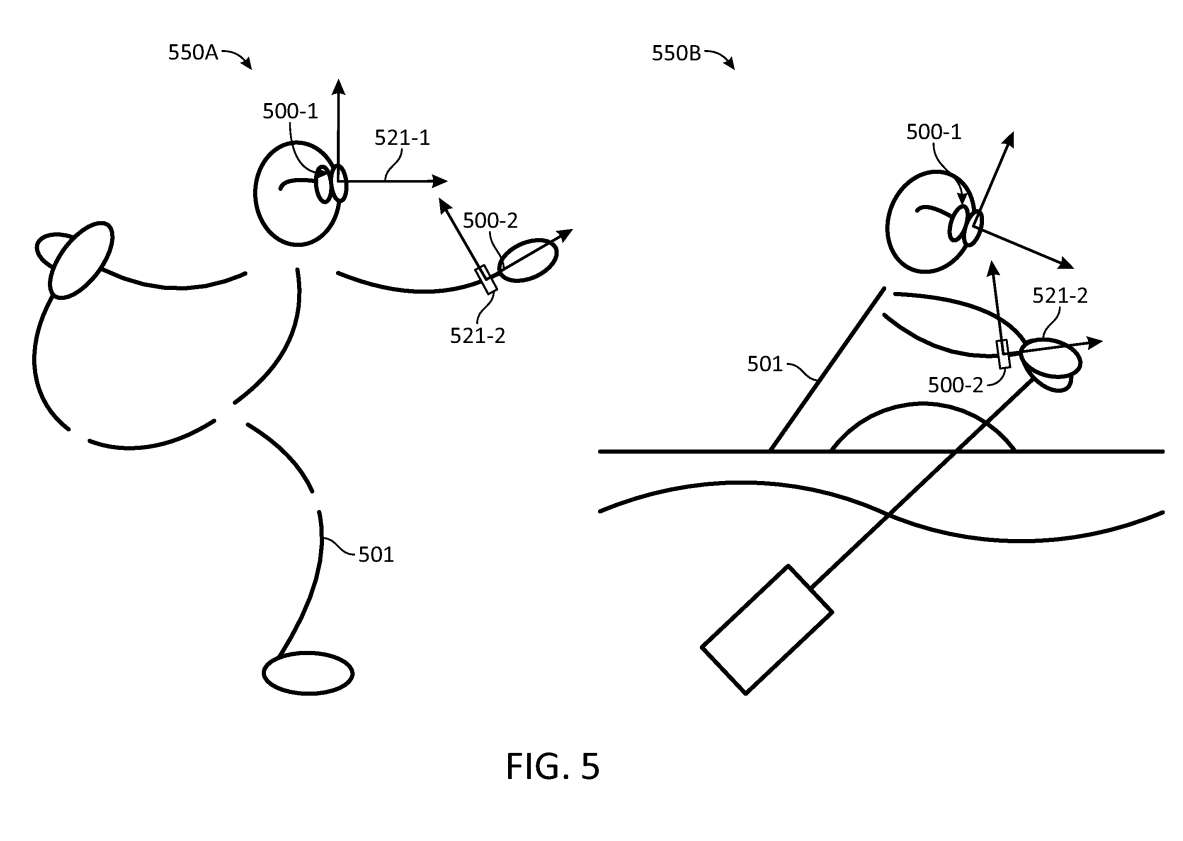

图5示出了头显500-1和手腕设备500-2的用户501的不同活动550A和550B,并导致不同的下身配置。

可穿戴设备500可以相互通信,共享由传感器521-1(头戴式设备500-1)和521-2(手腕设备500-2)提供的相对位置和方向信息。信息可并入下身模型中,以提供用户501的准确姿势和运动。另外,ML和AI模型可以训练收集执行高度风格化练习(芭蕾舞、滑冰、滑冰、划船、骑自行车等)的被试图像。

活动550A可以包括有风格的舞蹈姿势,如芭蕾舞、滑冰、滑冰或重型健美操。因此,用户501的下肢,例如脚、腿以及用户501的手可以出现在摄像头521-1的视场中。

活动550B可能包括上半身的剧烈运动(如划船)。传感器521可以检测用户501的腿、膝盖和脚,甚至船的后部和水体。另外,传感器521-2可以检测手臂和身体的有节奏的运动,与划船姿态550B一致。

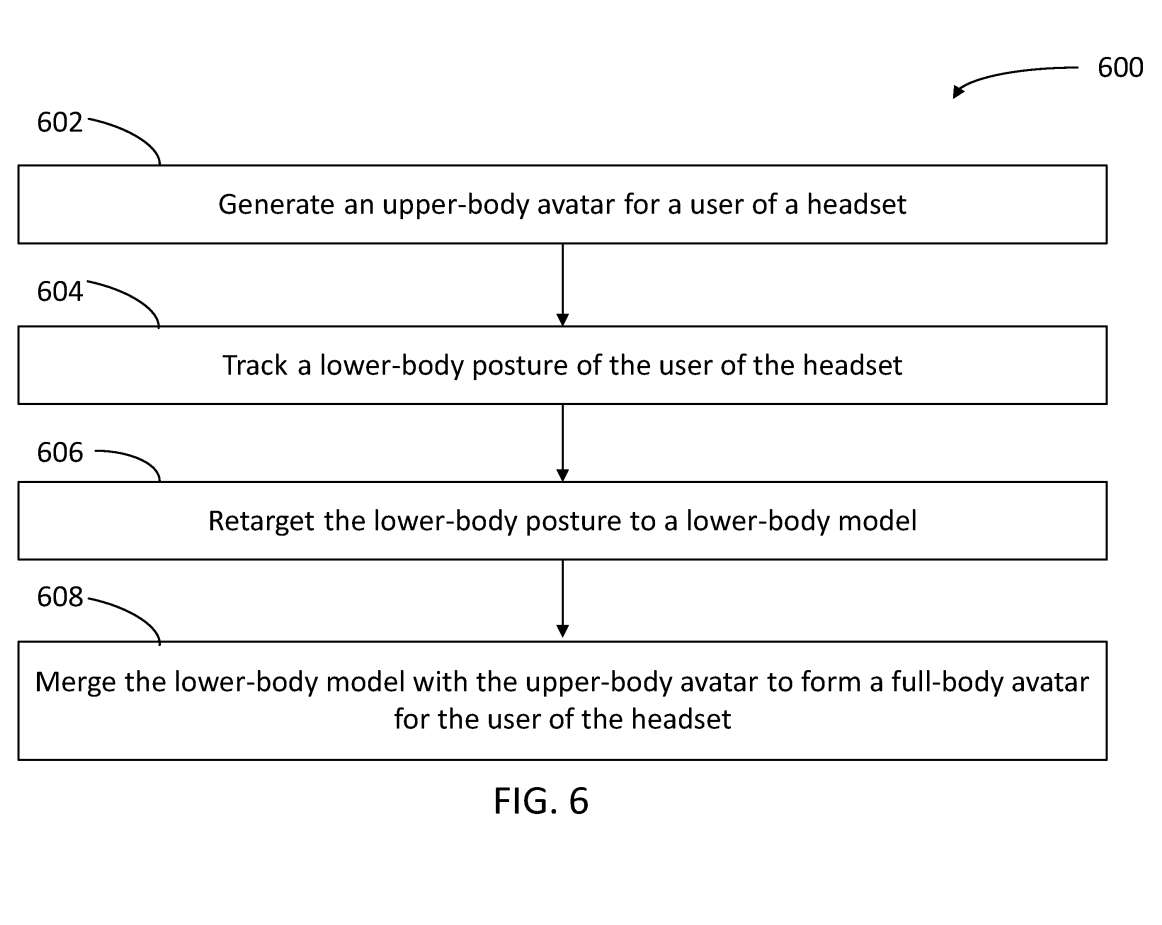

图6示出预测下半身动画的方法流程图。

在602,为头显用户生成上身化身,包括使用安装在头显的传感器追踪用户的面部姿态。

在604,追踪头显用户的下半身姿势,包括使用安装在头显的摄像头收集用户的手臂、腿、手或脚中的至少一个的图像。步骤604包括从移动设备接收用户下半身姿势的图像。步骤604包括接收来自头显惯性测量单元的加速度信号。步骤604包括从来自惯性运动单元的加速信号中的频率识别跑步运动或行走运动。步骤604包括识别用户的坐姿或站立姿势。步骤604包括基于用于下身运动的物理约束确定下身姿势。

在606,包括将下半身姿势重新定位到下半身模型。步骤606包括优化下身模型中的损失函数,将下身姿势作为损失函数的ground truth基线。

在608,将所述下半身模型与所述上半身化身合并,以形成所述头显用户的全身化身。

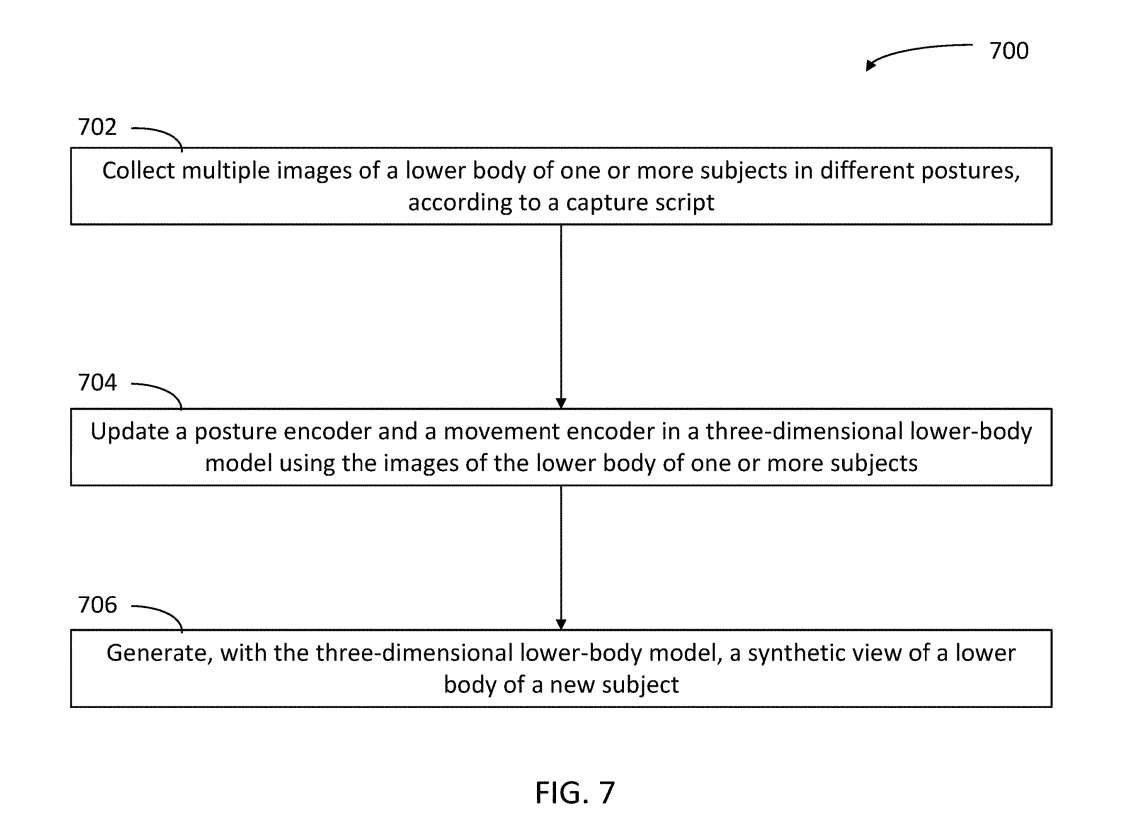

图7示出用于训练模型以提供对象的视图。

在702,根据捕获脚本收集处于不同姿势的一个或多个被试下半身的多个图像。

在704,使用一个或多个被试下身图像在3D下身模型中更新姿势编码器和运动编码器。

在706,生成具有三维下身模型的新主体下身的合成视图。步骤706包括识别来自指示一个或多个主体的不同姿势的运动传感器的信号。不同的姿势包括受试者的健美操姿势,步骤706进一步包括收集来自心率信号并使用心率信号更新运动编码器。

在一个实施例中,步骤706包括基于新主体的图像和新主体下半身的合成视图之间的差异来训练3D下半身模型。

在一个实施例中,步骤706进一步包括将所述新主体的3D下身模型与所述新主体的上半身模型合并,以形成所述新主体的全身模型。

在一个实施例中,步骤706进一步包括向沉浸式应用程序提供3D下身模型。

相关专利

:

Meta Patent | Predicting lower body movement for avatars

名为“Predicting lower body movement for avatars”的Meta专利申请最初在2023年3月提交,并在日前由美国专利商标局公布。