(

映维网Nweon

2024年10月28日

)AR/VR头显越来越多地使用

眼动追踪

系统来追踪用户眼睛的位置和/或运动。所以,厂商正积极探索优化眼动追踪精度,稳定性和功耗的方法。

在一份专利申请中,

苹果

就提出了同时使用图像数据和超声数据的混合注视追踪方法。这家公司指出,以各种组合方式使用超声数据和成像数据的注视追踪可实现较低的功耗率,并且同时使用成像数据和超声数据的注视追踪比单独使用任何一种方法都更稳健,因为成像数据受温度、压力和气流的影响较小,而超声数据受杂散光的影响较小。

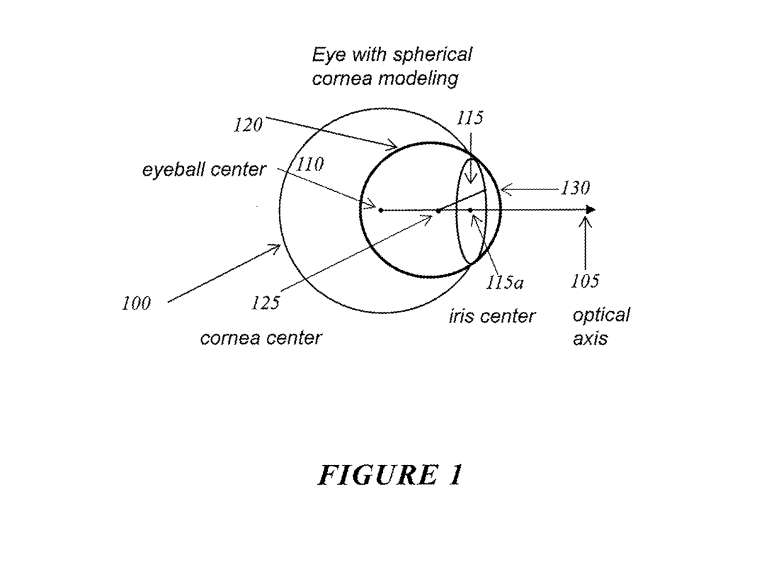

图1是描述眼球的3D表示,可以为每个用户独立地或唯一地生成眼睛100的眼球模型。

在一个实施例中,可以识别光轴105并用作眼睛100注视方向的指示。视轴是用户感知到的实际注视方向,并且与光轴105具有角偏移。视轴和光轴105之间的角偏移量因人而异。

在一个实施例中,估计眼睛的注视方向是基于确定光轴的两个位置。可以确定虹膜中心115a的3D空间位置和角膜中心125的3D空间位置作为光轴105的两个位置。另外,可以确定眼球旋转中心110的3D空间位置和角膜中心125的3D空间位置作为光轴105上的两个位置。这两个位置可以基于来自设备各种传感器的信息来确定。

在一个实施例中,基于识别角膜120的空间属性来确定角膜中心125的位置。例如,角膜的3D空间位置可以使用传感器确定。然后可以根据角膜和角膜模型的空间位置确定角膜中心125的位置。可以分析由注视追踪摄像头捕获的用户眼睛的图像以检测来自光源和瞳孔的闪烁。

在一个实施例中,超声传感器可以通过将距离测量的点云与眼睛100的已知模型相匹配来确定眼睛位置,从而确定眼睛100的位置/方向。

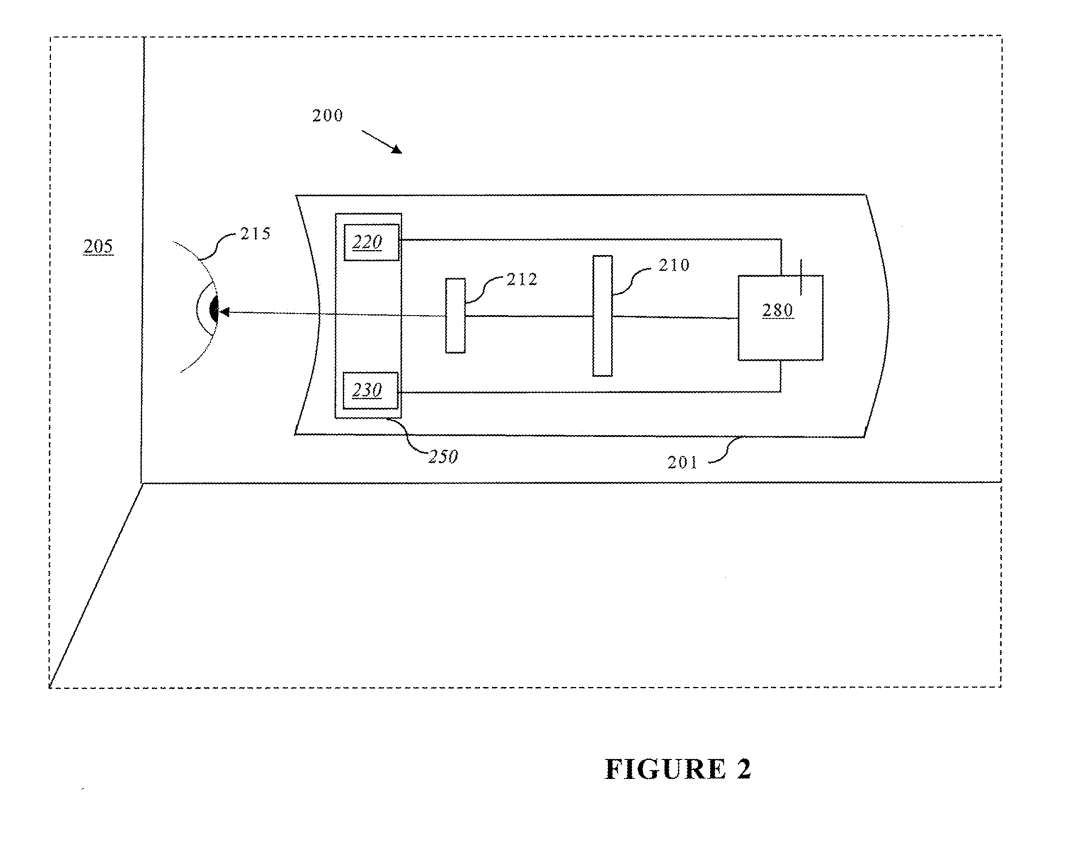

图2示出一个头显框图。头显200包括可以检测眼球位置和眼球运动的注视追踪系统。

壳体201容纳注视追踪系统250,包括成像系统220、超声系统230和控制器280。在一个实施例中,可以分析注视追踪系统250捕获的图像或深度信息,以检测用户眼睛的位置和运动,或检测一只或两只眼睛的注视方向。

基于来自成像系统220和超声系统230的数据,控制器280可以确定用户215的注视追踪特性。例如,控制器280可以确定用户215的一只眼睛或两只眼睛的注视方向。在另一示例中,控制器280可以确定用户215的眨眼状态(睁眼或闭眼)。作为又一示例,控制器280可以确定跳眼运动、瞳孔中心、瞳孔大小或注视点。

在一个实施例中,显示器210发射第一波长范围内的光,而成像系统220使用第二波长范围内的光。第一波长范围是可见波长范围(例如约400-700 nm的可见光谱内的波长范围),第二波长范围是近红外波长范围(例如约700-1400 nm的近红外光谱内的波长范围)。

在一个实施例中,超声系统230和成像系统220集成或组合它们的操作以执行注视追踪。成像传感器可以使用瞳孔加闪烁模型来确定注视方向。

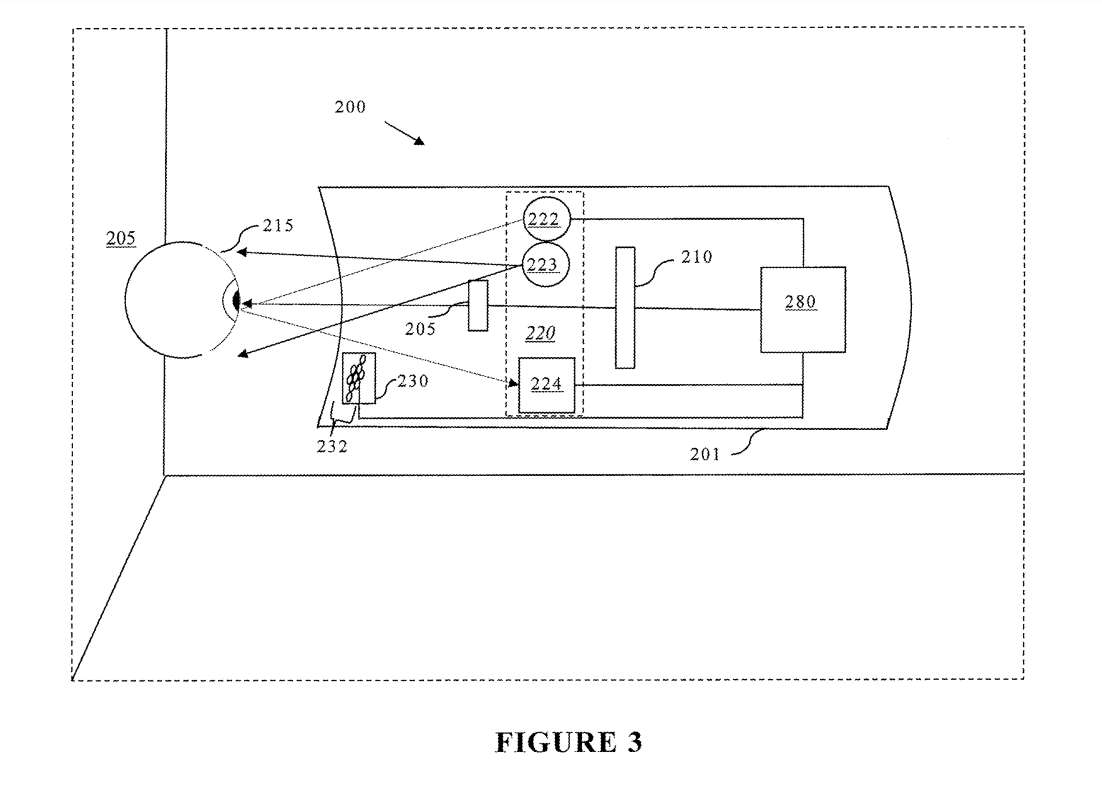

图3示出另一个头显框图。注视追踪系统250的成像系统220包括一个或多个光源222,用于将光发射到用户215的眼睛,所述光源222作为可由图像传感器224检测到的光图案反射。

在一个实施例中,超声系统230(图2)使用仅在空气中传播数厘米的频率。用于超声系统230的超声传感器232包括多个阵列(例如直径1-3毫米),每个阵列包括50-100个不同的超声谐振器,其可以测量超声信号的相位、幅度和频率。在一个实施例中,超声传感器232使用压电微机械超声换能器。

在一个实施例中,用于超声系统230的超声传感器232包括至少一个配置为向用户215的眼睛发射超声的超声发射器和多个配置为接收由超声与用户215的眼睛相互作用产生的回波的超声接收器。

在一个实施例中,多个超声接收器相对于至少一个超声发射器具有规定的空间布置。超声传感器232利用来自一个超声发射器的超声的特征(例如时间、相位、幅度)和多个超声接收器中的每一个接收的回波来确定眼睛在3D坐标空间中的深度信息。

在一个实施例中,用户215眼睛的深度测量是通过启动单个超声发射器并测量与单个超声发射器具有预设3D空间关系的一组超声接收器的谐振信号来确定。

在一个实施例中,用户215的眼睛的深度测量是通过在各种频率上启动多个超声换能器来确定,使得在调谐到相同频率的超声接收器上观察到的相位仅与一个深度一致。超声发射器的布置和超声接收器的设置所需要的发射和接收的信号只满足一个距离,即深度。

在一个实施例中,通过同时启动多个超声发射器并测量产生不同组空间排列的超声接收器的相应共振信号来确定用户215眼睛的深度测量。在一个实施例中,依次确定来自超声传感器232的用户215的眼睛的深度测量值。来自超声传感器232的深度数据帧包括用户215的眼睛的一部分或整个眼睛。

当超声传感器232的深度测量与来自成像系统220的数据相结合时,可以减少深度测量的次数或深度测量的帧速率。例如,当与来自成像系统220的数据相结合时,来自超声传感器232的深度测量的帧率可以是10 Hz, 20 Hz或40 Hz。所以,可以降低来自超声传感器232的深度测量的帧速率,并且依然足以解释成像系统220基光测量。

在一个实施例中,当超声传感器232的深度测量值与来自成像系统220的数据相结合时,可以减少来自成像系统220的数据类型或数据类型的量。例如,当从超声传感器232知道用户215眼睛的位置时,图像传感器224可用于定位图像中的瞳孔并通过检测图像中的角膜闪烁来测量方向矢量。然而,角膜闪烁的深度信息可由超声传感器232提供。

在一个实施方案中,超声系统230的超声测距精度受到气流的影响;温度波动或压力波动,不影响来自成像系统的图像传感器或深度传感器的范围测量220。所以,成像系统220的距离测量值可作为参考值,用于校正漂移或用于超声系统230的超声距离测量的现场校准。

在一个实施例中,成像系统220的基于光的测量质量受到杂散光的影响,不影响来自超声系统230的超声传感器的超声发射器/接收器的距离测量。所以,超声系统230的超声距离测量值可以用作参考值,以纠正不正确的眼位估计或用于成像系统220的现场校准。

所以,来自注视追踪系统250的成像系统220和超声系统230的数据的组合提供了更稳健的注视追踪功能。

在一个实施例中,成像系统220和超声系统230各自产生表示其数据或当前测量的可靠性的信号。当所述成像系统220可靠性降低时,可对所述成像系统220进行数据可靠性监控,并且可优先对所述超声系统230进行注视追踪。

在一个实施例中,当超声系统230可靠性降低时,可以对超声系统230进行数据可靠性监测,并且可以优先对成像系统220进行注视追踪。

在一个实施例中,电子设备配置为交替地在多个注视追踪模式中操作或在多个注视追踪模式之间切换,其中注视追踪模式的每个模式使用图像传感器的第一数据和超声传感器的第二数据的不同组合。例如,注视追踪模式的每种模式使用成像系统220的第一数据和超声系统230的第二数据的不同组合。

在一个实施例中,超声系统230在第一时间段内始终使能用于注视追踪的第一模式。在一个实施例中,超声系统230始终使能用于注视追踪,但可以在选定条件下触发成像系统220用于注视追踪。例如,成像系统220的注视追踪可以基于头显 200正在使用的特定应用或功能触发。

在一个实施例中,超声系统230提供比成像系统220精度更低的注视追踪。所以,根据所述注视追踪的所需精度,选择所述超声系统230或所述成像系统220进行注视追踪。

图5示出同时使用成像数据和超声数据的混合注视追踪的流程图。混合注视追踪比单独使用任何一种方法都更稳健,因为成像数据受温度、压力和气流的影响较小,而超声数据受杂散光的影响较小。

使用超声数据和光测量数据的不同组合来有效地对抗环境噪声、获得所需的精度、获得所需的功耗率或其组合。

在510,使用眼睛的第一图像中的基光测量来检测眼睛的第一属性。

在520,根据深度信息确定3D坐标系中与第一属性关联的第一位置。

在530,使用来自基于超声的眼睛测量的深度信息来检测眼睛的第二属性。

在540,基于来自超声传感器的深度信息和眼睛部分的3D模型确定与3D坐标系中的第二属性关联的第二位置。

在550,基于第一位置和第二位置确定3D坐标系中的注视方向。

相关专利

:

Apple Patent | Hybrid gaze tracking system

名为“Hybrid gaze tracking system”的苹果专利申请最初在2024年2月提交,并在日前由美国专利商标局公布。