(

映维网Nweon

2024年10月23日

)手语是用手势比量动作,根据手势的变化模拟形象或者音节以构成的一定意思或词语,它是听力障碍或者无法言语的人互相交际和交流思想的一种重要手段。

手语学习并不容易,而且不同地区的手语不一定通用。所以,

索尼

在一份专利申请中提出了一种翻译手语的方法。

在一个实施例中,首先捕获来自一种语言的手语并将其转译成文本。一旦以文本形式出现,就会进行语言转译,例如将日语转译为英语,然后再以图形插图的形式生成手语。图形插图可以包括Avatar的一双手,或者具有面部和手臂的Avatar执行手势。

在一个实施例中,执行一种方法以微调第一手语的输出以去除外来单词或去除本地区域符号,并且可以有针对性地进行微调。

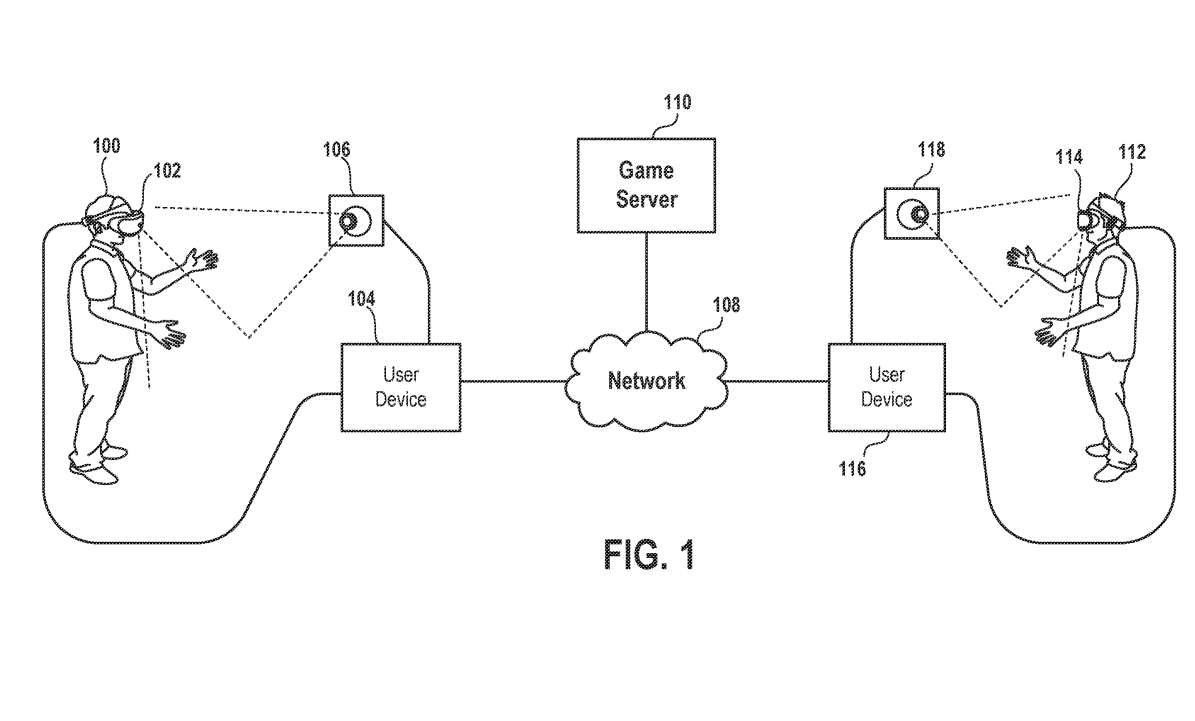

图1说明了位于远程位置的两名用户使用手语进行交互。

用户设备104和用户设备116通过网络108与游戏服务器110进行通信。游戏服务器110执行游戏的共享会话,维护游戏及其虚拟环境的规范状态,并且用户设备104和116与虚拟环境的状态同步。这样,用户100和用户112就可以在同一个虚拟环境中相互共享和交互。

用户100和用户112可以由虚拟环境中的相应Avatar表示。当用户100和112在虚拟环境中参与互动时,他们的Avatar可以配置成模仿他们的动作。然而,如果用户100和112使用不同的首选手语进行交流,则交流可以从一种手语翻译成另一种手语,反之亦然。

例如,用户100可以使用第一手语进行通信,但用户100在虚拟环境中的Avatar将配置为向第二用户112显示以第二手语执行手势(第二手语是用户112的首选手语)。类似地,用户112可以使用第二手语进行通信,但用户112在虚拟环境中的Avatar将配置为向用户100显示以用户100的首选手语的第一手语执行手势。

例如,用户100可以使用美国手语(ASL)执行手势,而用户112使用日本手语(JSL)执行手势。当用户100以ASL中执行手势时,相关手势将转译成JSL。当用户112在JSL中执行手势时,相关手势转译成ASL。

在一个实施例中,可以分析捕获给定用户的视频和音频,以识别或确定用户的第一手语手势通信的内容,然后将手势通信转译成呈现给另一用户的第二手语。转译后的手语通过与用户关联的Avatar呈现,以便对其他用户显示为使用第二种手语执行手势。

应当理解的是,系统能够检测给定用户何时执行应转译的交际手势,而不是执行不应转译的手势。例如,用户可能会做出非交流手势来与虚拟环境中的对象进行交互,而相关手势应该由他们的Avatar忠实地呈现和执行。

然而,当用户使用手语与另一个用户交流时,系统就会转译他们的手语交流。所以,系统会根据用户所做手势的上下文来确定手势是不是应该转译的手语手势。

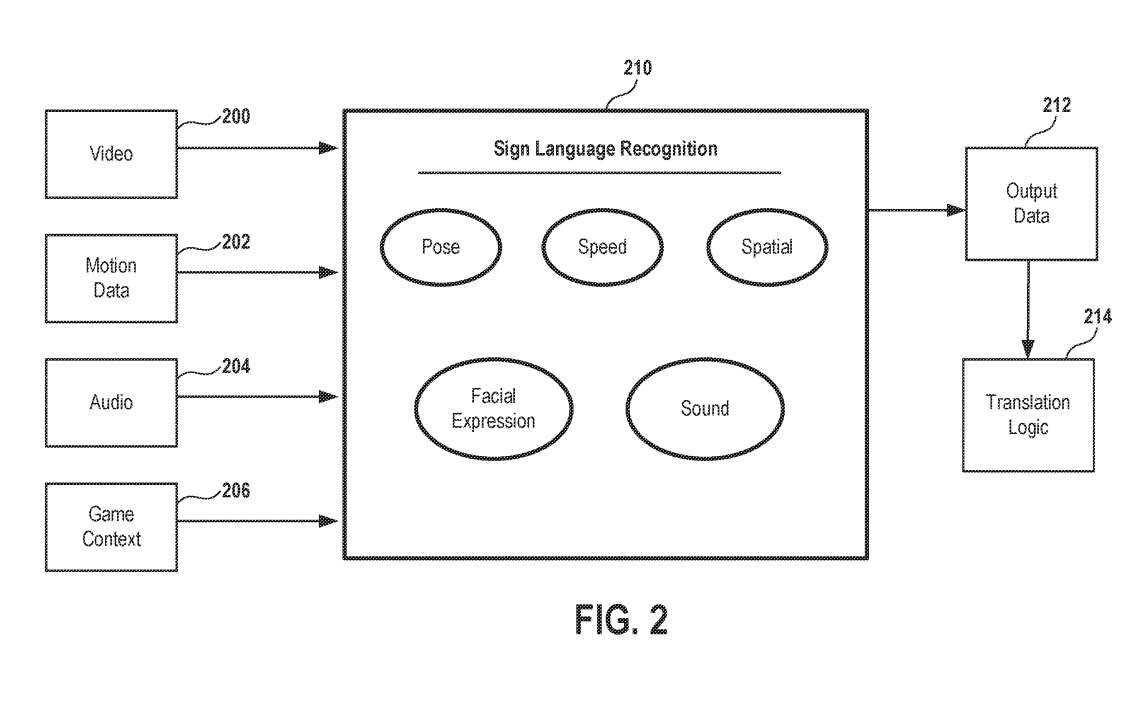

图2示出了手语识别逻辑和由手语识别逻辑使用的各种输入。

在所示的实施例中,实现手语识别逻辑210,以确定给定用户何时正在做出交流手势,如果是,则通过诸如根据特定手语识别手势来确定交流手势的内容或语义含义。应当理解的是,手语识别逻辑210可以利用各种输入。

在一个实施例中,识别逻辑210配置为确定用户是否实际上尝试做出交际手语手势。因为在游戏等虚拟环境中,用户可能会做出多种手势,而并非所有手势都是手语交流,所以,系统不应该尝试转译所有手势,而应该只转译真正需要的交流手势。

所以可以理解的是,游戏上下文206是影响用户是否可能尝试通过手语进行交流的重要数据来源。可以分析游戏情境206的几个特征示例,并使用它们来帮助确定用户是否试图通过手语进行交流。例如,可以分析用户的注视方向,这可能会或多或少地表明用户在执行手语手势。例如,当用户看着一个或多个其他用户时,则用户更有可能试图使用手语,而如果用户看着一个非用户对象,则不太可能是手语。

在另一个实施例中,用户与另一个用户的距离是一个因素,用户与任何其他用户的距离越远,则用户尝试使用手语的可能性就越小。

在一个实施例中,用户在虚拟环境中的交互性是一个因素,用户所从事的特定活动可能会或多或少地使用户尝试使用手语的可能性增加。例如,如果用户从事高强度或高速度的活动,则用户不太可能使用手语。然而,如果用户从事低强度或低速度的活动,如站在原地或坐着,用户更有可能是在使用手语。另一个例子是,如果用户正在与虚拟环境中的对象进行交互,则不太可能使用手语。

在一个实施例中,用户参与游戏玩法的特定阶段、场景、关卡、设置、位置等可以视为影响用户使用手语可能性的因素。例如,当用户位于游戏的餐厅设置时,用户可能比用户位于驾驶舱设置时更有可能使用手语。

当用户尝试使用手语时,配置所述手语识别逻辑210以识别所述手语通信并进一步确定其语义。更具体地说,手语识别逻辑210能够确定对手语交流的更准确的语义理解,而不是简单地根据用户使用的适当手语识别所使用的手语。

在一个实施例中,对手势的空间方面进行分析并用于确定手势的语义。通过分析视频200和/或运动数据202,可以确定诸如运动的幅度、用于做出手势的空间体积的大小、手臂/手运动的速度、这种运动的节奏/速度/节奏等方面。相关信息可以提供进一步的信息来帮助确定手势的语义含义。

在一个实施例中,分析用户的附加动作,例如用户的头部、身体、腿等的运动。可以通过分析视频200和/或运动数据202来确定所述动作,并且可以提供信息以帮助确定所述手势的语义含义。

在一个实施例中,从视频200中识别用户使用手语时的面部表情,并用于帮助确定语义。面部表情通常是手语的重要组成。因此,面部表情识别是手语交际识别的重要组成。

在一个实施例中,从音频204分析用户的声音,并用于帮助确定语义。例如,在使用手语时,用户可能会发出相关的声音或话语。它们可以记录为音频204,并分析以确定符号通信中的附加语义,如强调、音调和情感等。

在一个实施例中,游戏上下文206用于确定用户手语通信的含义和内容。用户的游戏情境206的各个方面,例如用户正在从事的活动、用户在游戏的虚拟环境中所处的位置、已达到的游戏阶段、用户在游戏情境中试图达到的目标等,都可以成为影响用户正在做出特定手势的可能性的因素。

应用手语识别逻辑210的结果是识别用户手语通信的内容和语义的输出数据212。在一个实现中,输出数据212采用书面语言的文本形式。书面语言是与手语的区域设置相对应的语言。例如,对于使用美国手语的用户,手语识别逻辑210可以输出书面美式英语文本。

在一个实施例中,通过转译逻辑214进一步处理输出数据212,转译逻辑214将输出数据212转译成另一种手语通信。在一个实施例中,转译逻辑214使用ML模型来执行转译,例如从文本到手语,或从一种手语到另一种手语的模型。

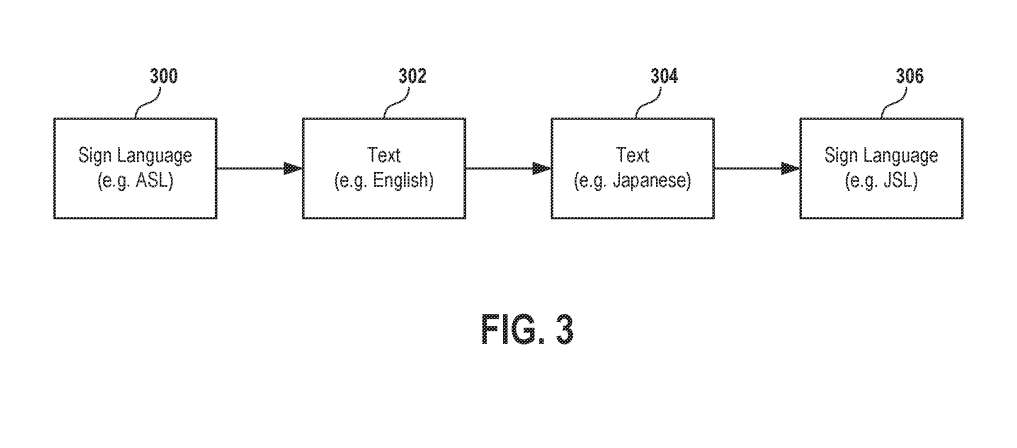

图3示出将一种手语转译成另一种手语的过程。

在所示的过程中,识别使用第一手语的用户手语通信300并将其转译成使用第一书面语言的第一书面文本302。第一书面语可以是第一手语所在地区的相应书面语。

然后,将第一书面文本302转译成第二书面文本304。第二书面文本304是用第二书面语言写成,第二书面语言可以是第二手语地区的相应书面语言。

然后,将第二书面文本304转译成第二手语的手语通信306。

这样,将用户的第一手语原始手语通信300转译成第二手语通信306。

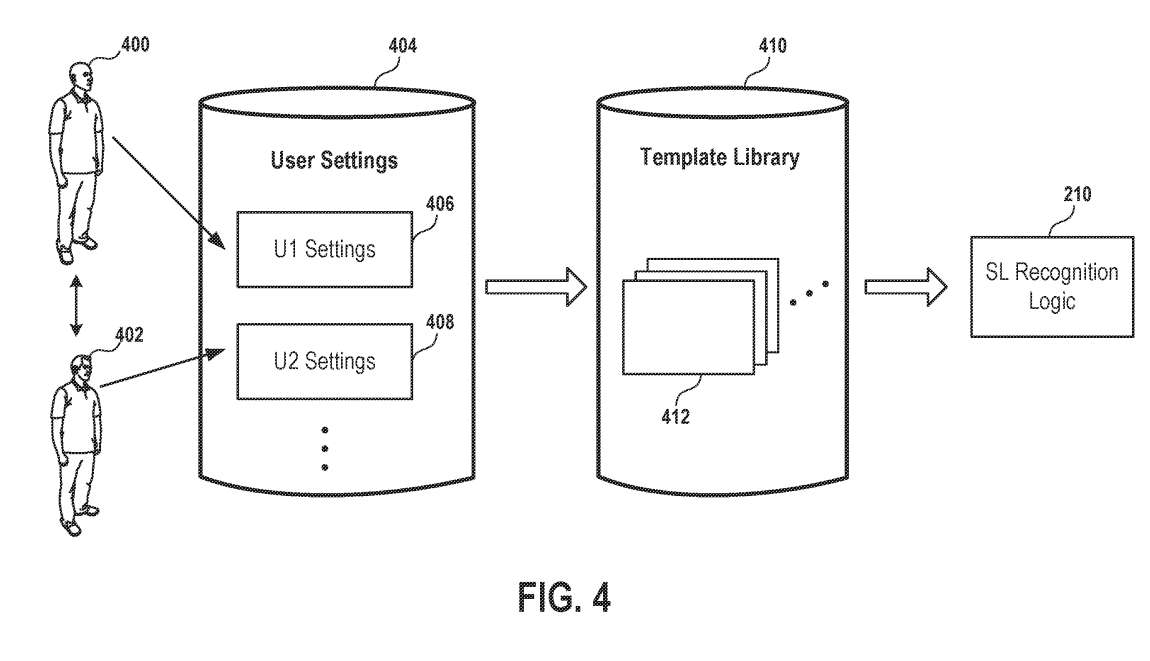

图4示出将手语通信从一种手语转译为另一种手语的模板。

在一个实施例中,识别逻辑210使用模板来实现从第一手语到第二手语的转译。在所示的实现中,第一用户400和第二用户402相互通信。所述用户的用户设置404包括针对第一用户400的设置406和针对第二用户402的设置408。设置包括每个用户的首选手语。例如,用户400的首选手语可能是ASL,而用户402的首选手语可能是JSL。模板库410包括各种模板412。

在一个实施例中,定义了模板以支持从一种手语到另一种手语的转译。例如,对于用户400的手语通信,识别逻辑根据上述用户设置选择并使用给定模板,以启用从ASL到JSL的转换。对于用户402的手语通信,则根据上述用户设置选择另一个模板并由识别逻辑使用,以实现从JSL到ASL的转换。

在一个实施例中,模板可以根据影响识别和转译的各个方面进行微调。在一个实施例中,模板可以是特定于游戏,以便根据游戏的上下文更准确地识别/转译。

在一个实施例中中,用户可以自定义模板(或设置或参数),以调整其手语通信的语气。例如,用户可以配置一个模板,以便在与队友通信时使用。模板可以使用更友好、友好或尊重的语气来转译他们的手语通信。然而,用户可能会配置另一个模板,以便在与对手交流时使用更具攻击性、对抗性或不尊重的语气。

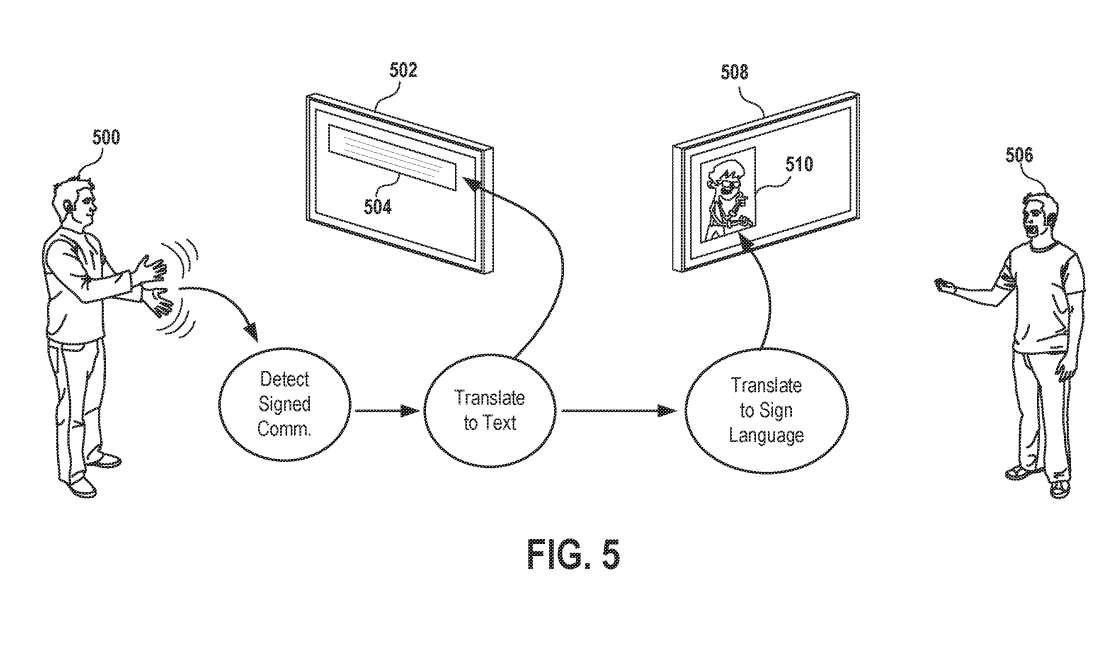

图5示出的系统向用户提供关于识别其手语通信的反馈。

应当理解,对手语通信的识别和转译可能不会令用户满意。所以,可以提供一种向用户提供关于系统如何理解其手语通信反馈的系统。

在一个实施例中,检测到第一用户500的手语通信并将其转换为书面文本。所述书面文本504可呈现在所述用户500正在查看的显示器502,从而向所述用户提供关于所述系统如何理解其手语通信的反馈。

为用户500提供了响应书面文本504的机制。例如,用户500可以通过执行预定义的手势来确认他们对其手语通信的文本转译感到满意,例如特定的签名单词或其他交际手势,例如点头、竖起大拇指等。

如果用户500对文本转译不满意,则用户500可以通过通过另一种机制提供输入来编辑文本转译。在一个实施例中,提供用户手语通信的多种可能的文本翻译,并且用户可以选择最接近其预期含义的一个。通过这种方式,用户能够向系统提供关于系统对用户手语通信的理解质量的反馈。

相关专利

:

Sony Patent | Translation of sign language in a virtual environment

名为“Translation of sign language in a virtual environmen”的索尼专利申请最初在2023年4月提交,并在日前由美国专利商标局公布。