(

映维网Nweon

2024年09月19日

)用户之于电子设备的专注状态可以对用户的体验产生显著影响。用于评估用户注意力状态的改进技术可以增强用户对内容的享受、理解和学习。内容创作者和系统可以提供更好、更定制的用户体验,从而帮助用户基于专注的状态信息来享受、理解和学习相关体验。

在名为“Attention detection”的专利申请中,

苹果

就介绍了一种注意力检测方法。

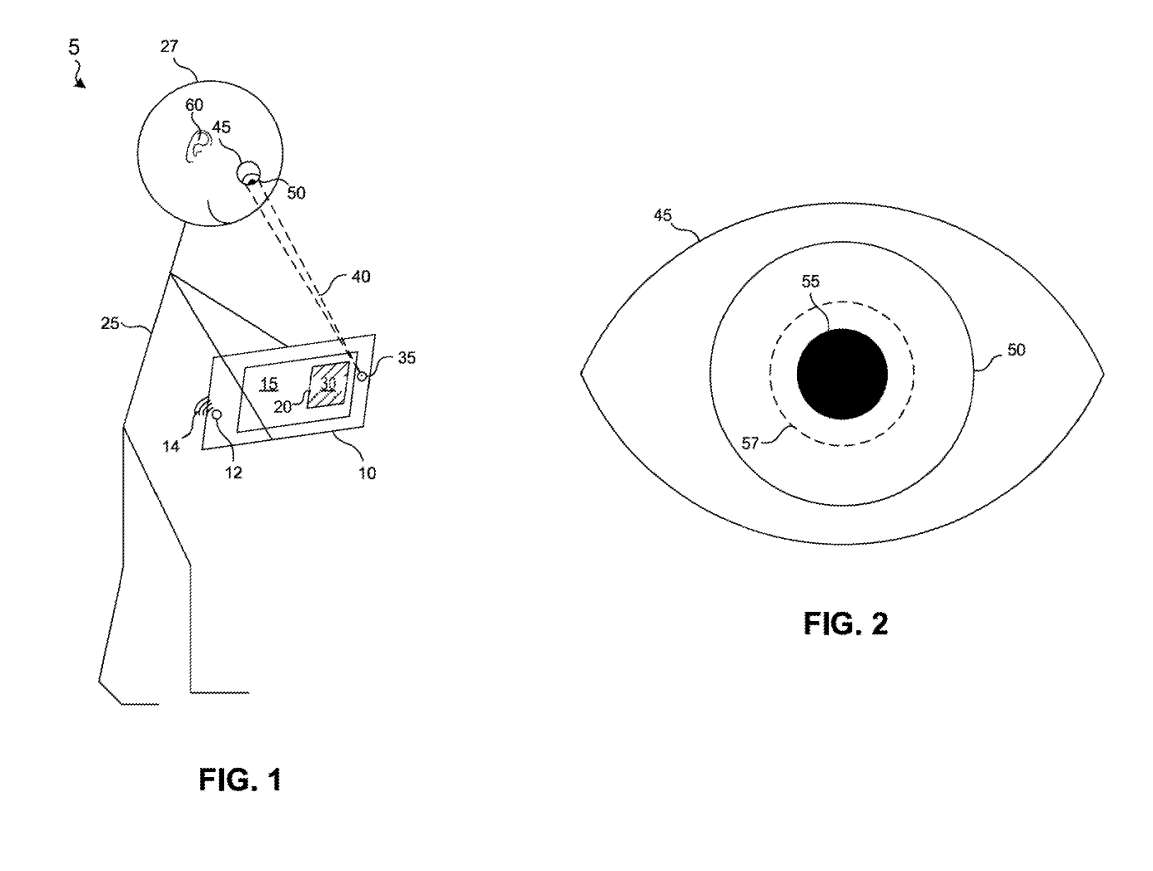

图1示出了包括具有显示器15的设备10的真实世界环境5。在一些实现中,设备10向用户25显示内容20以及与内容20相关联的视觉特征30。例如,内容20可以是按钮、用户界面图标、文本框、图形等。

内容20可以是视觉体验(例如教育体验),并且视觉体验的视觉特性30可以在视觉体验期间连续变化。同一电子设备或另一电子设备获得生理数据(例如瞳孔数据、EEG数据等)以评估用户的注意力状态。在这样的体验期间,相同或另一电子设备可以获得生理数据以评估用户的专注状态。

在一个实施例中,视觉特征30是用户的特定于体验的反馈机制。在教育体验期间,内容20可以是烹饪视频或图像序列,其可以包括视觉和/或音频提示作为呈现给用户以引起注意的视觉特征30。

设备10经由传感器35从用户25获得生理数据(例如EEG幅度/频率、瞳孔调制、眼睛注视扫视等)。例如,设备10获得瞳孔数据40,例如眼注视视特征数据。

如图1所示,设备10是手持式电子设备(例如智能手机或平板电脑)。在一个实施例中,设备10是头戴式显示器。

设备10包括用于检测眼睛位置和眼睛运动的

眼动追踪

系统。可以分析由眼动追踪系统捕获的图像,以检测用户25的眼睛的位置和运动,或者检测关于眼睛的其他信息,例如瞳孔扩张或瞳孔直径。

设备10采用各种生理传感器、检测或测量系统。检测到的生理数据可以包括但不限于EEG、心电图(E

CG

)、肌电图(EMG)、功能性近红外光谱信号(fNIRS)、血压、皮肤电导或瞳孔反应。另外,设备10可以同时检测多种形式的生理数据,以便从生理数据的同步采集中受益。

在一个实施例中,包括用户25的一个或两个瞳孔50的用户25的双眼45以瞳孔响应的形式呈现生理数据(例如瞳孔数据40)。用户25的瞳孔反应通过视神经和动眼神经导致瞳孔50的大小或直径的变化。例如,瞳孔反应可以包括收缩反应(瞳孔缩小)或者扩张反应(瞳孔散大)。在一个实施例中,设备10可以检测表示时变瞳孔直径的生理数据的模式。

在一个实施例中,瞳孔响应可以是对用户25的一只或两只耳朵60检测到的听觉反馈的响应。例如,设备10可以包括经由声波14投射声音的扬声器12。

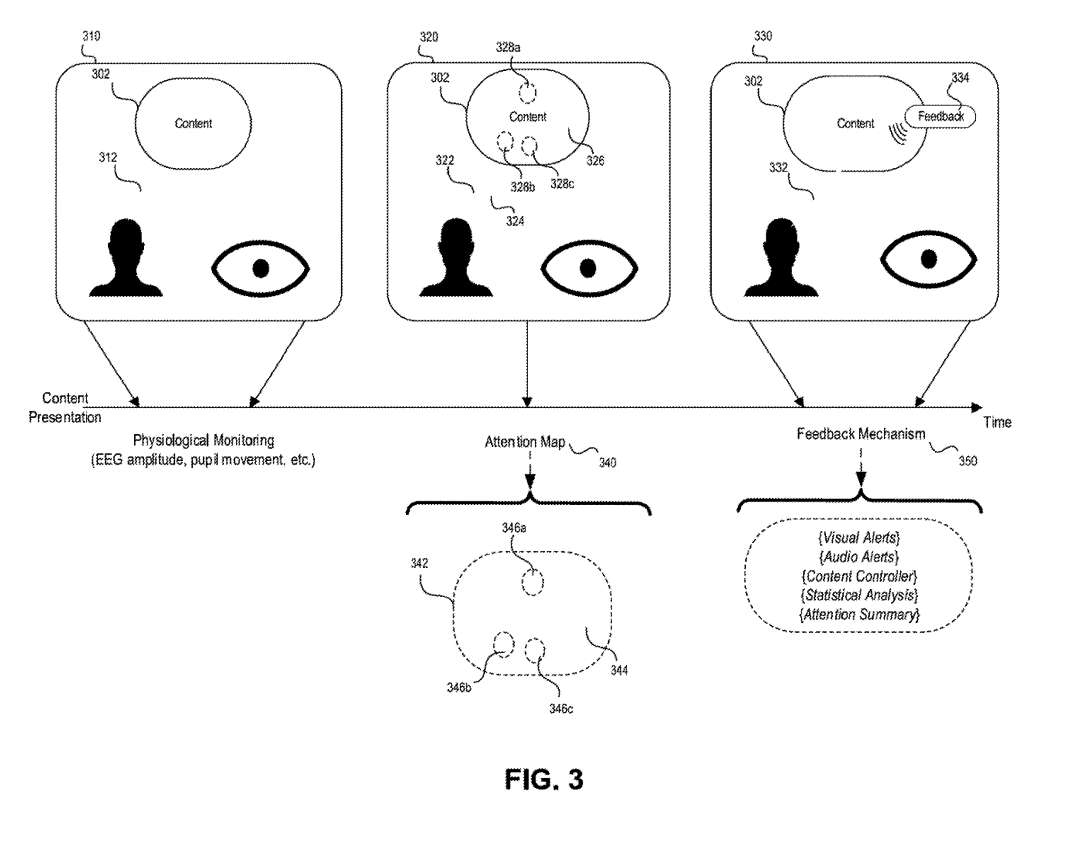

图2示出了图1的用户25的瞳孔50,其中瞳孔50的直径随时间变化。瞳孔直径跟踪可以潜在地指示用户的生理状态。如图2所示,当前生理状态(例如当前瞳孔直径55)可以与过去的生理状态(如过去瞳孔直径57)形成对比而变化。例如,当前生理状态可以包括当前瞳孔直径,而过去生理状态可以包含过去瞳孔直径。

生理数据可以随时间变化,并且设备10可以使用生理数据来测量用户对视觉特征30的生理响应或用户与内容20交互的意图中的一个或两个。例如,当由设备10向用户25呈现诸如内容体验列表之类的内容20时,用户25可以在不需要用户25完成物理按钮按压的情况下选择体验。

在一个实施例中,生理数据可以包括在用户25扫视内容20之后瞳孔50的半径的视觉或听觉刺激的生理响应。其中,生理响应是通过头显的眼动追踪技术测量。在一些实施方式中,生理数据包括经由EEG技术测量的EEG幅度/频率数据,或者从EMG传感器或运动传感器测量的EMG数据。

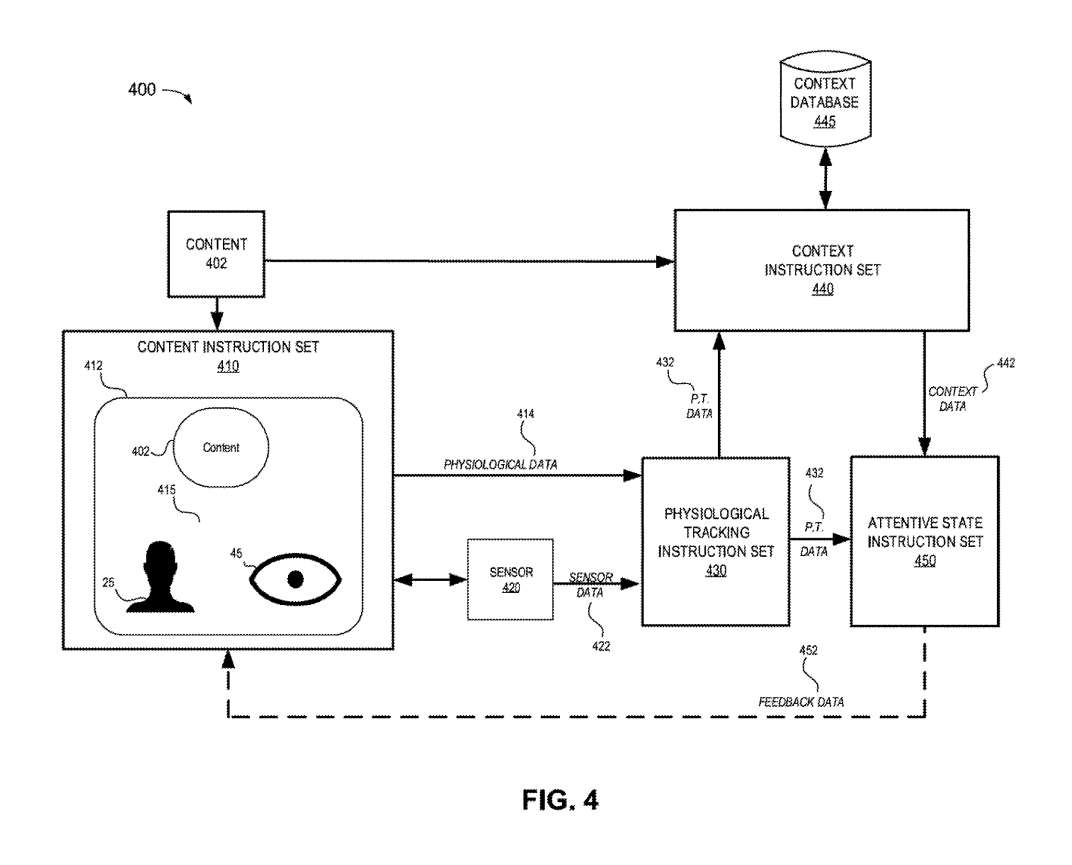

图3示出了基于生理数据并利用与生理数据和内容相关联的注意力图来评估观看内容的用户的注意力状态。特别地,图3示出了在内容呈现期间向用户呈现内容302,其中用户经由获得的生理数据对内容具有生理响应。

例如,在内容渲染时刻310,向用户25呈现包括视觉内容(例如烹饪视频)的内容302,并且监视用户的瞳孔数据312作为基线。然后,在内容渲染时刻320,用户的瞳孔数据322和324正由内容分析指令集监视内容302的相关区域和非相关区域之间的任何生理响应,例如EEG幅度/频率、瞳孔调制、眼睛注视扫视等。

注意力图340可以在内容呈现之前获得或者在内容呈现期间生成。注意力图340可用于跟踪用户在内容302的呈现期间所关注的内容的总体情景。例如,注意力图340包括与内容302的注视区域相关联的内容区域342。注意力图包括分别与内容区域328a、328b和328c相关联的相关区域346a、346b和346c。另外,注意力图340将剩余区域指定为不相关区域344。

注意力图可以用于确定用户何时在相关区域和非相关区域之间扫描内容302,以确定用户是否在关注。例如,用户可能不断地在相关区域346a、346b和346c之间转换,但随后需要在转换期间扫描非相关区域344。这种扫描或转换同时可以包括用户在扫描回相关对象346之前扫视内容302的另一部分以查看背景或背景中的不相关的人或对象的短暂时间量。

如果在阈值时间内进行转换(例如在不到1秒的时间内在相关区域和非相关区域之间转换),则注意力映射算法依然可以将这种“转换”视为处于专注状态。

另外,可以随着时间的推移跟踪相关区域和非相关区域之间的平均转变次数(例如每分钟的转变次数),从而确定专注状态。例如,与较慢的转换相比,更频繁和更快的转换可以确定为用户正在专心状态。

在用户的瞳孔数据322和324分析(之后的一段时间之后,内容呈现瞬间330呈现给具有反馈机制350的用户,因为注意力状态评估是用户没有注意力并且可能走神。反馈机制350可以是视觉和/或音频通知(例如反馈通知334),或者是内容控制器(例如通过用于暂停、倒带等的控制来控制内容的呈现)。

附加地,反馈机制350可以是提供给用户的离线或实时统计分析和注意力总结。例如,系统可以跟踪几天和几周的注意力状态,并开始建议一天中的最佳时间,或一周中进行某些学习活动的最佳日期。

如图3所示,用户的瞳孔数据332证明用户对反馈通知334具有生理响应。如果用户被评估为走神,则反馈机制或提示可以与内容的呈现一起呈现,以将用户重新聚焦于与内容相关联的任务。用户的注意力状态评估可以在内容302的整个呈现过程中连续地监控。

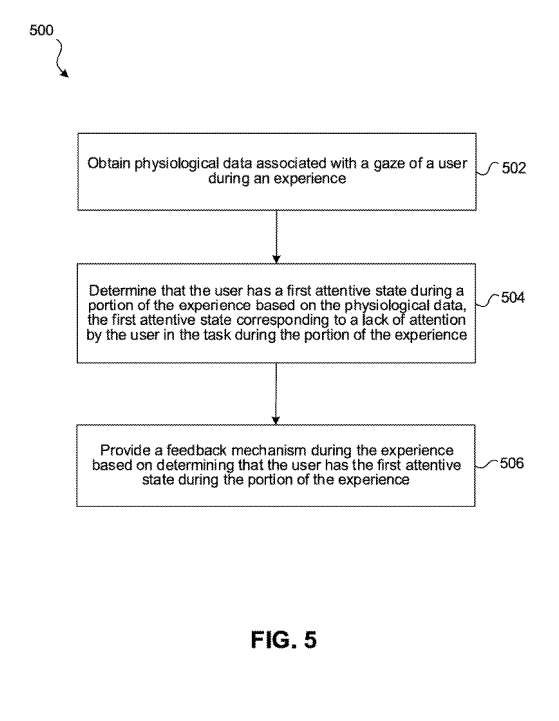

图4是示例环境400的系统流程图,在示例环境400中,注意力状态评估系统可以基于生理数据并利用与生理数据和内容相关联的注意力图来评估用户的注意力状态,并在内容的呈现内提供反馈机制。

示例环境400的系统流程获取内容并将其呈现给用户,分析内容的情景,在渲染内容期间获得与用户相关联的生理数据,基于利用情景的用户的生理数据来评估用户的注意力状态,并且如果用户改变注意力状态,则提供反馈机制。

例如,注意力状态评估技术基于所获得的生理数据,通过提供基于用户的注意力状态的反馈机制来确定用户在体验期间的注意力状态。

示例环境400包括内容指令集410,内容指令集配置有可由处理器执行的指令,以提供和/或跟踪用于在设备显示的内容402。例如,内容指令集410向用户25提供包括内容402的内容呈现瞬间412。内容402可以包括背景图像和声音数据。内容呈现时刻412可以是XR体验。

或者,用户可以佩戴头显并通过实时摄像头视图观看真实的物理环境,或者头显允许用户透过显示器查看内容。在体验期间,当用户25正在查看内容402时,用户眼睛的瞳孔数据415可以被监测并作为生理数据414发送。

图5是示例性方法500的流程图。

在502,获得与用户在体验期间的注视相关联的生理数据,例如,EEG幅度/频率、瞳孔调制、眼睛扫视等。

在504,生理数据确定用户在体验的一部分期间具有第一专注状态(例如从任务中走神),第一专注状态对应于用户在该部分体验期间在任务中缺乏注意力。

在506,基于确定用户在体验的该部分期间具有第一专注状态,在体验期间提供反馈机制。所确定的专注状态可以用于经由反馈机制向用户提供反馈,以重定向用户、向用户提供统计信息和/或帮助内容创建者改进体验的内容。

在一个实施例中,基于生理数据确定用户在体验的一部分期间具有第二专注状态(例如专注于任务)。可以获得或生成诸如场景理解之类的情景分析,以确定用户应该关注什么内容。

在一个实施例中,方法500可以包括基于传感器数据来确定体验的情景,并基于情景来确定第一注意状态。

对于烹饪教学视频,注意力图可以用于识别烹饪教学视频中相关的部分,例如教员的脸、教员的手和/或正在准备/烹饪的烹饪用具和食物。因此,非相关区域包括未被识别为与教学视频相关的所有其他区域。注意力图340然后可以被系统用来跟踪用户的转变数据。用户转换到相关区域的速度越快,他或她就越有可能关注教学视频。

在一个实施例中,方法500包括基于第一注意力状态来调整与体验相对应的内容。例如,可以基于确定所呈现的体验期间的注意力状态以及其中呈现的体验或内容的变化来提供针对内容开发者的内容推荐。例如,当提供特定类型的内容时,用户可以很好地集中注意力。

在一个实施例中,方法500可以包括基于内容与体验的相似性来识别内容,以及基于确定用户在体验期间具有第一专注状态来向用户提供内容的推荐。

在一个实施例中,可以基于不同于针对体验的预期关注状态的关注状态来对应于体验来调整针对体验的内容。

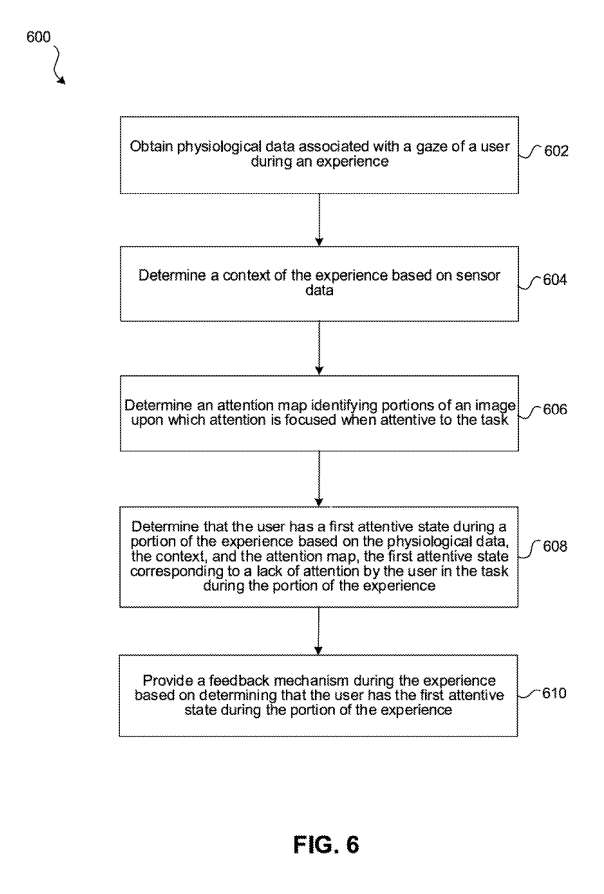

图6示出的方法600用于基于生理数据并利用与生理数据和内容相关联的注意力图来评估观看内容的用户的注意力状态,同时在内容的呈现内提供反馈机制。

在602,方获得与用户在体验期间的凝视相关联的生理数据。

在604,基于传感器数据来确定体验的情景。

在606,确定注意力图,注意力图识别图像的当关注任务时注意力集中在其上的部分。例如,图3的注意力图340识别内容302的相关部分(相关区域346a-c),以及内容302的哪些部分是不相关的(不相关区域344)。对于烹饪教学视频,注意力图可以用于识别烹饪教学视频中相关的部分,例如教员的脸、教员的手和/或正在准备/烹饪的烹饪用具和食物。

因此,非相关区域包括未被识别为与教学视频相关的所有其他区域。注意力图340然后可以被系统用来跟踪用户的转变数据。用户转换到相关区域的速度越快,他或她就越有可能关注教学视频。

在608,基于生理数据确定用户在体验的一部分期间具有第一专注状态(例如从任务中走神)。

在610,基于确定用户在体验的该部分期间具有第一专注状态,在体验期间提供反馈机制。

在一个实施例中,应用机器学习模型来识别生理数据中的模式,包括识别在特定体验(例如教育、冥想、教学等)期间对内容的呈现的生理响应。另外,机器学习模型可以用于将模式与对应于用户25与体验交互的兴趣或意图的指示的学习模式相匹配。

相关专利

:

Apple Patent | Attention detection

名为“Attention detection”的苹果专利申请最初在2023年9月提交,并在日前由美国专利商标局公布。