(

映维网Nweon

2024年09月19日

)对于AR/VR,你可以在设备视场之内显示数字内容。这意味着远超于传统2D设备的屏幕空间。然而,这同时意味着用户可能专注于在显示空间的一个部分,并错过在显示空间另一个部分发生的动作或重要事件。

为了帮助用户获得满意的内容浏览体验,有必要确定用户在交互时可能经历的眼睛疲劳,并提供适当的调整。

在日前由美国专利商标局公布的一份专利申请中,

索尼

就介绍了一种利用

眼动追踪

来提升游戏体验的方法。

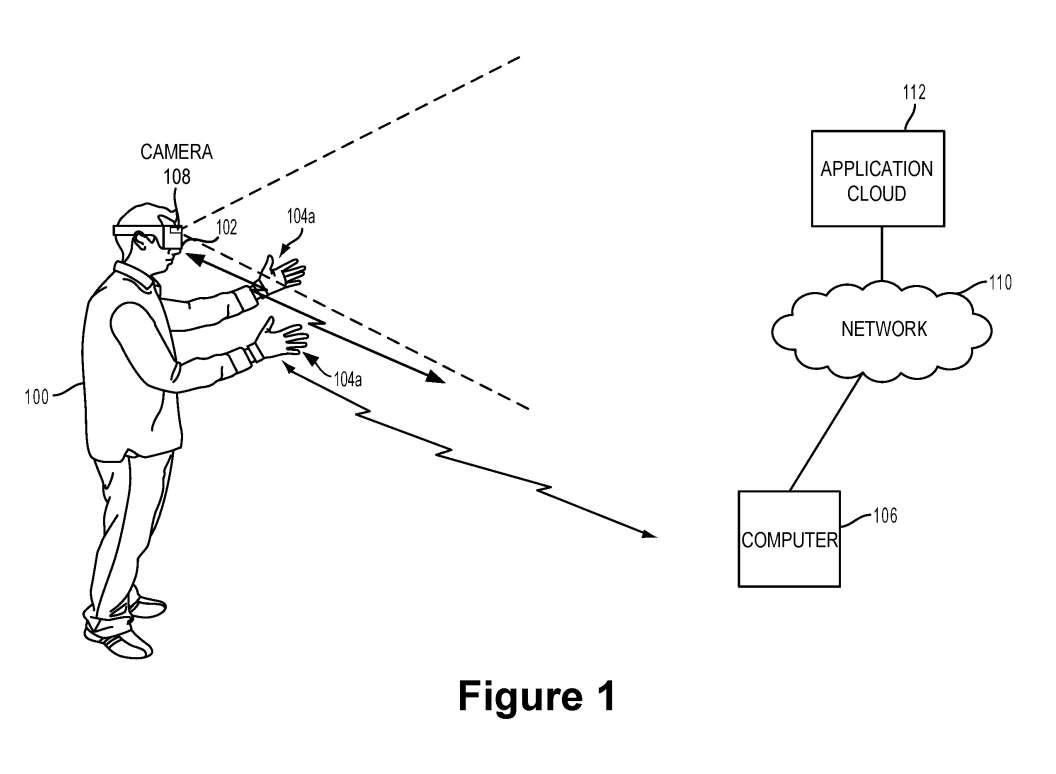

图1示出可穿戴设备可用于在用户查看或与内容交互时捕获用户的眼睛姿态,并使用眼睛姿态的属性向用户提供帮助。图1所示的系统可用于与游戏应用的游戏内容进行交互。

头显102包括多个用于捕获用户面部特征变化的传感器。感器捕捉到的面部特征变化可以用来识别头部姿态、面部姿态、眼睛姿态,如眼睛形状、眼睛位置、眼睛注视等。

除了用户面部特征的变化外,传感器同时捕获与每次变化相关的时间数据。利用面部特征和传感器捕获的时间数据,可以确定额外的眼睛姿态,例如用户的眯眼,眯眼的程度等。用户眯着眼睛、眯着眼睛的程度、眯着眼睛的时间都表明,用户在解读屏幕呈现的内容时遇到了困难。

于相关变化中识别出的属性用于定义其他属性,例如眯眼,用户的表情,用户的生理状态等,并从中可以推断出用户粘性指标。然后,通过分析各种传感器捕获的数据获得的属性和附加属性可由头显102的处理器转发给计算机106,而计算机106可以使用所述属性和附加属性触发用于调整所述内容的选择部分的自动调谐功能。

可以将属性和附加属性与预测将在内容中发生的事件的细节一起使用,从而提供视觉线索,并将用户引导到将发生预测事件的内容的显示区域。例如,用户可能一直专注于右下角的游戏,但这时左上角可能会出现偷偷接近的敌人。这时,可以通过相关的视觉线索来将用户注意力引导至左上角区域。

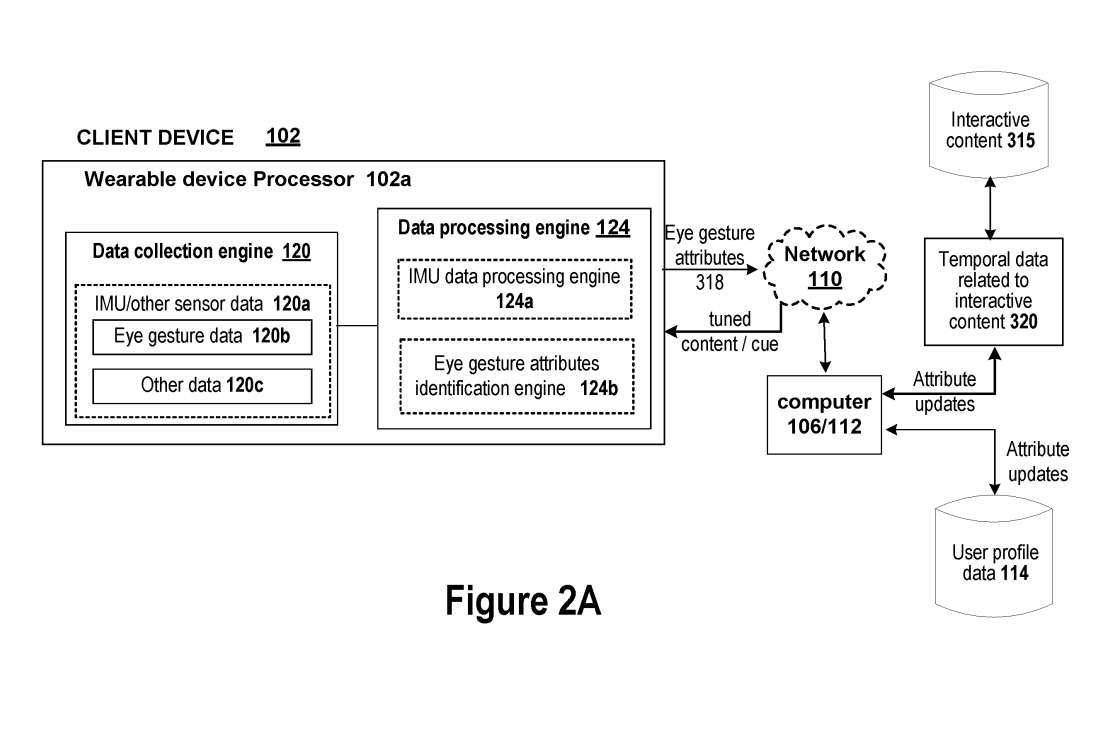

图2A示出了客户端设备的组件,客户端组件用于收集与眼睛姿态相关的数据,并在将眼睛姿态属性转发到计算机进行进一步处理之前处理所收集的数据以识别与眼睛姿态相关的各种属性。

作为示例,客户端设备是可穿戴设备,如上述参考图1所述的头显102。

设置在头显102的各种传感器捕获传感器数据,并执行初步处理以识别所收集的数据类型。例如,数据采集引擎120收集的数据可以包括从各种IMU传感器和其他传感器,如图像捕获设备收集的惯性测量单元传感器数据120a。

如上所述,传感器捕获的IMU传感器数据120a包括眼睛姿态数据120b,其中包括面部姿态、头部姿态和眼睛姿态,以及其他数据120c。

从各种传感器收集的数据作为输入由数据收集引擎120提供给数据处理引擎124。数据处理引擎124分析所述数据以识别所收集数据的各种属性。

在一个实施例中,数据处理引擎124使用IMU数据处理引擎124a来分析从IMU传感器收集的数据。分析是为了识别特定的面部特征,从特征中收集每个姿态数据,以及传感器捕获的姿态数据的属性。

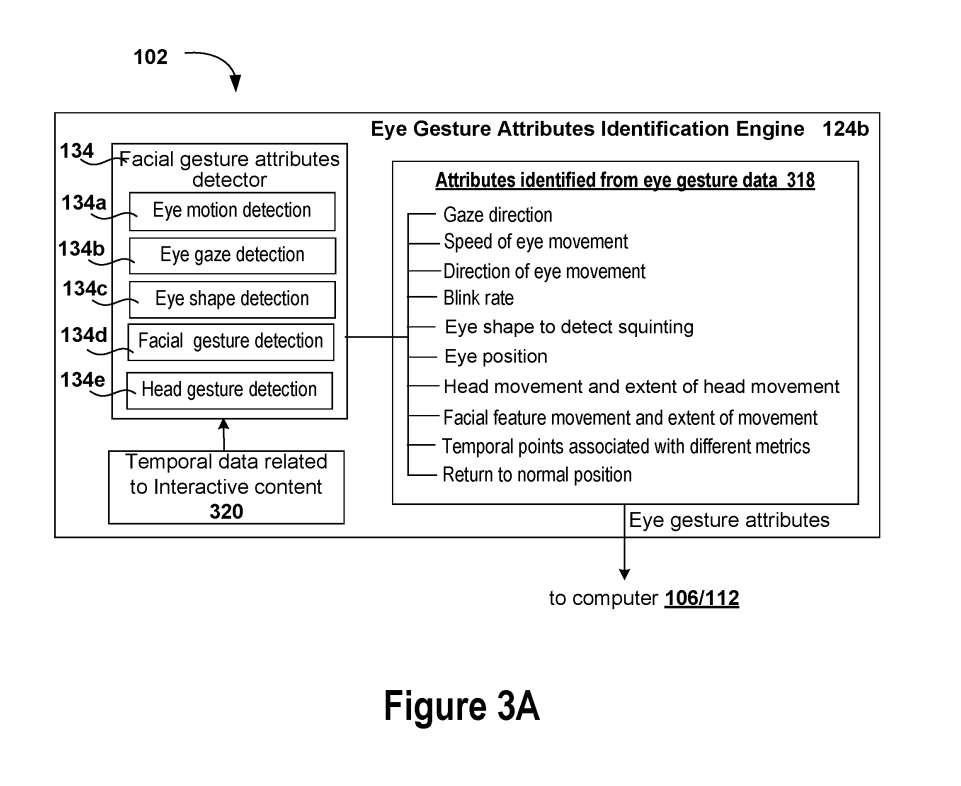

图3A示出了客户端设备的眼睛姿态属性识别引擎124b,其用于分析由不同传感器收集的姿态数据并识别所收集的姿态数据的不同属性。然后由客户端设备直接或通过网络110转发到计算机106以进行进一步处理。

眼睛姿态属性识别引擎124b中的面部姿态属性检测器134用于分析由不同传感器捕获的数据,并识别负责提供由传感器捕获的姿态数据和姿态数据的不同属性的每个面部特征。面部姿态属性检测器134用于使用眼动检测引擎134a检测眼球运动,使用眼动注视检测引擎134b检测眼球注视,使用眼形检测引擎134c检测眼球形状,使用面部姿态检测引擎134d检测面部姿态,以及使用头部姿态检测引擎134e检测头部姿态。

眼睛的形状可以用来判断用户是在眯眼睛,或者是在表达沮丧、愤怒或失望,这表明用户很难看到内容。

计算机106可以根据眼睛姿态属性来确定用户所经历的眼疲劳或眼疲劳的类型和程度。然后,眼睛姿态处理模块可以自动调整在与所述头显102相关联的屏幕呈现的内容。

在一个实施例中,自动调优包括放大或缩小内容的文本部分或放大/缩小图像内容。另外,基于用户正在查看的地方和用户应该查看的地方,眼睛姿态处理模块可以提供额外的内容或提示或线索或其他可访问性功能,以将用户的注意力引导到用户应该查看的地方。

将眼睛姿态的属性更新到存储在用户配置文件数据库114中的用户配置文件。使用与所述交互式内容相关的时间数据,可以将所述眼睛姿态的属性更新为存储在交互式内容数据库315中的交互式内容的适当部分。

随着内容的变化,为收集到的用户眼睛姿态识别的属性会根据在内容中检测到的变化而变化。因此,在查看内容的特定部分时,由于在所述部分中呈现的内容数量或内容呈现的速度,用户可能会感到眼睛疲劳,而在查看内容的其他部分时,用户可能不会感到任何眼睛疲劳。

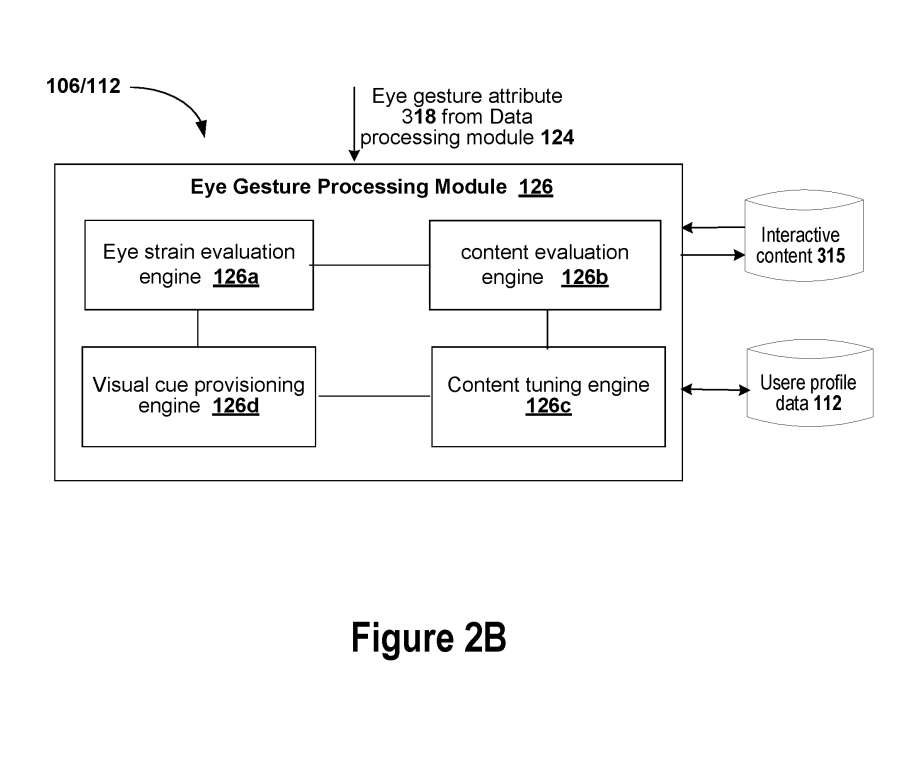

图2B示出用于处理由数据处理引擎124识别的眼睛姿态属性的服务器端组件,以便在与内容交互期间向用户提供帮助。

计算机可以位于本地或远端的客户端设备。根据所述服务器计算机的位置,直接或通过网络110将所述眼睛姿态属性转发给所述服务器计算机以进行进一步处理。服务器包括服务器端眼睛姿态处理模块126,用于评估眼睛姿态属性并识别需要向用户提供的辅助类型,以及生成适当的信号以在查看内容期间调整内容或向用户提供所需的辅助。

为了评估所述属性并提供所需的辅助,眼睛姿态处理模块126包括眼疲劳评估引擎126a、内容评估引擎126b、内容调整引擎126c和视觉线索提供引擎126d。

眼睛疲劳评估引擎126a用于检查和评估从客户端设备106/或云112的一部分接收到的眼睛姿态的属性,并确定当用户与客户端设备呈现的内容交互时,用户所经历的任何眼睛疲劳/疲劳和眼睛疲劳/疲劳的程度。

客户端设备102的各种传感器在用户与所述内容交互时监视用户的面部特征,以捕获所述面部特征中的变化并记录所述变化。例如,通过追踪眼睑、睫毛、鼻子、嘴巴、脸颊、下巴、眉毛、前额等的运动和运动程度,以及头部运动等,可以捕捉到面部特征的变化。

与变化有关的数据作为面部特征属性转发到服务器端眼睛姿态处理模块126。眼睛姿态处理模块126评估面部特征属性,以识别用户所经历的眼睛疲劳/眼睛疲劳的细微迹象。

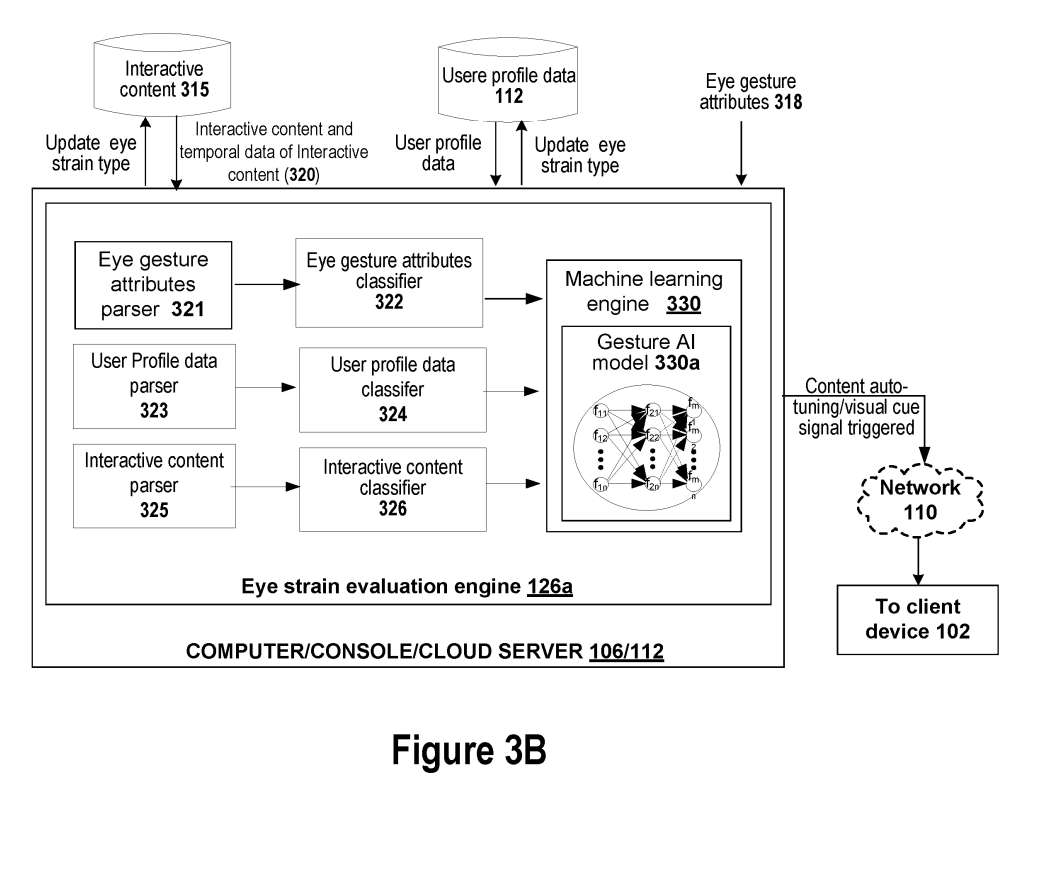

图3B示出由眼疲劳评估引擎126a所使用的机器学习引擎330,以确定用户是否正在经历任何眼疲劳/疲劳,以及系统是否需要执行自动调整。

眼睛姿态评估引擎126a包括解析器和分类器,用于解析和分类要考虑的各种数据,以确定用户在与交互式内容交互期间是否需要帮助。数据分类器识别的分类器信息随数据一起转发给机器学习引擎330,以构建和训练姿态人工智能模型330a。

经过训练的姿态人工智能模型330a的输出用于确定用户是否正在经历眼睛疲劳,如果是,则确定用户在与内容交互时所经历的眼睛疲劳类型和眼睛疲劳程度。经过训练的姿态人工智能模型330a的输出由眼睛姿态评估引擎126a使用,以确定是否需要提供帮助以及向用户提供帮助的类型。

使用眼睛姿态属性解析器321对从客户端设备102接收到的眼睛姿态属性318进行解析,以识别不同类型的属性,并使用眼睛姿态属性分类器322对不同类型的属性进行分类。所述分类用元数据对属性进行标记,以便通过在用户与内容交互过程中监视用户的眼睛姿态来识别不同类型的属性,并识别用户所经历的眼睛疲劳类型。

类似地,使用用户档案数据解析器323解析从用户档案数据114检索到的用户的用户档案数据,以识别档案数据的类型并根据类型对档案数据进行分类。用户资料数据可以用来识别正常的眼睛属性,如正常的眼睛形状、正常的眼睛位置、正常的眨眼频率等。

正常的眼睛属性可用于与在与内容交互期间捕获的眼睛姿态属性进行比较,以确定在用户与内容交互期间捕获的用户的眼睛姿态是否显示眼睛疲劳或眼睛疲劳。类似地,将用户的眼睛姿态属性与其他用户在与内容的相应部分交互时的相应眼睛姿态属性进行比较。分类后的用户档案数据也提供给机器学习引擎330作为输入。

使用眼疲劳评估引擎126a的交互内容解析器325解析在客户端设备上呈现的交互内容以及与交互内容相关的时间数据,以识别在不同时间在客户端设备上呈现的交互内容类型,并根据内容类型对交互内容进行分类。

所述交互式内容的分类器数据作为输入提供给所述机器学习引擎330。在不同时间呈现的内容类型会影响用户的眼睛姿态。

例如,游戏本身可能是高强度游戏。所以,用户可能不得不竭尽全力去吸收其中包含的所有细节,以确保他们能够及时提供适当的输入以推动游戏进程。由于内容变化很快或包含大量游戏数据,用户可能不得不睁大眼睛来保持内容或数据量的变化,以便他们能够提供适当的输入。

考虑在不同时间呈现的交互式内容,以便内容类型可以与用户与内容交互期间捕获的不同眼睛姿态相关联。

机器学习引擎330使用来自眼部姿态属性分类器322、用户档案数据分类器324和交互内容分类器326的分类器数据来创建和训练姿态人工智能模型330a。姿态人工智能模型330a使用分类器数据生成一个输出。

通过眼疲劳评估引擎126a对A人工智能型的输出进行评估,以确定用户的眼疲劳类型和眼疲劳程度。基于眼疲劳的类型和水平,眼疲劳评估引擎126a产生用于自动调整内容的信号。

在一个实施例中,自动调优包括通过放大或缩小部分中呈现的内容的大小,在用户眼睛注视的方向上动态调整内容的部分。。

参照图2B,将姿态人工智能模型330a获得的用户所经历的眼疲劳类型提供给内容评估引擎126b。内容评估引擎126b评估与用户所经历的眼睛疲劳类型相对应的当前呈现的内容和内容类型,并识别需要对内容部分进行的调整类型,以减少用户的眼睛疲劳或眼睛疲劳。

需要提供给特定部分的特定部分和自动调优类型由内容评估引擎126b标识并转发给内容调优引擎126c。内容调优引擎126c使用内容评估引擎126b提供的细节为交互式应用程序生成适当的信号,以动态调优部分内容。

动态调优可以放大内容部分中包含的图像或文本内容。或者,动态调优可以增强图像或文本内容的分辨率,或者突出显示图像或文本内容。然后将放大的图像或文本内容作为叠加层提供,以便在内容的部分上呈现。

例如,当向用户提供内容的交互应用为游戏时,游戏应用可以确定用户所关注的内容部分、用户应关注的内容部分,并产生信号激活视频游戏内的游戏角色,引导用户前往游戏场景的不同位置。或者,应用程序可以启动一个信号来突出显示或增强用户关注的部分内容的分辨率,以使用户能够清楚地查看内容。

在一个实施例中,如果眼睛姿态处理模块检测到用户的眼疲劳,基于所收集的属性,眼睛姿态处理模块使用从用户的眼睛姿态识别的属性,将所观察到的用户属性与该用户的先前属性或先前查看相同内容的其他用户的属性进行比较,并根据所观察到的用户的属性和视觉特征对所述内容进行自动调整,使得所述调整后的内容可以被所述用户轻松地查看和识别。

然后,将自动调优的内容转发到客户机设备进行呈现。或者,可以向用户提供视觉线索,以将用户的注意力引导到预计将在屏幕的不同区域发生的事件或动作,而不是引导用户焦点的区域。

在意额给实施例中,可视提示可以以注视点呈现的形式提供,其中需要引起用户注意的部分内容通过增强分辨率而度角,而内容的其余部分以低于对焦部分的分辨率呈现。

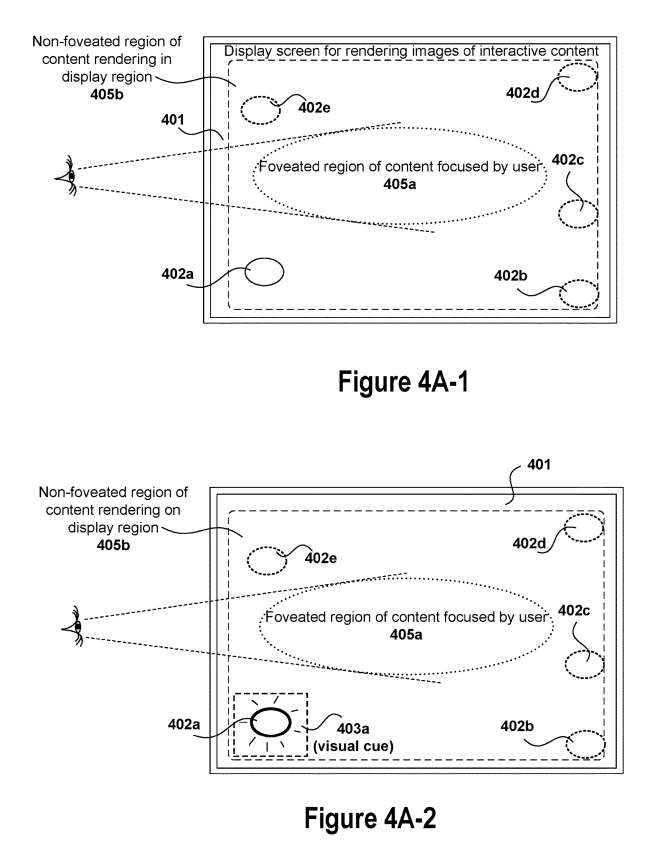

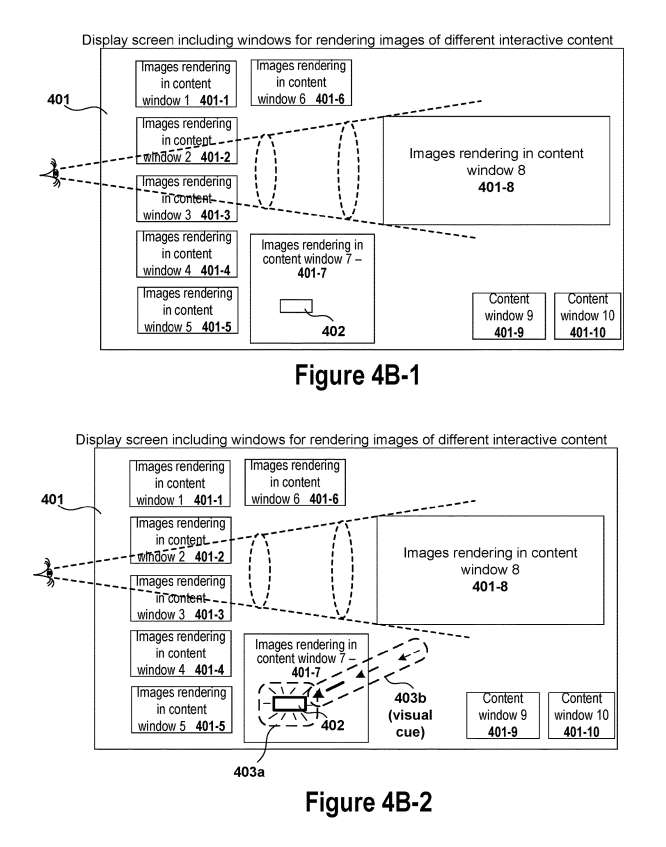

图4A-1和4A-2举例说明了可穿戴设备的显示区域。在显示屏幕呈现的内容包括在注视点区域405a中呈现的第一部分,以及在非注视点区域405b中呈现的第二部分。

视觉线索提供引擎126d可以产生该信号以在区域402a所包括的部分内容处提供视觉提示,以建议用户将其焦点从注视区域405a移动到预计动作将发生的区域402a。图4A-2示出了在区域402a中提供的一个这样的视觉线索403a,其中所述视觉线索可以是高亮或光点的形式。

将用户的注意力吸引到预计会发生的事件/动作上,将有助于用户为事件/动作做好准备,并且在事件/动作实际发生时不会感到惊讶。例如,在显示屏幕以提供来自单个应用程序的内容的情况下,用户可以将焦点集中在用户正在搜索敌人的第一部分,而敌人可能在第二部分,并且可能计划从用户身后攻击用户。

将用户的注意力吸引到第二部分,允许用户专注于第二部分,并在第二部分内和周围搜索敌人,以便用户可以准备和准备攻击敌人,而不会说遭到敌人突然袭击。在游戏过程中提供的这种帮助可以让用户为不同的场景做好准备。

收集与用户眼睛姿态相关的数据可以实现多层次追踪,以捕获面部特征的多个方面,而眼睛注视是其中一个组成部分。

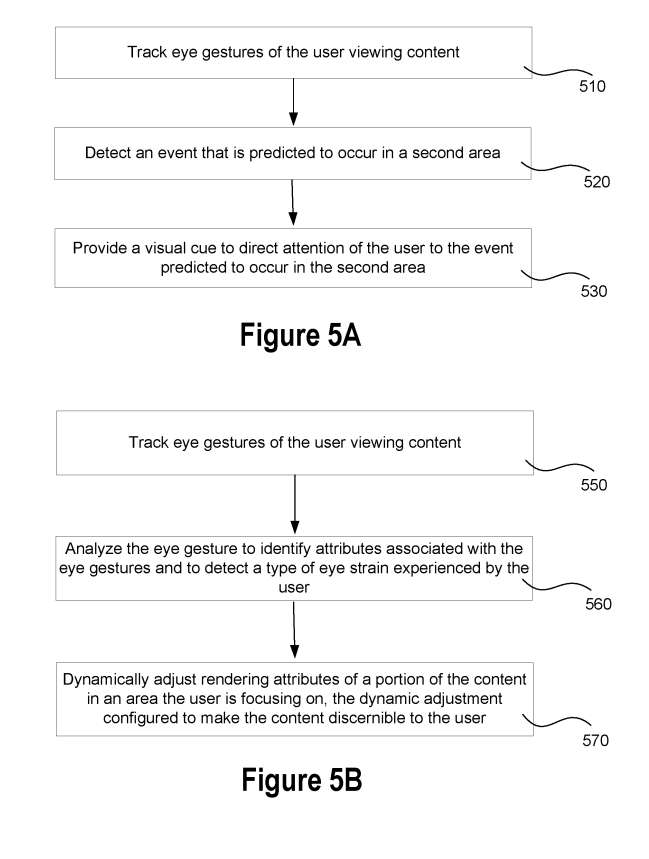

图5A示出了在内容交互期间用于向用户提供帮助的方法的操作流。

从510开始,当用户正在查看在客户端设备上呈现的交互式应用程序的内容时,追踪用户的眼睛姿态。眼睛的姿态提供了多层次的追踪,并可以用来识别用户在观看内容时眼睛疲劳或疲劳的细微迹象。

当用户在第一区域(中查看内容时,系统检测到预计将在第二区域中发生的事件,如操作520中所示。根据用户的输入、在客户端设备上呈现的内容的当前状态,以及包括在客户端设备呈现的内容类型在内的内容,预测该事件的发生。

为响应于检测预计在第二区域中发生的事件,向用户提供视觉提示以将用户的注意力吸引到第二区域,如操作530所示。眼睛姿态处理模块将用户的注意力引导到第二区域,从而允许用户为预测事件的发生做好准备。

图5B示出了另一个用于向用户提供帮助的方法的操作流。

从操作550开始,当用户从事与交互式应用程序的内容交互时,追踪用户的眼睛姿态。由此推断出其他属性,如眼睛疲劳。分析眼睛姿态以识别相关属性并使用所述属性来确定用户是否正在经历眼睛疲劳以及眼睛疲劳的类型和水平,如操作560中所示。

可以使用眼睛姿态的属性来确定用户是否在眯眼,如果是,则可以使用眯眼的长度和用户正在查看的内容类型来确定用户很难解读显示屏呈现的内容。例如,当内容是高密度内容或正在高速渲染时,则用户将不得不花费更多心神以吸收其中包含的所有细节并提供适当的输入。

在用户长时间盯着内容的特定部分的情况下,眼睛姿态处理模块可以使用时间和其他眼睛姿态属性以及正在呈现的内容类型来确定用户是否正在眯眼和/或用户是否正在经历眼睛疲劳。

如果用户正在经历眼睛疲劳或眼睛疲劳,则确定用户所经历的眼睛疲劳的类型和水平。根据用户所经历的眼睛疲劳的类型和水平,眼睛姿态处理模块产生适当的信号以动态地调整引起用户注意的部分内容的呈现属性,如操作570中所示。

确定对内容的动态调整量,以确保该调整以用户可识别的方式呈现内容。对内容的调整可以是增强该部分内容的分辨率,或者放大该部分中的内容呈现,对该部分内容采用注视点呈现等形式。

相关专利

:

Sony Patent | Leveraging eye gestures to enhance game experience

名为“Leveraging eye gestures to enhance game experience”的索尼专利申请最初在2023年3月提交,并在日前由美国专利商标局公布。