(

映维网Nweon

2024年08月27日

)AR/VR头显越来越多地使用

眼动追踪

系统来追踪用户眼睛的位置和/或运动。对于眼动追踪系统的组件而言,平衡系统标准可能非常重要,例如功耗、尺寸、重量、可靠性、易于制造和成本。在大多数头显中,眼动追踪系统与显示系统是分开的。这两个系统可能涉及单独的组件和处理器,并且可能有两个能量预算。眼动追踪图像的处理在计算方面可能是昂贵和缓慢的。

在名为“Multi-pupil display and eye-tracking with interferometric sensing”的专利申请中,Meta提出了一种采用干涉传感的眼动追踪方法。

在一个实施例中,可以使用扫描仪将虚拟图像呈现给视窗区域并对相同的视窗区域进行成像,以用于眼动追踪目的。光瞳复制显示波导可以有多个光瞳。可见光可以通过扫描器耦合到波导中以呈现虚拟图像。红外光可以通过扫描仪耦合到波导中并用于眼动追踪。波导可以向视窗区域呈现虚拟图像,并将红外耦出以照亮视窗区域。

当所述显示波导配置为多瞳定位波导时,可使用用于显示和眼动追踪的相同波导。这样可以扩大有效的视窗。所述系统的眼动追踪系统可包括一个独立的干涉传感系统,其中参考光路长度对应于所述波导的特定光瞳位置。

干涉检测系统的灵敏度可能致使它仅在用户的瞳孔注视特定光瞳位置时才产生成像信号。这种现象可以通过避免从多个光瞳位置分析眼球追踪图像来降低处理成本。相反,每个干涉检测系统的信号可以提示眼动追踪系统分析相应光瞳位置的眼动追踪图像。

在一个实施例中,眼动追踪系统可以包括配置为发射红外线光的光源。波导可以包括耦入器。扫描仪可以配置为将红外线(光引导到耦入器,耦入器可以配置为将红外线(光引导出波导,朝向视窗区域进行眼动追踪。

所述扫描仪可配置为将可见光引导到所述耦入器。耦入器可以配置成将可见光指向视窗区域以作为虚拟图像显示。传感器可以配置为当红外线光通过扫描仪和耦入器照射到传感器上时产生成像信号。

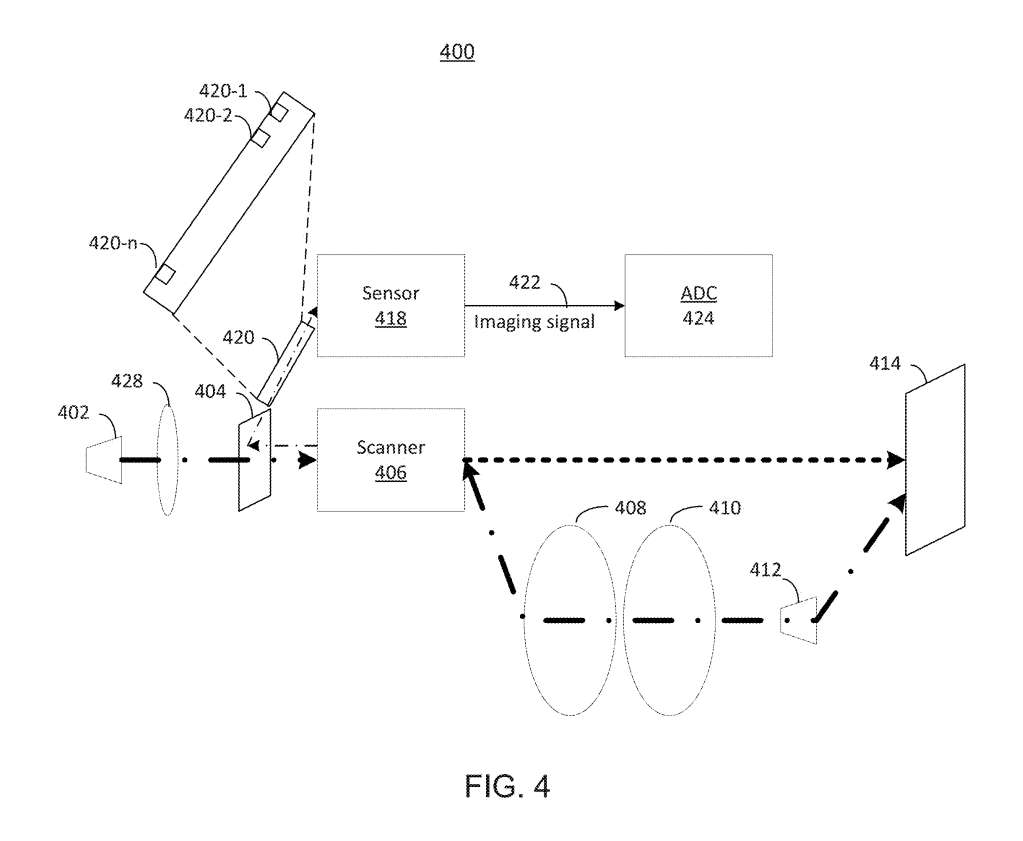

图4示出了眼动追踪系统400的框图。眼动追踪系统400可具有可包括光源402的照明路径。光源402可以配置成发射各种类型的光信号,例如可见光或红外光。

在一个实施例中,眼动追踪系统400可包括分束器404、扫描仪406、可选光学元件408和/或410和/或耦入器412。从眼动追踪系统400发出的光信号可以穿越或通过所述组件的任意数量或任意次数。

在一个实施例中,发射的光信号可以按照照明或检测路径通过分束器404、扫描仪406、可选光学元件408和/或410和/或耦入器412,并最终用红外光照射视窗区域414。红外光可用于眼动追踪目的。

眼动追踪系统400同时可以具有传感路径,其中返回的光作为照亮视窗区域414的红外光以反光学路径传播到分束器404。所以,眼动追踪系统400可以认为是一种双通系统。返回的光可以是从占用视窗区域414的用户的眼睛反射或散射的照明红外光。

皮肤、睫毛和/或眉毛同样可以反射和/或散射照亮视窗区域414的照明光。返回光可以传播到耦入器412并通过可选光学元件408和410(如果存在)。

返回光可以从扫描仪406和从分束器404反射作为返回光416到传感器418。波导420可以光耦合以将从分束器404返回的光引导到传感器418。

在一个实施例中,当返回光入射到传感器418时,传感器418产生成像信号422。所述成像信号422可作为模拟信号实现。模数转换器ADC 424可将模拟信号转换为数字成像信号426。

模数转换器424可将所述数字成像信号提供给处理逻辑,所述处理逻辑可配置为至少部分地基于成像信号生成眼动追踪图像。

当扫描仪406用红外线扫描并照亮视窗区域414的不同成像点时,可为每个成像点生成数字成像信号426,并可将其存储到存储器中。相应地,视窗区域414内的每个成像点可与相应的数字成像信号426相关联,以便聚合成像信号并协助生成视窗区域414的眼动追踪图像。

在一个实施例中,光源402配置为发射红外光。透镜428可用于控制扫描仪406或视窗区域414处的红外光束的形状。例如,透镜428可以设计成使得由光源402发射的光线准直或聚焦。所述透镜428可提供对焦转动机制,以控制光线沿光路聚焦的位置。

在一个实施例中,分束器404可以实现为极化分束器PBS。扫描仪406可以实现为具有可沿两个旋转轴移动或调整的反射表面的微机电系统扫描仪。传感器418可以实现为光敏传感器。

在一个实施例中,波导420可包括耦入器412。耦入器412可以实现为衍射光学元件,其配置为在通过其他波长的光时对光源402发射的特定波长或波长的光进行操作。

耦入器412可以实现为全息光学元件,配置成对光源402发射的特定波长或波长的光进行操作。

耦入器412可以是反射的或折射的。耦入器412可以配置为衍射红外或近红外光。耦入器412可以配置为引导可见光朝向视窗区域414。

在一个实施例中,波导420可实现为包括多个光瞳420- 1,420 -2,…的多瞳显示波导。420 – n。学生420- 1,420 -2,…, 420-n可分别对应于视窗区域414的一部分。传感器418可包括多个探测器,每个探测器对应于各自的光瞳。

在一个实施例中,当用户的眼睛看到与检测器对应的光瞳相关联的位置时,每个检测器都会产生检测信号。检测信号可能致使传感器分析与所述位置相关的眼动追踪图像。

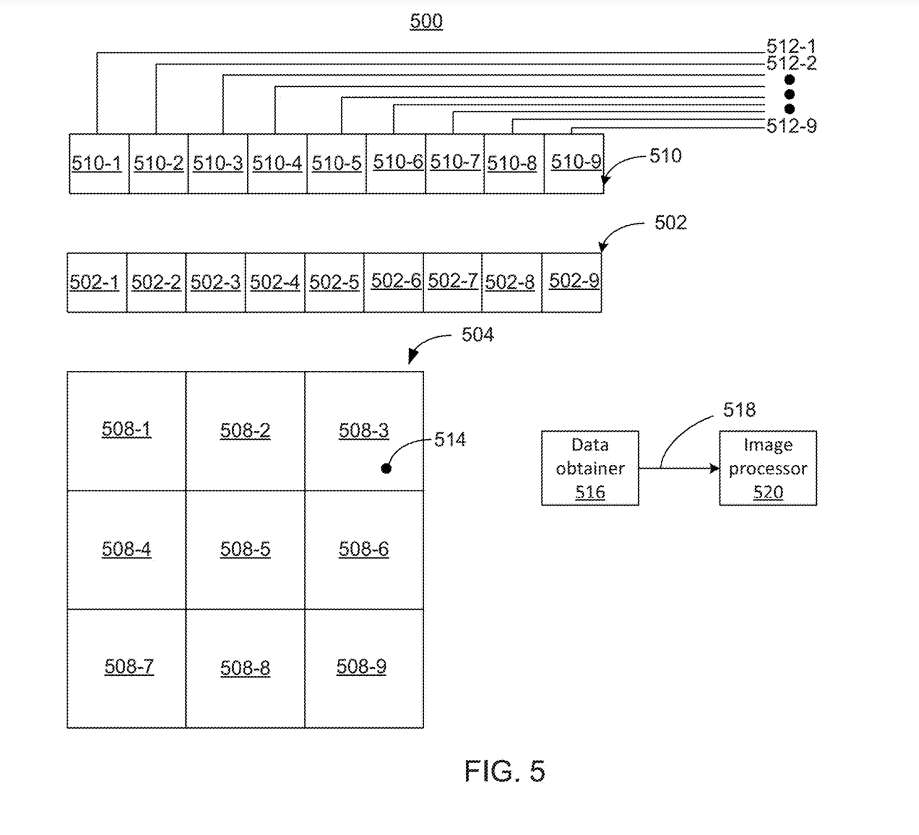

图5示出示例光瞳排列500的示意图。波导502包括包括多个光瞳的多瞳显示波导。光瞳可以对应于视窗区域504的各个部分。

在一个实施例中,传感器510配置为以每光瞳为基础检测用户眼睛所看的位置。例如,可以将传感器510配置为确定用户的眼睛是否正在注视部分508-1或508-9。当红外光照射到传感器510上时,由于用户的眼睛注视着视窗区域504内的位置,传感器510可以产生成像信号。

在一个实施例中,传感器510可以基于干涉检测产生成像信号。例如,传感器510可包括多个干涉探测器510-1、510-2、…, 510 – 9。各干涉检测器510-1,510-2,…, 510-9可对应于各自的光瞳506-1,506-2,…, 506-9的波导502。例如,干涉检测器510-1可对应于光瞳506-1。

各干涉检测器510-1,510-2,…可产生检测信号512-1、512-2、…, 512-9,以响应用户的眼睛注视和与干涉测量检测器对应的光瞳相关联的位置514。例如,当用户的眼睛注视与光瞳506-1相关联的位置时,干涉测量检测器510-1可以产生检测信号512-1。

在一个实施例中,检测信号512-1、512-2、…512-9可使所述传感器510分析与所述位置514相关联的眼动追踪图像。例如,如果用户的眼睛注视与光瞳506-1相关联的位置,则检测信号512-1可使传感器510分析与光瞳506-1相关联的眼动追踪图像。

根据用户的视网膜位置,与正确光瞳对应的干涉仪可能比其他干涉仪产生更高强度的干涉信号。然后,所述信号可通过可将所述传感器信号转换为图像点的信号处理管道。

在一个实施例中,检测信号512-1、512-2、…, 512-9用于选择要分析的图像数据。例如,如果检测信号512-1和512-2表明用户的眼睛正在注视与光瞳506-1和506-2相关联的位置,则图像处理器520可以仅分析与光瞳506-1和506-2相对应的位置的图像数据518。

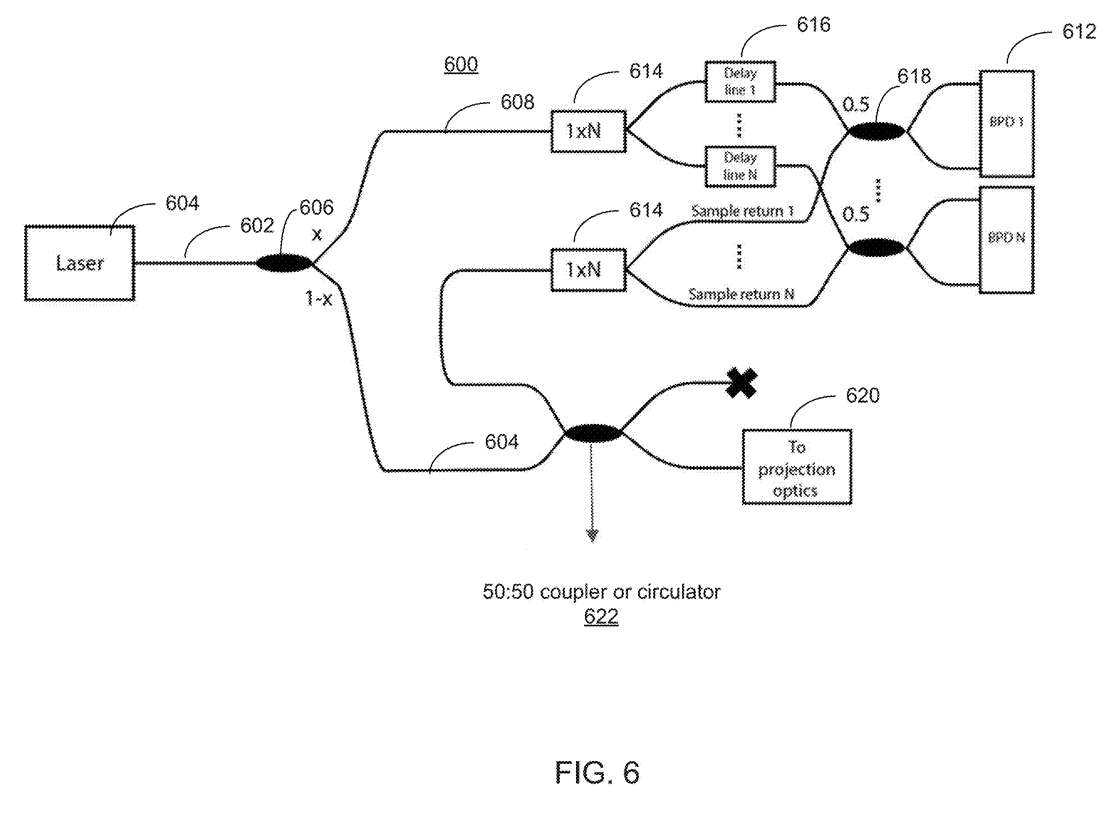

图6示出干涉检测系统600的示意图。在干涉检测系统600中,光场602由诸如激光器的光源604发射。光源604配置为发射红外光。

在一个实施例中,所述光场602进入分束器606,并分割为光场608和光场604。如图所示,检测路径可以包括1×N分路器614和中间有延迟线616的平衡光电探测器 612。

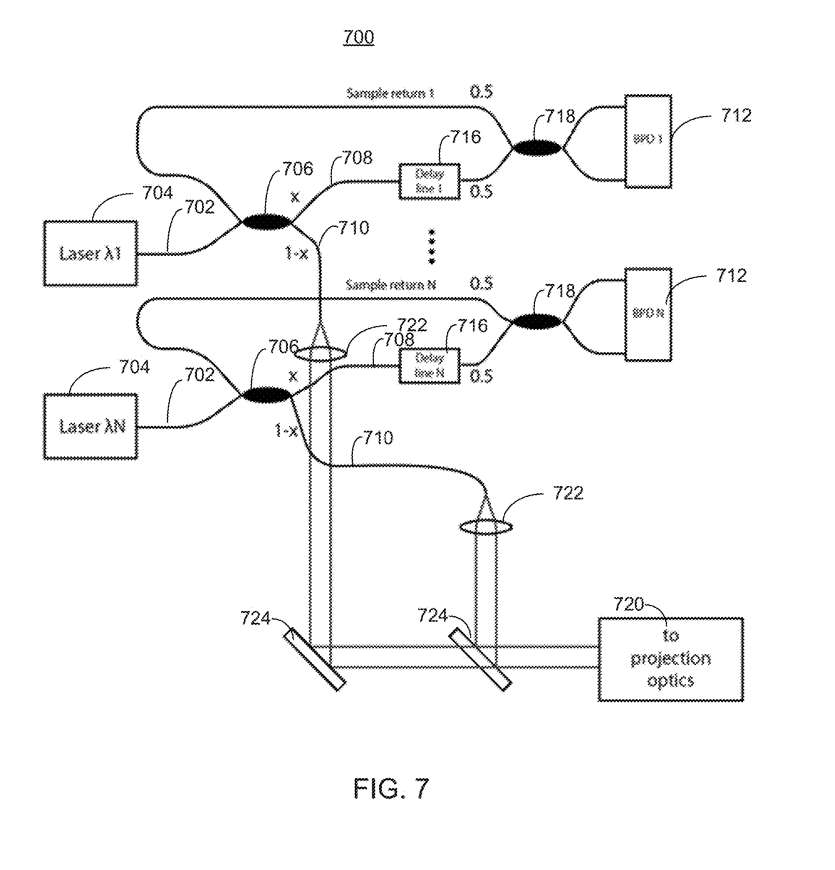

图7示出干涉检测系统700的示意图。在干涉检测系统700中,光场702由诸如激光器的光源704发射。光源704发射红外光。

在一个实施例中,所述光场702进入分束器706,并分割成光场708和光场710。检测路径可以包括分束器706、延迟线716、分束器718和平衡光电探测器。光场710通过各自的透镜722和部分反射镜724传播到投影光学元件720。

图8示出眼动追踪系统方法800的流程图。

如810,提供配置为发射红外线光的光源。

如820,提供包含耦入器的波导。

如820a所示,所述波导可实现为包括多个光瞳的多瞳显示波导。每个瞳孔可能对应于视窗区域的一部分。每个光瞳可以与检测器相关联,当用户的眼睛注视与光瞳相关联的位置时,检测器产生检测信号。

如830所示,提供配置为将红外光引导到耦入器的扫描仪。

如840所示,提供传感器。如840a块所示,传感器可产生基于干涉检测的成像信号。如840b所示,所述传感器可包括多个干涉探测器。每个干涉检测器可以对应于波导的一个单独的光瞳。

如840c所示,每个干涉测量检测器可以响应用户注视与干涉测量检测器对应的光瞳相关联的位置而产生检测信号。

如840d所示,检测信号可能致使传感器分析与位置相关的眼动追踪图像。例如,如果用户的眼睛注视着与光瞳506-1相关联的位置,则检测信号512-1可致使传感器510分析与光瞳506-1相关联的眼动追踪图像。可以获得并分析与光瞳相对应的图像数据,以确定用户的视线所指向的位置。

在一个实施例中,可使用与多个光瞳相对应的检测信号来选择要分析的图像数据。例如,如果检测信号表明用户的眼睛正在注视与两个光瞳相关的位置,则可以分析与这两个光瞳相关的位置对应的图像数据。与其他光瞳相关联的位置对应的图像数据可以从分析中省略。

相关专利

:

Meta Patent | Multi-pupil display and eye-tracking with interferometric sensing

名为“Multi-pupil display and eye-tracking with interferometric sensing”的Meta专利申请最初在2022年11月提交,并在日前由美国专利商标局公布。