(

映维网Nweon

2024年08月22日

)目前的VR/AR头戴式设备包括

眼动追踪

系统、内视摄像头和超声波扫描仪,它们可用于收集用户面部表情的实时信息,并帮助生成与用户相关的Avatar,从而具有真正的

社交

临在。然而,最先进的眼动追踪和面部追踪硬件使用的成像系统需要大量的系统功率和计算周期,它们往往是过于复杂的设备,体积庞大,重量大,而且实现高精度相对具有挑战性。

为解决沉浸式现实应用技术领域中出现的上述问题,Meta在名为“Embedded sensors in immersive reality headsets to enable social presence”的专利申请中提出使用一组模拟传感器,以低成本和低功耗的方式实现面部肌肉追踪。

另外,发明利用了头显面部界面和与用户接触的其他表面中的压力/触觉传感器、温度传感器、音频和潜在的其他传感器来实现基于用户肌肉收缩的眼动追踪和面部追踪。

其中,传感器可以识别哪些肌肉正在收缩,而软件可以利用相关输入来重建Avatar的面部肌肉运动,或者理解用户的视线在场景中的方向。

压力传感器将能够根据头显与面部接触来识别面部肌肉的运动,而温度传感器可以检测到肌肉血流量的增加。与图像处理相比,低压压力和温度信号的计算负荷更低,从而能够帮助实现功耗、成本和热节约。

另外,发明描述的实施例可以用于辅助光学技术,从而获得更好的性能和更低的功率。

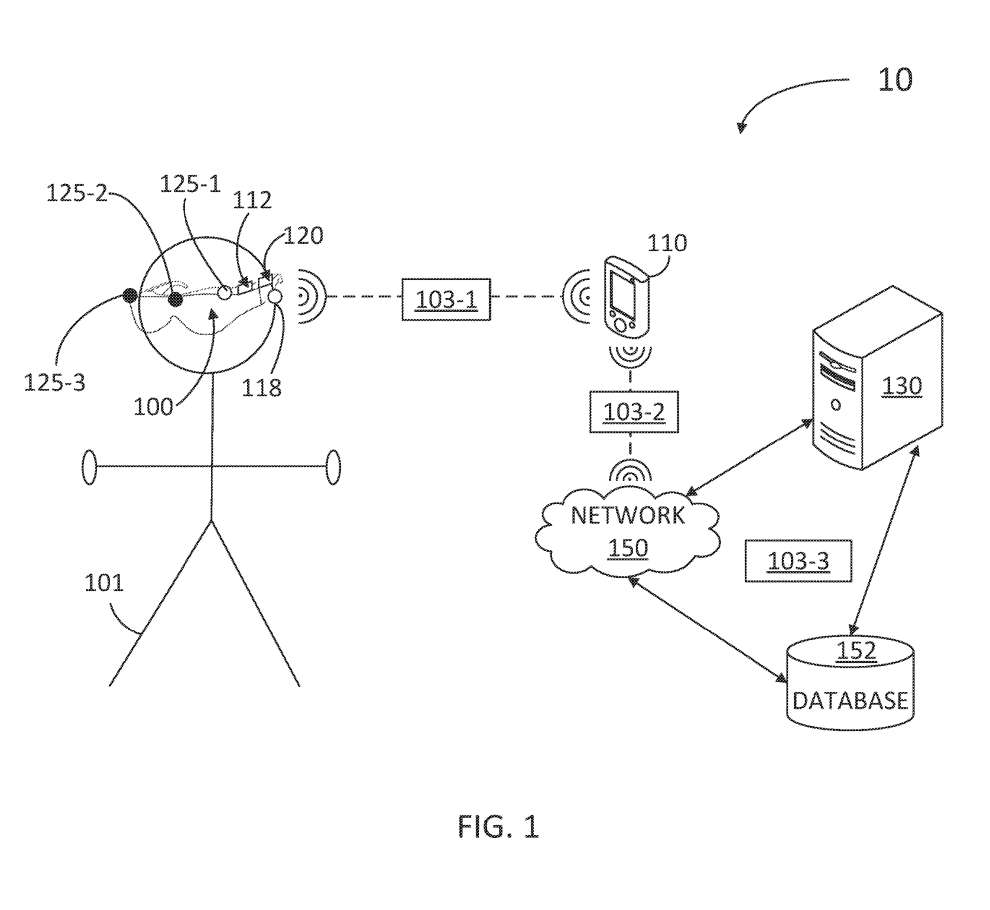

图1示出的架构10包括用户101穿戴的VR/AR头显100。

在一个实施例中,用户101可以耦合到移动设备110、远程服务器130和数据库152。VR/AR头显100可以包括智能眼镜或增强现实头显,移动设备110可以是智能电话。它们都可以通过无线通信相互通信并交换第一数据集103-1。

在一个实施例中,移动设备110可以属于用户101。数据集103-1可以包括录制的视频、音频或其他文件或流媒体。移动设备110可以通过网络150与远程服务器130和数据库152通信耦合,并且彼此传输/共享信息、文件等。

在一个实施例中,VR/AR头显100可以包括多个传感器125-1、125-2和125-3,例如安装在VR/AR头显100框架内的惯性测量单元、陀螺仪、麦克风、摄像头等。

可包括在VR/AR头显100中的其他传感器125可以是磁力计、麦克风、光电二极管和摄像头、触碰传感器和诸如电容传感器、压力传感器等其他电磁设备。智能眼镜100可包括声学麦克风和接触式麦克风。声学麦克风接收通过空气传播的声音信号,即压力波。接触式麦克风可以机械耦合到用户的皮肤和骨骼。

另外,VR/AR头显100或移动设备110可以包括存储指令的存储器电路120和配置为执行指令的处理器电路112。

在一个实施例中,VR/AR头显100、移动设备110、服务器130和/或数据库152可进一步包括通信模块118,使得所述设备能够通过网络150与远程服务器130进行无线通信。通信模块118可以包括例如射频硬件和软件,例如信号处理软件。所以,VR/AR头显100可以从远程服务器130下载多媒体在线内容。

在一个实施例中,隐私设置可以允许用户指定是否可以确定与用户相关的当前、过去或预测的情绪或情感信息,以及特定应用或处理是否可以访问、存储或使用此类信息。隐私设置可以允许用户选择是否允许特定应用或流程访问、存储或使用情绪或情感信息。

架构10可以基于用户提供的输入和与特定对象的交互,例如用户查看的页面或内容、用户上传的帖子或其他内容,以及与在线社交网络的其他内容的交互,来预测或确定与用户相关的心情、情感或情绪。

在特定的实施例中,架构10可以使用用户以前的活动和计算的心情、情感或情绪来确定当前的心情、情感或情绪。希望启用相关功能的用户可以在其隐私设置中表明,他们选择加入架构10,接收确定心情、情感或情绪所需的输入。

作为一个示例,架构10可以确定默认的隐私设置是不接收用于确定心情、情感或情绪所需的任何信息,直到用户明确表示架构10可以这样做。

相反,如果用户没有选择加入接收输入的架构10,则架构10可能无法接收、收集、记录或存储输入或与输入相关的任何信息。

在具体实施例中,架构10可以使用预测的心情、情感或情绪向用户提供推荐或广告。如果用户希望为特定目的或应用使用此功能,则用户可以指定额外的隐私设置,从而选择为特定目的或应用使用心情、情感或情感信息。

作为一个例子,架构10可以使用用户的心情、情感或情感来向用户提供新闻Feed、页面、朋友或广告。用户可以在其隐私设置中指定架构10可以确定用户的心情、情感或情绪。然后,用户可能需要提供额外的隐私设置,以表明用户的心情、情感或情绪可以用于特定目的。

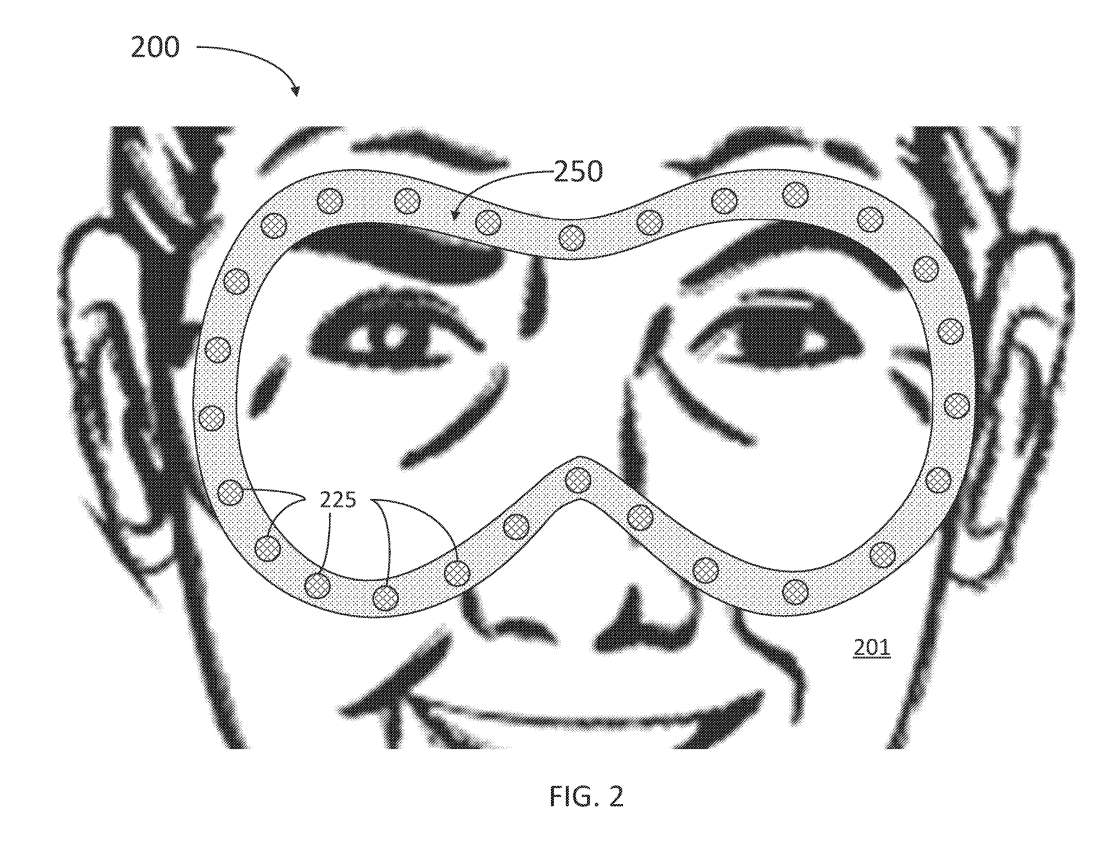

图2示出了用于头显200的面部界面250,包括根据一些实施例应用于用户201脸上的多个传感器225。传感器225可以包括电磁传感器,诸如心电图(E

CG

)传感器、脑电图(EEG)传感器、电容传感器(或接触传感器)、或电偶极子传感器等。传感器225还可以包括诸如接触式麦克风的麦克风和诸如加速度计、陀螺仪等的IMU传感器。

在一些实施例中,传感器225可以包括光学传感器,例如用于评估用户201的心血管状况(例如,来自面部动脉的心率和血压)的光容积脉搏描记(PPG)传感器。在一些实施例中,传感器225可以包括触觉传感器、湿度传感器和/或温度传感器。

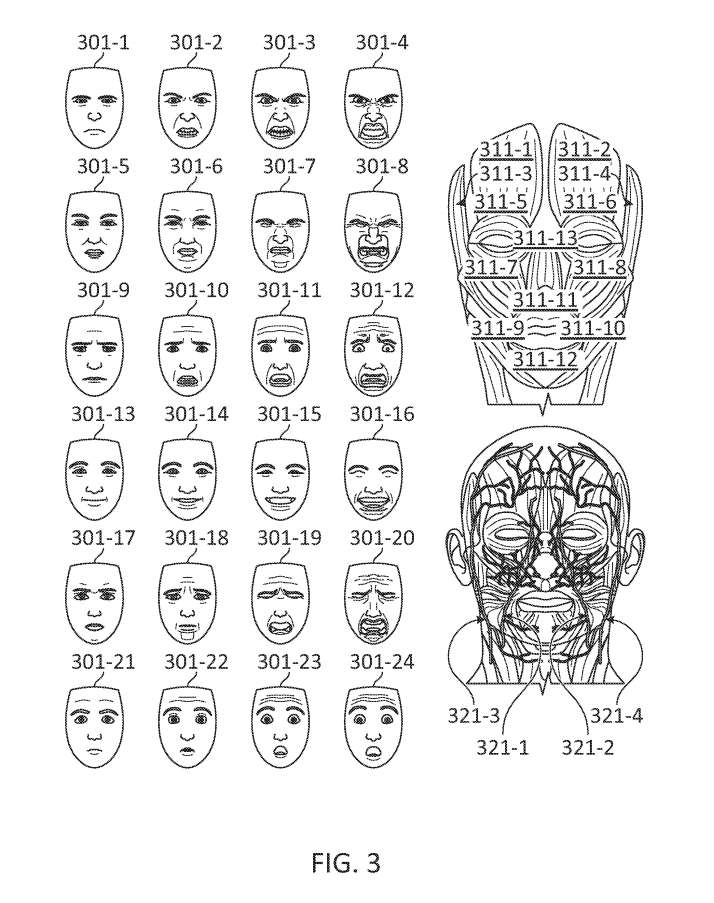

图3示出了面部表情301-1(严厉)、301-2(愤慨)、301-3(愤怒)、301-4(暴怒)、301-5(蔑视)、301-6(厌恶)、301-7(恶心)、301-8(反感)、301-9(担忧)、301-10(焦虑)。

图3进一步示出了301-11(恐惧)、301-12(惊恐)、301-13(满足)、301-14(开心)、301-15(喜悦)、301-16(大笑)、301-17(沮丧)。

另外,图表进一步示出301-18(忧郁)、301-19(悲伤)、301-20(悲痛)、301-21(警觉)、301-22(惊奇)、301-23(惊讶)和301-24(震惊)。

对于每个面部表情301,图表300可以包括激活的不同面部肌肉311及其激活程度(。肌肉激活可以通过IMU传感器、电容传感器或检测激活肌肉的神经元中的电场或肌肉运动本身的电传感器来检测。湿度传感器同时可以检测用户面部的肌肉运动或焦虑模式。

另外,图表300可以用面部动脉321-1、321-2、321-3和321-4的列表来补充。通过动脉321的血流可以通过PPG传感器或者甚至温度传感器来检测。

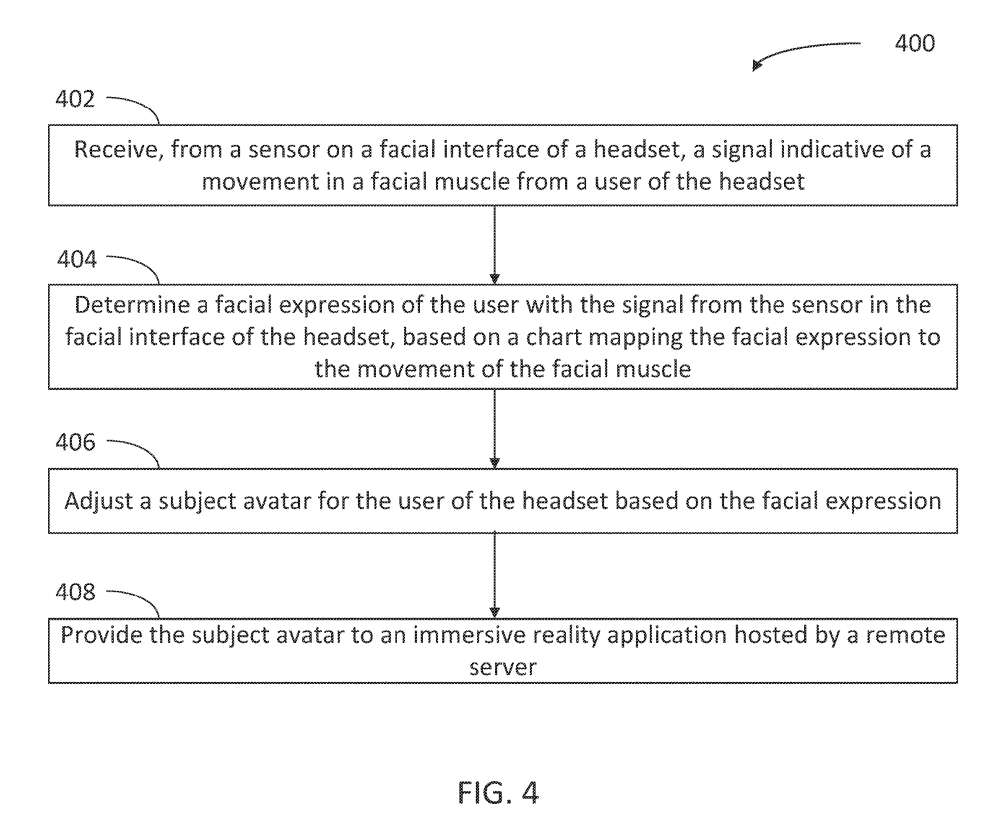

图4示出实时更新沉浸式现实应用的Avatar的方法400。

步骤402包括从头显面部界面的传感器接收来自用户的指示面部肌肉运动的信号。

在一个实施例中,步骤402包括从惯性运动单元、电传感器、电容传感器、接触式麦克风、光学传感器、触觉传感器和温度传感器中的一个接收信号。信号是来自面部肌肉的神经激活的电信号,并且步骤402包括通过传感器在面部界面的位置来识别面部肌肉。步骤402同时包括评估一个或多个面部肌肉是否移动以及移动到何种程度。

步骤404包括基于将面部表情映射到面部肌肉的运动的图表,利用来自面部界面中的传感器的信号来确定用户的面部表情。步骤404同时包括基于用户的面部表情来确定用户的身体状况。另外,步骤404包括基于用户的面部表情和沉浸式现实应用中的环境来确定用户心理状况。

步骤406包括基于面部表情来调整用户的Avatar。在一个实施例中,步骤406包括基于面部表情来成型用户面部的三维立体模型。

步骤408包括将Avatar提供给由远程服务器托管的沉浸式现实应用程序,在头显中基于面部表情显示用于用户的反馈消息,基于沉浸式现实应用中的观众来修改用户的面部表情。

图5是示出使用传感器信息来更新Avatar的方法500。

步骤502包括从远程服务器向沉浸式现实应用中的多个参与者使用的一个或多个头显提供第一参与者的Avatar。

步骤504包括接收指示第一参与者的面部肌肉的运动的信号。

步骤504进一步包括从惯性运动传感器、接触式麦克风、电传感器、电容式传感器、光学传感器、触觉传感器和温度传感器中的至少一个接收信号,将来自第一头戴式耳机的面部界面中的一个或多个传感器的多个信号进行积分,从具有第二参与者的头显接收指示来自第二参与者面部肌肉的运动的信号,基于信号确定第一参与者的面部姿态,以及用面部姿态更新第二参与者的Avatar。

步骤506包括基于信号来确定第一参与者的面部姿态。

步骤508包括用面部姿态更新第一参与者的Avatar。

相关专利

:

Meta Patent | Embedded sensors in immersive reality headsets to enable social presence

名为“Embedded sensors in immersive reality headsets to enable social presence”的Meta专利申请最初在2022年11月提交,并在日前由美国专利商标局公布。