(

映维网Nweon

2024年08月20日

)Apple

Vision

Pro支持外设,这意味着系统需要从手势使用模式切换到外设使用模式。在名为“Suppression of hand gestures upon detection of peripheral events on a peripheral device”的专利申请中,

苹果

就介绍了一种相关处理方法。

在一个实施例中,发明描述的方法包括响应于从外设检测外设事件,为一个或多个用户获取姿势信息。可以分析每只手的手的姿势,以确定每只手是否处于外设使用模式。外设使用模式可以指示用户将使用外设,因此不应考虑基于手势的输入。

为了响应于确定手处于外设使用模式,在外设使用模式下手检测到的任何手势都可能被忽略或拒绝。更具体地说,与手势相关的动作将被删除。

在一个实施例中,发明同时包括使用计算机视觉来确认外设的存在。识别外设对象的存在和位置可能具有计算成本和功率需求。因此,最好使用低功率技术来确定外设在相关区域的位置。

如果手势或运动表明外设组件可能在附近,则可以激活计算机视觉系统以确认外设的存在。类似地,如果在手动追踪管道的图像数据中检测到外设,则可以激活计算机视觉系统来确定外设的存在。

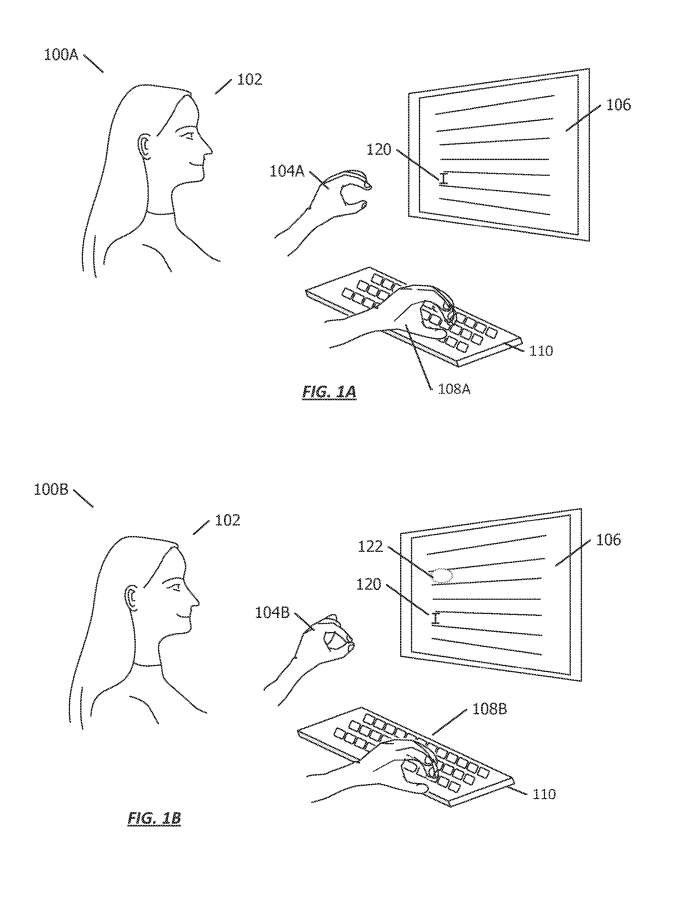

在图1A中,用户102正在查看显示设备106。在一个实施例中,可以为每只手确定输入模式。例如基于追踪数据和/或其他捕获数据,可以确定每只手是否处于外设使用模式或手势输入模式。

电子系统同时可以配置为执行注视追踪。注视点数据可以指示用户102注视的方向。在训练网络以预测手是否处于外设使用模式时,可以考虑注视数据,或者可以用作启发式确定手是否处于手势输入模式的外设使用模式。

基于各种输入,可以就输入模式对每只手进行确定。例如,手104a处于不太可能与外设的使用相关联的位置。因此,可以考虑手104a处于手势输入模式。同样,当手势由手104a执行时,可以接受手势输入。

相比之下,手108a处于外设使用模式,因为其姿势与外设输入相关联,并且定位接近外设110。

为了响应确定一只手可能处于外设使用模式,可以触发计算机视觉技术的执行,以确认场景中存在外设。例如,手追踪网络可以使用包括手的图像信息来确定手的特征。如果手的姿势表明它可能与外设交互,则可以触发系统对图像信息执行对象检测。

图1B显示了系统设置100b的替代视图。在这里,用户102用手104B执行捏手姿势,而手108B仍处于外设使用模式。电子系统可以确定,由于手104B处于手势输入模式,因此允许与手势相关联的用户输入动作。因此,在显示设备106呈现输入表示122。

值得注意的是,由于手108B可以在外设110执行输入动作,而手104B执行用户输入手势,因此可以做出手势104b是有意的决定。

为了响应检测到外设事件,电子系统可以确定与外设事件相关联的手处于外设使用模式。在外设使用模式下,当手势输入识别为由两只手执行时,手势输入可能会删除。然而,在某些情况下,输入模式可能特定于单手。因此,如果确定该手不处于外设使用模式,则可以由不同的手允许手势输入。

因此,继续图1B中所示的示例,其中手108b处于外设使用模式,手104b处于手势输入模式(或非外设使用模式),手108b的手势输入将被删除,而手104b手势输入将被识别。

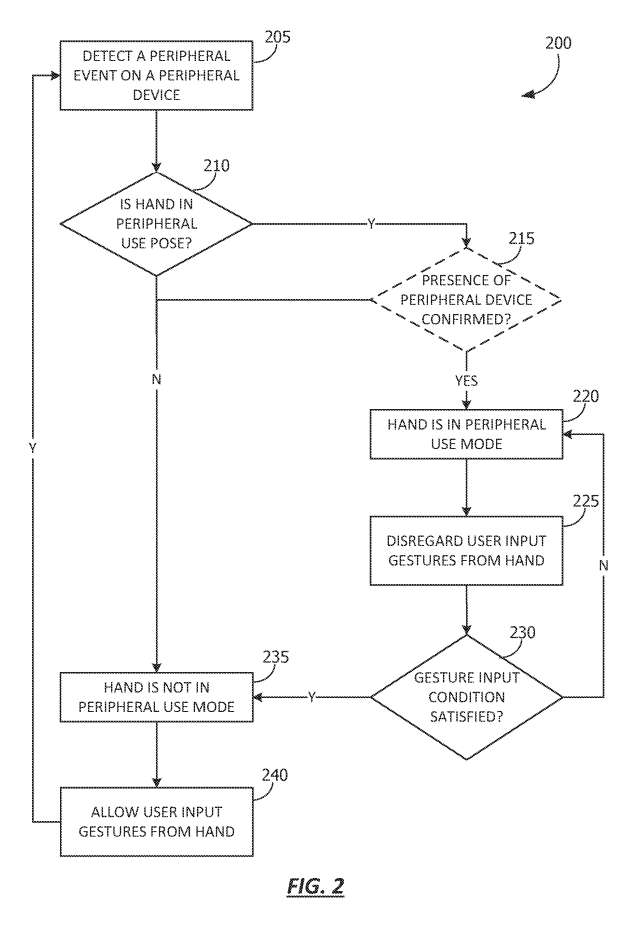

转向图2,流程图显示了一种用于确定手是否处于外设使用模式的技术。

在205,在外设检测到外设事件。可以通过多种方式检测到外设事件。例如,如果追踪系统包括外设,则系统可以检测到通过特定外设接收用户输入。作为另一个示例,系统可能接收到发生命中事件的指示,或者可以监控场景以确定在外设是否发生了命中事件。

在210,确定手是否处于外设使用模式。如果确定特定手处于外设使用位置,则可选地进入215,其中系统可以启动对象追踪或其他计算机视觉技术,以确定是否存在外设。

在220,手被认为处于外设使用模式。根据某些情况,例如,在外设使用模式下,通过用户输入管道处理来自命中事件的用户输入。

同时在225,用户输入手势被拒绝或以其他方式被忽略。换句话说,如果手处于外设使用模式,则确定在使用外设期间检测到的任何手势都是无意的,因此不会采取行动。在某些情况下,可能会识别用户输入手势,但可能不会执行与输入手势相关的操作。

在230,确定是否满足手势输入条件。另一方面,可以做出决定,以便在外设使用模式下继续考虑手。手势输入条件可能包括预定义的外设使用模式的超时条件。超时条件可能指示检测到命中事件后的一段时间,并且当手不再考虑处于外设使用模式时,手被确定为处于外设使用模式。

换句话说,可能需要一个新的输入模式确定来保持一只手在外设使用模式中。相应地,如果手势输入条件不满足,则流程图200返回220,并且手继续被认为处于外设使用模式。或者,如果确定手势输入条件满足,则流程图继续到235,其中手被认为不处于外设使用模式,并且现在处于手势输入模式。

返回210,如果确定手不处于外设使用位置(并且可选地,如果未确认外设的存在),则流程图同样继续到235。在235,手被认为不处于外设使用模式。在某些情况下,手可能被认为处于手势输入模式。

如上所述,手可以在各种条件下退出外设使用模式。例如,超时条件可能指示手势输入再次被手接受。作为另一个例子,预定义的移动或满足手势输入阈值的其他移动可能会导致手退出外设使用模式。

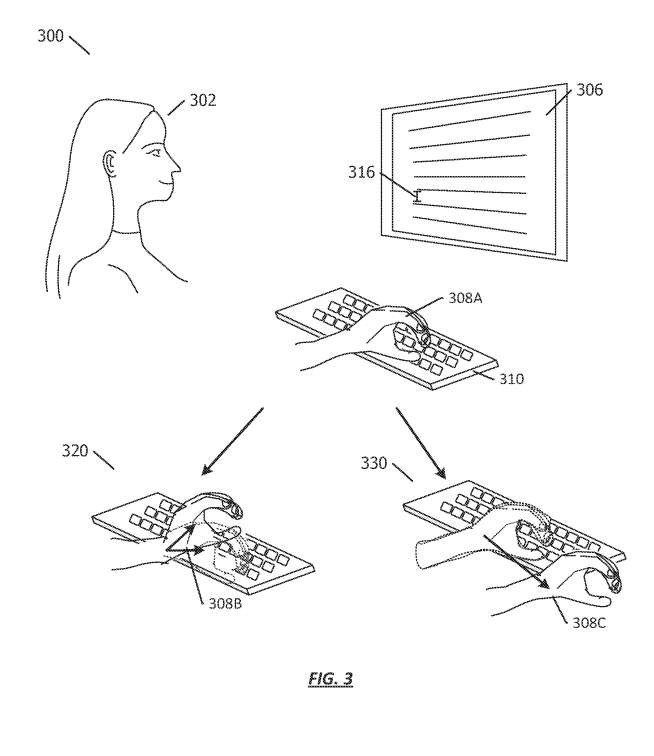

图3显示了退出外设使用模式的示例。一只手可以以多种方式退出外设使用模式,例如在手姿势改变后、超时期或基于满足退出条件的运动。图3显示了这种运动的两个示例。

在图320中,手308b为手腕旋转,其程度满足移动阈值,导致手从当前姿势移动一定程度,从而退出外设使用模式。因此在图320中,手势输入可以从308b接收和处理,以允许用户302与显示设备306的用户界面交互。

基于手部姿势的追踪信息,可以确定手腕运动满足运动阈值。例如,可以追踪起源于手腕并跟随手的向量的方向变化。同样,如308b所示,腕部矢量旋转预定量。作为另一个示例,旋转可以基于前臂向量和腕部向量之间的关系来确定,使得由关系识别的旋转满足运动阈值。

作为另一个例子,图表330显示了手308C的移动,因此从原始手位置到新位置的转换满足了移动阈值。这种转换可能由3D空间中手的相对位置决定。例如,可以在一系列帧上追踪手的质心、手腕位置或手的其他位置,以确定是否满足阈值距离。

当用户与用户界面交互时,可以实时确定手是否处于外设使用模式。因此,当检测到输入手势时,如何处理手势取决于执行手势的手的当前输入模式。

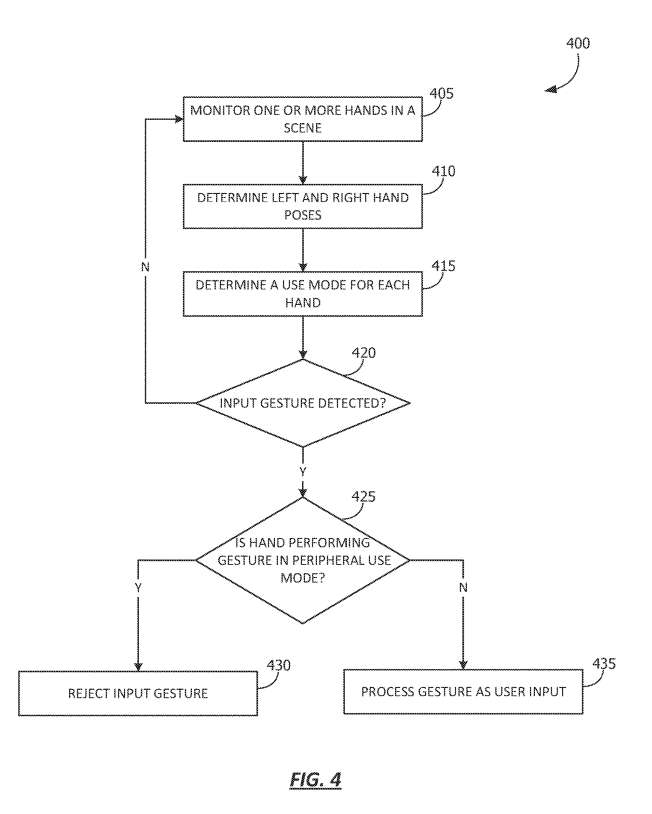

图4显示了处理用户输入的技术流程图。

在405,监控一只或多只手。例如,可以基于手追踪模块或类似模块对手进行监控。因此,可以监控手的图像数据、姿势、深度、运动或类似。

在410,确定左手和右手姿势。姿势可能包括姿势信息、手势或类似信息。在415,姿势可以包括确定使用模式的数据。

在420,进行确定以检测输入手势。例如,可以从手动追踪管道检测输入手势。换句话说,手追踪管道可以提供手数据,当手执行与用户输入相关联的预定手势时,可以从中做出决定。在某些情况下,可以从双手检测输入手势。如果未检测到手势,则流程图返回405,并在场景中连续监控一只或多只手。

返回420,如果确定检测到手势,则流程图继续到425,并且确定执行手势的手是否处于外设使用模式。如果在425确定执行手势的手处于外设使用模式,则流程图继续到430。在430,输入手势被拒绝或忽略。相反,返回425,如果确定执行手势的手不处于外设使用模式,则流程图在框435得出结论,并且手势被处理为用户输入。因此,检测到的手势仅在手势不处于外设使用模式时作为用户输入处理。

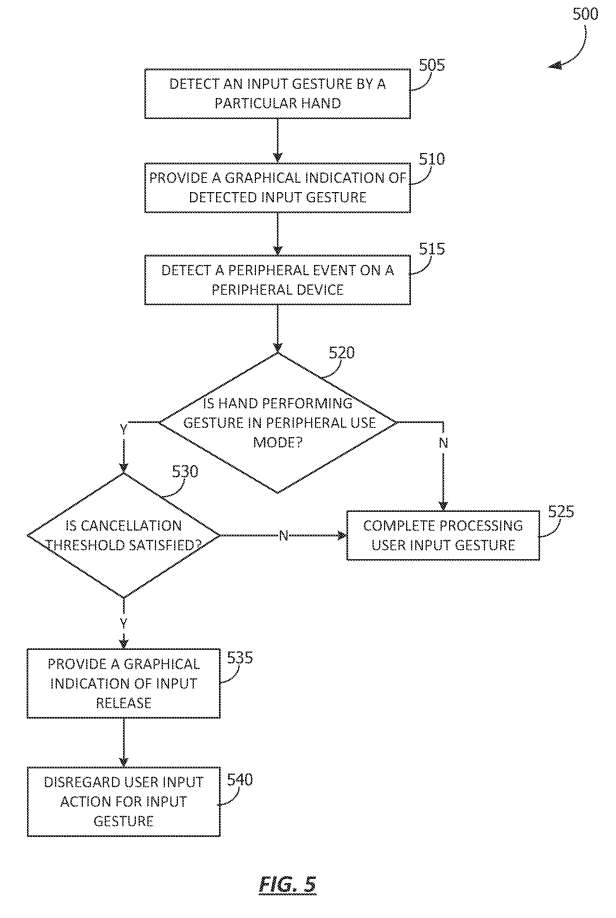

图5显示了根据某些情况取消输入手势动作的技术流程图。

在505,从特定手检测到输入手势。例如,可以从手动追踪管道检测输入手势。

在510,在用户界面上显示检测到的输入手势的图形指示。

在515,在外设上检测到命中事件。可以通过多种方式检测到命中事件。例如,如果系统包括外设,则系统可以检测到通过特定外设接收用户输入。作为另一个示例,系统可以接收发生命中事件的指示,或者可以监控场景,以确定是否使用外设发生了命中事件。

在520,确定手势是否处于外设使用模式。手是否处于外设使用模式可以通过多种方式确定,如上文关于图2所述。如果确定手不处于外设使用模式,则在525得出流程图结论,并处理用户输入手势。

如果确定手势处于外设使用模式,则流程图继续到530。在530,做出决定以满足取消阈值。如果在530确定取消阈值不满足,则流程图在525得出结论,并且用户输入手势被视为用户意图,即手势输入未被删除。

如果确定取消阈值已满足,则流程图继续到535。在535,显示指示手势释放的图形指示。手势发布的图形指示可能表明启动用户输入的用户输入操作不再完整。换句话说,与用户输入组件关联的操作已被取消。

流程图在540结束,输入手势的用户输入操作被忽略。

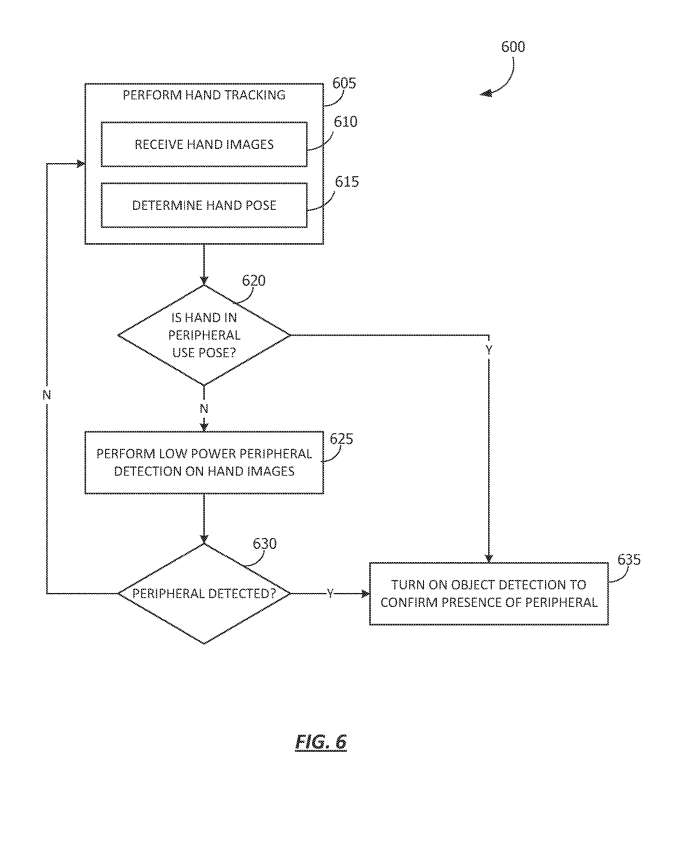

图6显示了根据一个或多个实例激活计算机视觉系统的技术流程图。

在605,执行手动追踪。在605执行手追踪包括接收在610显示的手图像,并确定在615显示的手姿势。

在620,确定手是否处于外设使用位置。如果在620确定手处于外设使用位置,则流程图在635处得出结论。在635,激活对象检测以确认外设的存在,并可选地识别外设。

如果确定手不处于外设使用模式,则流程图继续块625,并且在手图像上执行低功率外设检测。

在630,当在低功率模式下检测到外设时,进行确定。如果未检测到外设,则流程图返回605,系统连续执行手追踪。相反,返回630,如果在低功率模式下检测到外设,则流程图在635得出结论,其中激活高功率计算机视觉模式以确认场景中外设的存在或位置。

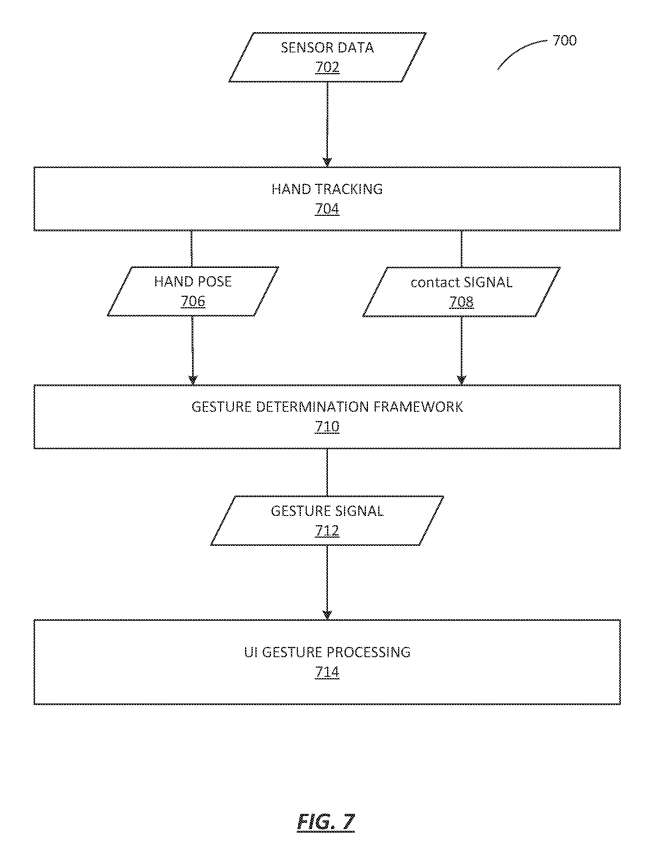

图7显示了测输入手势的流程图。

从传感器数据702开始。传感器数据包括从用户的手或手捕获的图像数据和/或深度数据。

传感器数据702可以应用于手动追踪网络704。手追踪网络可能是一个经过训练的网络,并用于估计用户手或手的物理状态。手追踪网络704预测手姿势706。手势可以是基于估计物理状态的手的分类姿势,或者可以提供指示手姿势的其他形式的数据。

在一个实施例中,可以进一步配置手动追踪网络704以提供接触数据,例如以接触信号708的形式。联系数据可能包括一个预测,即对于给定的帧或帧,两个区域之间是否发生联系。例如,可以训练机器学习模型来预测拇指垫和食指是否接触。

根据一个或多个实例,手势确定框架710提供了一个确定传感器数据702中呈现的特定姿势是不是有意的。当确定的手势包括接触事件(例如捏)时,则手势确定框架710可以使用由手追踪网络704提供的接触信号708来确定是否执行有意手势。

手势确定框架710可以使用图7中未明确定义的附加数据。例如,手势确定框架710可以接收诸如用户界面几何、注视估计、由连接外设生成的事件、与对象的用户交互等信号。

UI手势处理模块714可以配置为基于手势信号712启用用户输入动作。如果接收到对应于已经初始化的手势信号712的取消信号,则系统可以处理与未取消的手势不同的手势。

图8显示了对手势意向性进行分类的技术流程图。

在805,基于来自手动追踪网络704的接触数据检测接触事件。

在810,从手动追踪数据确定接触阶段。在给定的框架内,接触阶段可能表明手指目前处于接触行动的哪个阶段。

在815,估计与接触相关的low-level特征。low-level特征可根据手追踪数据和/或其他数据确定,包括对帧期间手在做什么的估计。

在820,估计high-level、low-state特征。high-level、low-state特征可能包括估计用户在接触期间的行为以确定意向性的模态功能。

根据一个或多个实例,high-level可能表明用户可能处于外设使用模式。例如,可以追踪腕关节和一个或多个手指的位置。如果手指相对于腕关节的运动满足预定义参数,则可确定手处于外设使用模式。

流程图在825结束,手势确定框架710结合了high-level和接触阶段来分类意向性。

相关专利

:

Apple Patent | Suppression of hand gestures upon detection of peripheral events on a peripheral device

名为“Suppression of hand gestures upon detection of peripheral events on a peripheral device”的苹果专利申请最初在2023年9月提交,并在日前由美国专利商标局公布。