(

映维网Nweon

2024年05月18日

)近期美国专利及商标局公布了一批全新的AR/VR专利,以下是映维网的整理(详情请点击专利标题),一共41篇。更多专利披露请访问映维网专利板块

https://patent.nweon.com/

进行检索,你同时可以加入映维网AR/VR专利交流微信群(详见文末)。

1. 《

Meta Patent | Cryptographic key exchange(Meta专利:加密密钥交换)

》

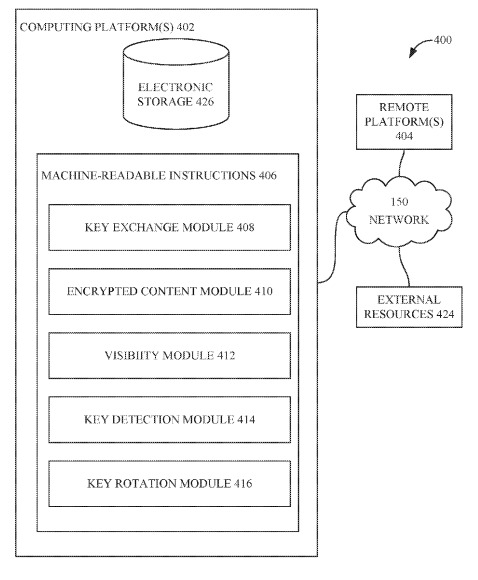

在一个实施例中,专利描述的技术用于提供加密密钥交换。所述方法可以包括识别配置用于加密的加密密钥的数据库;发送对用于内容解密的私钥的请求;从客户端接收私钥。基于私钥和数据库来确定内容的内容帖子的可见性参数;根据可见性参数以可见性向客户端提供内容。

2. 《

Meta Patent | Mixed array of vcsel devices having different junction types and methods of forming the same(Meta专利:具有不同结类型的VCSEL器件的混合阵列及其形成方法)

》

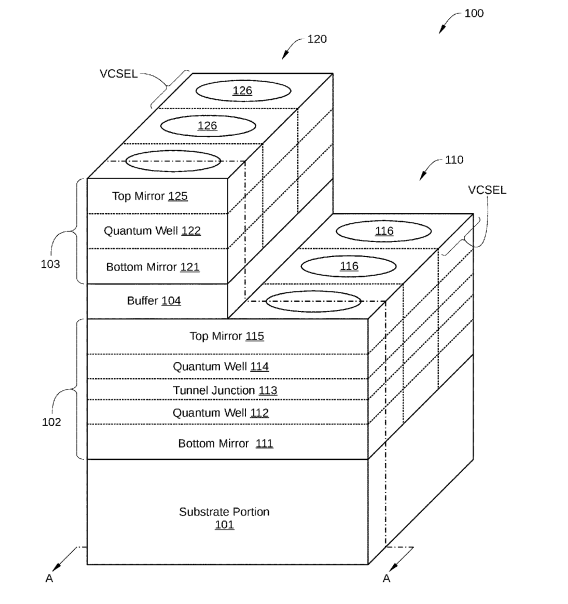

在一个实施例中,专利描述的发光器件包括:由半导体衬底的一部分形成的单个管芯;由设置在所述单个管芯上的第一组材料层形成的第一垂直腔表面发射激光器(VCSEL);以及由设置在所述第一组材料层上的第二组材料层形成的第二VCSEL,其中所述第一套材料层设置在半导体衬底的所述部分与所述第二套材料层之间。

3. 《

Meta Patent | Transparent antenna on lens with metalized edge(Meta专利:带金属边缘透镜之上的透明天线)

》

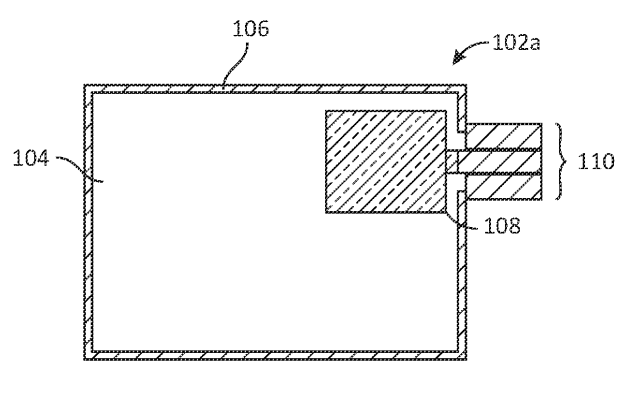

在一个实施例中,专利描述的设备可以包括天线辐射结构,天线辐射结构包括有源透明网格部分以及不透明天线辐射器部分。通过将透明金属网和不透明金属膜组合到天线辐射结构中,可以提高辐射效率。另外,当覆盖在透明透镜上时,由于非透明金属膜的放置,天线辐射结构使透镜的光学透明度在很大程度上不受影响。

4. 《

Meta Patent | Browser enabled switching between virtual worlds in artificial reality(Meta专利:浏览器支持在人工现实中的虚拟世界之间切换)

》

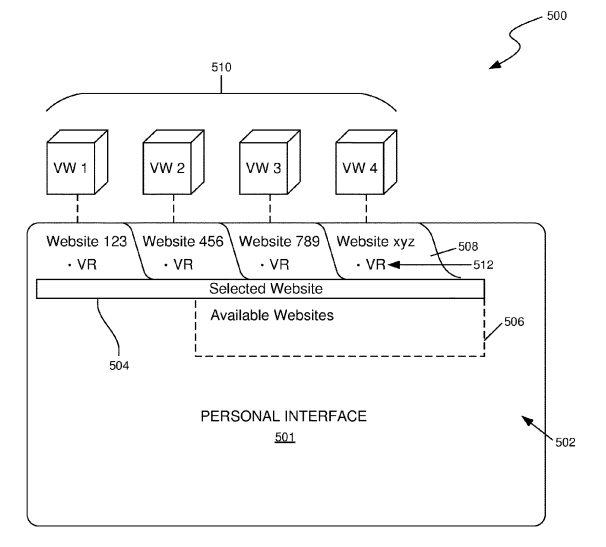

在一个实施例中,专利描述的系统针对用于可互换地提供对多个虚拟世界的访问的虚拟Web浏览器。对应的网站和虚拟世界对的浏览器选项卡可以与相关联的控件一起显示,对这样的控件的选择影响虚拟世界的3D内容的实例化。作为与虚拟世界中的对象的交互的结果,可以自动生成一个或多个选项卡,从而便于前往与交互所指向的对象相对应的世界。

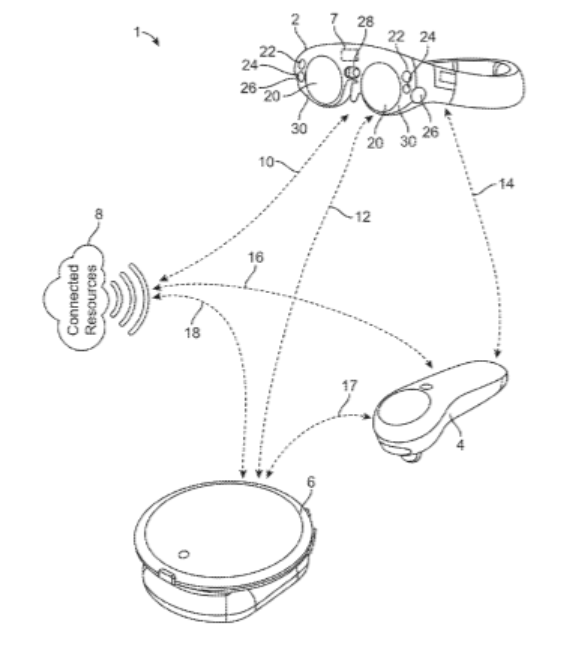

5. 《

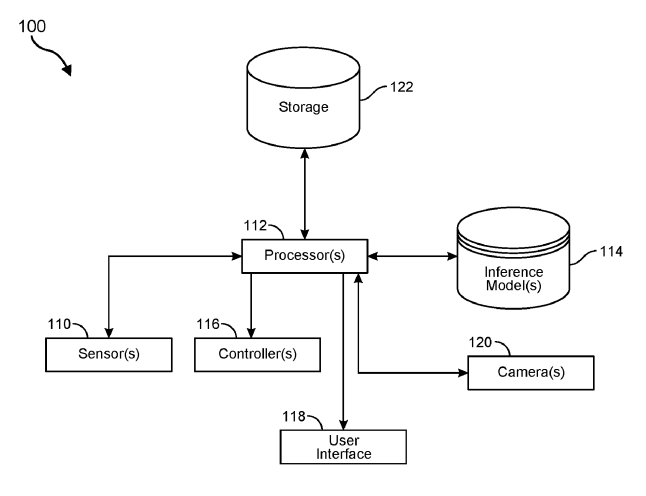

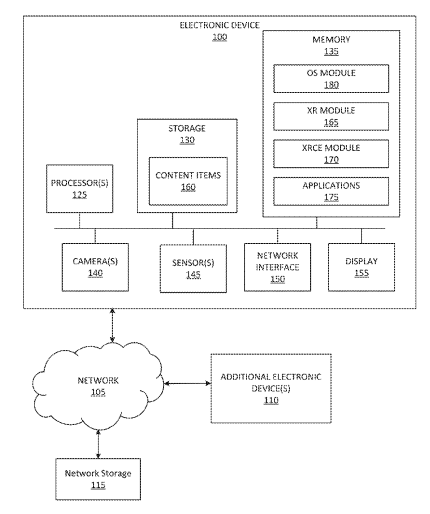

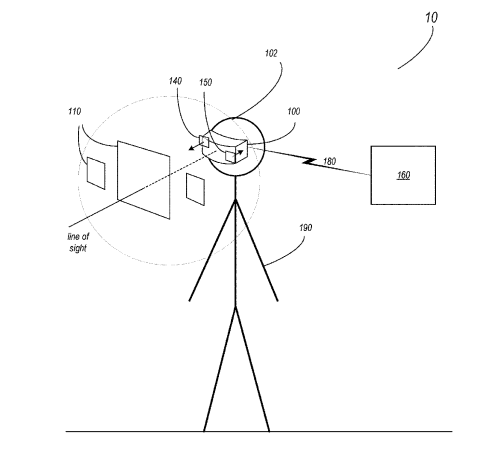

Meta Patent | Systems and methods for contextualized interactions with an environment(Meta专利:用于与环境进行情境化交互的系统和方法)

》

在一个实施例中,用于生成环境的3D地图和/或用于利用3D地图使得用户能够控制环境中的智能设备和/或与环境中的人交互。为了生成3D地图、执行控制和/或与人交互,用户可以佩戴多个神经肌肉传感器。传感器可以布置在用户佩戴的载体上,并且可以配置为感测来自用户的神经肌肉信号。配置为捕捉关于环境的信息的摄像头可以布置在用户佩戴的载体上。传感器和摄像头向耦合到存储器的计算机处理器提供数据。

6. 《

Meta Patent | Protection of augmented reality (ar) display in near-eye display device(Meta专利:保护近眼显示设备中的AR显示器)

》

在一个实施例中,AR近眼显示设备中的光学堆叠组件的显示元件可以通过光学堆叠组件元件的各个表面上的一个或多个保护涂层来保护免受紫外线和/或红外线暴露。光学堆叠组件的元件的一个表面上的光致变色涂层同样可以代替保护涂层或除了保护涂层之外使用。

7. 《

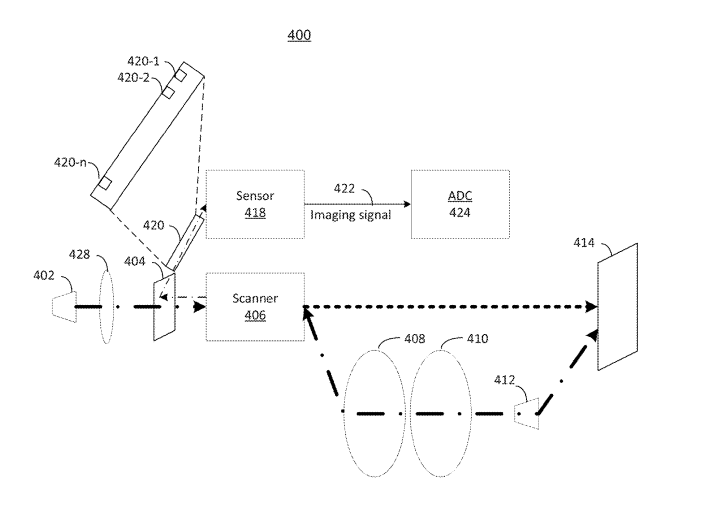

Meta Patent | Multi-pupil display and eye-tracking with interferometric sensing(Meta专利:多瞳显示器和干涉传感眼动追踪)

》

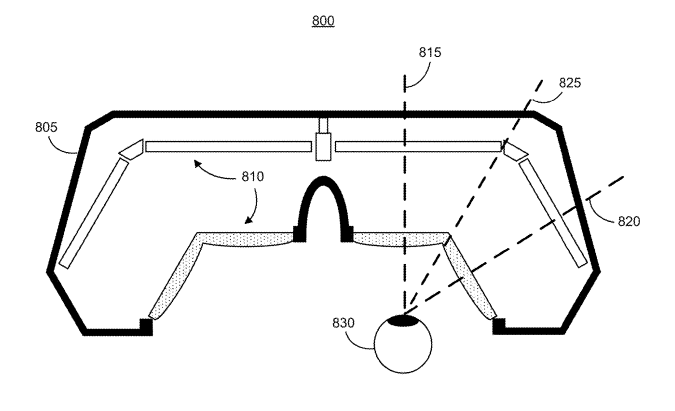

在一个实施例中,

眼动追踪

系统可以包括用于发射IR光的光源。波导可以包括耦入器。扫描仪可以将IR光引导到耦入器,耦入器可以配置为引导红外光朝向用于视窗区域离开波导。扫描仪可以将可见光引导到耦入器。耦入器可以将可见光引导向视窗区域以显示为虚像。当红外光经由扫描仪和耦入器入射到传感器时,传感器可以产生成像信号。

8. 《

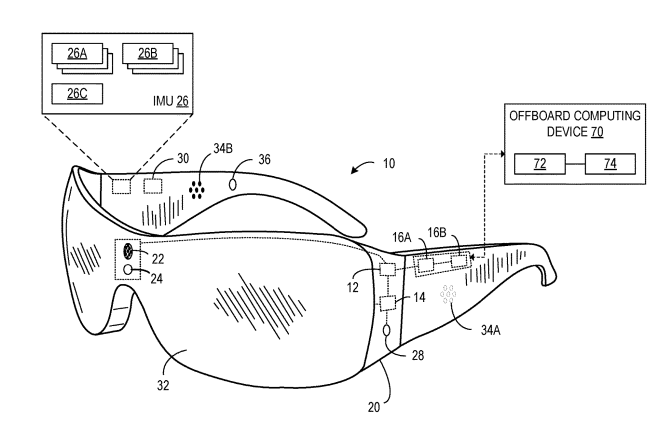

Microsoft Patent | Estimating runtime-frame velocity of wearable device(微软专利:估计可穿戴设备的运行时帧速)

》

在一个实施例中,专利描述的可穿戴计算设备包括配置为附着到用户身体的设备主体。可穿戴计算设备可以进一步包括惯性测量单元IMU和处理器。处理器可以在设备主体固定到用户的身体时从IMU接收运动学数据。处理器可以对运动学数据执行第一坐标变换,将其转换为训练可穿戴计算设备的训练坐标系。在使用包括在训练可穿戴计算设备处收集的训练运动学数据的训练数据来训练的第一机器学习模型处,处理器可以基于变换的运动学数据来计算可穿戴计算设备的训练帧速度估计。处理器可以对训练帧速度估计执行第二坐标变换以获得运行时帧速度估计,并且可以将运行时帧速率估计输出到目标程序。

9. 《

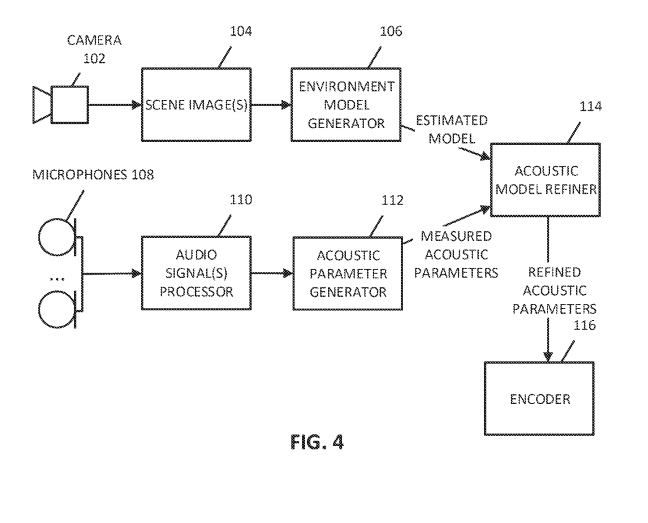

Apple Patent | Audio encoding with compressed ambience(苹果专利:压缩环境下的音频编码)

》

在一个实施例中,专利描述的音频设备可以使用多个麦克风来感测物理环境中的声音以生成多个麦克风信号。可以从麦克风信号中提取语音。可以从麦克风信号中提取环境声音。可以以第一压缩级别对语音进行编码。可以以高于第一压缩级别的第二压缩级别对环境声音进行编码。

10. 《

Apple Patent | Conversation privacy for third party applications(苹果专利:第三方应用程序的对话隐私)

》

在一个实施例中,专利描述了用于在多用户通信会话中进行协作的技术,包括在第一设备处接收在与第二设备的多用户通信对话中启动第一应用程序的请求;在所述多用户通信会话中呈现所述第一应用程序的环境;通过所述多用户通信会话的一个或多个进程接收来自所述第一用户的数据,所述数据包括输入数据和第一通信数据;通过所述一个或多个进程向所述第一应用程序提供所述输入数据;通过所述一个或多个进程向所述第二设备提供所述第一通信数据;通过所述一个或多个进程从所述第二设备接收第二通信数据;以及通过所述一个或多个进程在所述第一应用程序的环境中呈现所述第二通信数据,其中所述第一程序限制访问所述第一通信数据和所述第二传信数据。

11. 《

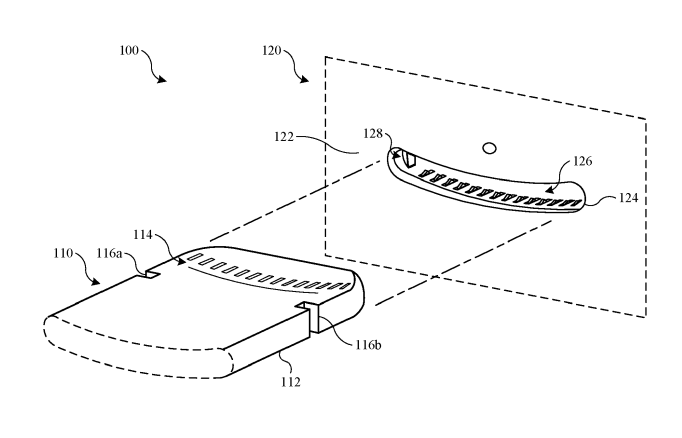

Apple Patent | Connector assembly(苹果专利:连接器组件)

》

在一个实施例中,专利描述的连接器包括插座外壳、引脚触点和保持器。插座壳体具有凸壁部分、凹壁部分、在凸壁部分和凹壁部分之间延伸的第一侧壁部分、以及在凸壁部和凹壁部之间延伸的第二侧壁部分。凸壁部分、凹壁部分、第一侧壁部分和第二侧壁部分至少部分地限定具有开口端的空腔。引脚触点位于插座外壳的空腔中。保持器具有第一侧闩锁和第二侧闩锁,它们构造成在接合位置延伸到空腔中并且从空腔向外移动到脱离位置。

12. 《

Apple Patent | Camera parameter estimation using semantic labels(苹果专利:使用语义标签估计摄像头参数)

》

在一个实施例中,专利描述的设备获得包括多个点的场景的点云。每个点都具有三维坐标系中的三维坐标。第一组点具有第一语义标签。设备使用具有固有参数的摄像头获得场景的二维图像。设备在二维图像中检测与第一语义标签相对应的第一对象的表示。设备确定与第一对象相对应的二维图像的二维坐标系中的二维坐标。设备从第一点簇确定与场景的二维图像的二维坐标系中的二维坐标相对应的场景的三维坐标系的三维坐标。设备基于二维和三维坐标来估计固有参数。

13. 《

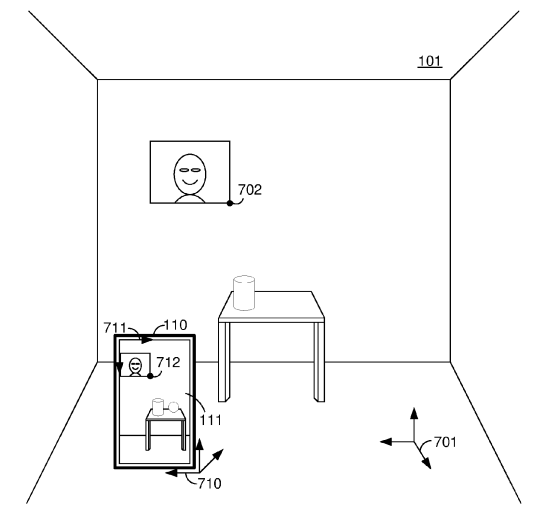

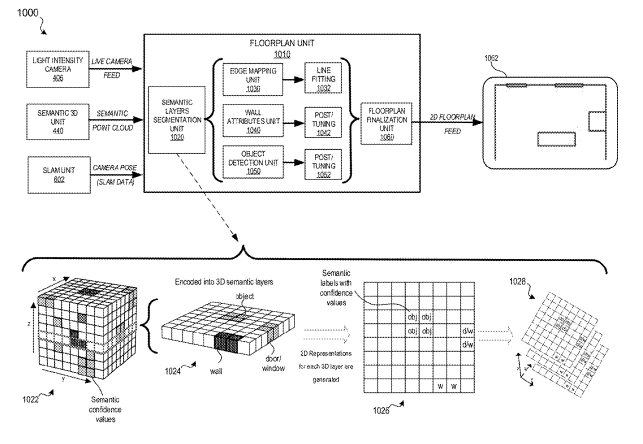

Apple Patent | Floorplan generation based on room scanning(苹果专利:基于房间扫描的平面图生成)

》

在一个实施例中,可以基于诸如图像和深度传感器数据的传感器数据来生成物理环境的3D表示。在使用物理环境的语义标记的3D表示来促进平面布置图和测量的生成。执行物理环境的3D点云的语义分割和标记。

14. 《

Apple Patent | Video compression methods and apparatus(苹果专利:视频压缩方法和装置)

》

在一个实施例中,专利描述了一种包括头戴式显示器和基站的混合现实系统。头显传感器收集的信息可以通过有线或无线连接传输到基站。在此基础上,渲染引擎部分基于传感器信息渲染包括虚拟内容的帧,并且编码器在通过连接将帧发送到头显之前根据编码协议压缩帧。来自头显和渲染引擎的运动矢量输入到编码器并用于压缩帧,而不是使用先前帧来估计编码器中的运动矢量。运动矢量可以与编码的帧数据一起被嵌入到数据流中,并且通过连接发送到头显。如果在头显处没有接收到帧,则头显可以使用运动矢量从先前帧合成帧。

15. 《

Samsung Patent | Wearable device for adjusting light transmittance according to illuminance of external light source, and method for controlling same(三星专利:根据外部光源照度调节透光率的可穿戴设备及其控制方法)

》

在一个实施例中,专利描述的可穿戴设备包括至少一个摄像头、至少一个透镜和至少一个处理器,其中所述至少一个传感器可以配置为识别通过所述至少1个摄像头获得的图像的照度信息,基于所识别的照度信息确定所述至少一个透镜上的位置,所述位置对应于所述照度信息,根据与所确定的位置对应的照度信息来确定所述图像的平均照度,并且将与所确定位置对应的亮度信息与所述平均照度进行比较,并且基于比较的结果来部分地调整所述至少2个透镜的透光率。

16. 《

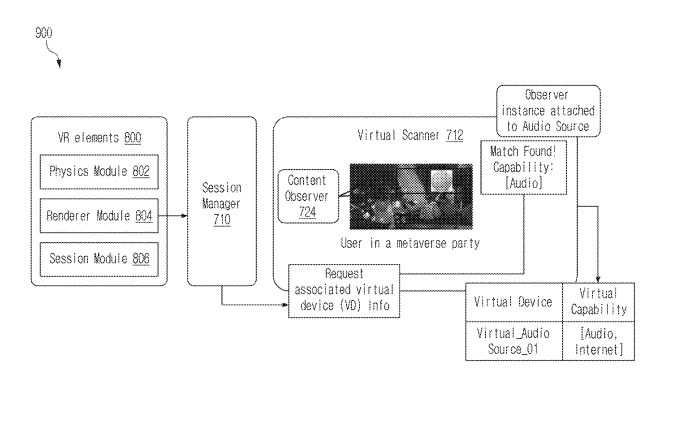

Samsung Patent | Device and methods for facilitating information flow using meta-context transfer(三星专利:使用meta-context transfer促进信息流的设备和方法)

》

在一个实施例中,专利描述的方法包括检测虚拟会话中的至少一个用户;基于检测到所述至少一个用户,基于检测到至少一个所述用户,获得所述虚拟会话中存在的至少一个虚拟设备内容的情景;使用所述虚拟会话中的至少一个用户输入来获得与所述至少一个虚拟设备内容相关的至少一种用户兴趣;获得所述至少一个用户兴趣与所述至少个用户的多个真实世界用户设备的至少一个内容能力之间的相关性信息;以及将所述多个用户设备中的至少一个真实世界用户设备提供给所述至少一个用户,用于基于所述相关性信息来传送所述至少个虚拟设备内容的情景。

17. 《

Samsung Patent | Device and method for transmitting voice data of user in virtual space(三星专利:在虚拟空间中传输用户语音数据的设备和方法)

》

在一个实施例中,用于构建虚拟空间的示例服务器包括配置为存储计算机可执行指令的存储器和配置为通过访问存储器来执行指令的处理器。当执行所述指令时,所述指令使得所述处理器从所述虚拟空间中的用户中的从第一用户的终端接收的第一用户的语音数据中提取与目标话语相对应的第一部分语音数据;指示所述目标用户的目标终端再现所述第一部分语音数据;并且,基于在所述目标终端再现所述第一部分语音数据的同时请求向所述目标用户发送第二用户的第二部分语音数据,指示所述目标端子显示基于所述第二部分声音数据生成的视觉信息。

18. 《

Samsung Patent | Electronic device for obtaining location of virtual object and method thereof(三星专利:用于获得虚拟对象位置的电子设备及其方法)

》

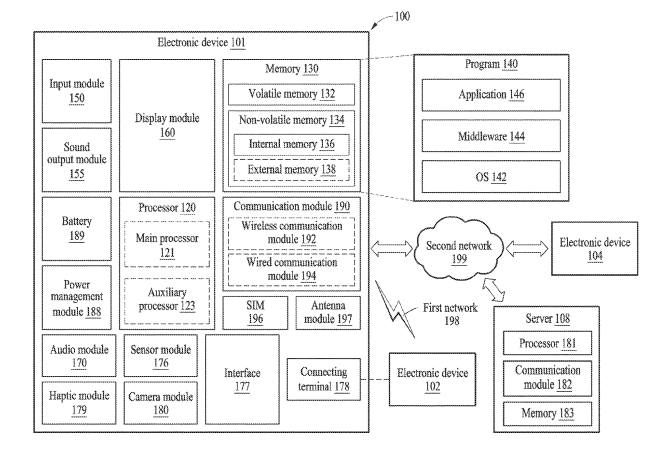

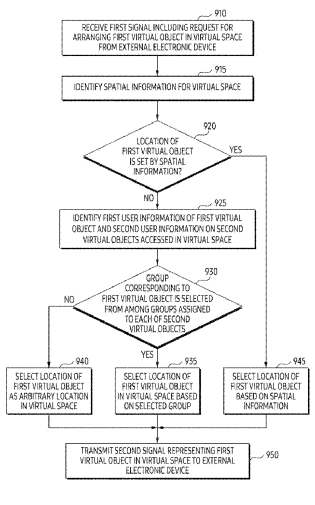

在一个实施例中,专利描述的电子设备包括至少一个处理器,处理器配置为从外部电子设备接收第一信号,第一信号包括用于在虚拟空间中布置第一虚拟对象的请求。所述至少一个处理器配置为通过使用关于第一虚拟对象的第一用户信息和关于第二虚拟对象的第二用户信息,在分别对应于第二虚拟对象的组中获得与第一虚拟对象对应的组。至少一个处理器配置为基于包括在与第一虚拟对象相对应的组中的至少一个第二虚拟对象的位置来识别虚拟空间中的第一位置。所述至少一个处理器配置为向所述外部电子设备发送第二信号,所述第二信号表示布置在所述虚拟空间中的所识别的第一位置中的所述第一虚拟对象。

19. 《

Samsung Patent | Electronic device for providing at least one multimedia content to users accessing object and method thereof(三星专利:用于向访问对象的用户提供至少一个多媒体内容的电子设备及其方法)

》

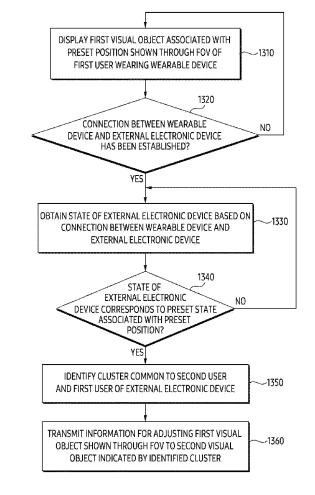

在一个实施例中,可穿戴设备的处理器显示与通过第一用户视场观看的位置相关联的第一视觉对象。处理器基于识别连接到可穿戴设备的外部电子设备来获得外部电子设备的状态。处理器基于与用于显示与该位置相关联的视觉对象的预设状态相对应的外部电子设备的状态,识别外部电子设备中的第一用户和第二用户共有的聚类。处理器基于所识别的聚类,将通过FoV观看的第一视觉对象调整为由聚类指示的第二视觉对象。

20. 《

Sony Patent | Information processing apparatus, information processing method, and system(索尼专利:信息处理设备、信息处理方法和系统)

》

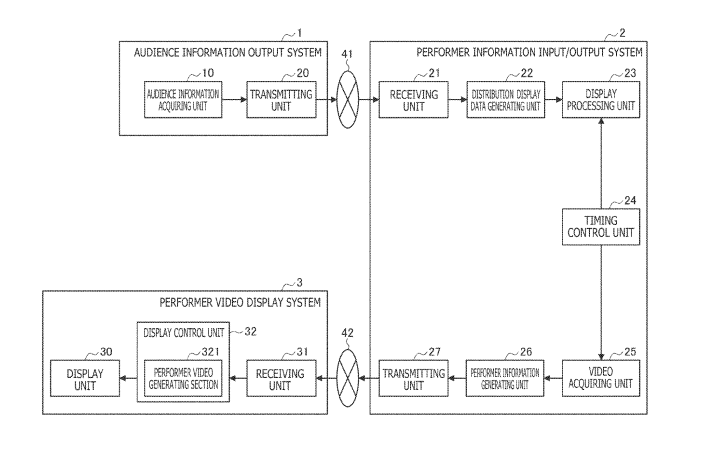

在一个实施例中,专利描述的信息处理设备包括控制部分,所述控制部分利用用于获取关于被摄体的三维信息的多个图像捕获部分来执行图像捕获的控制,以及显示控制以在位于被摄体周围的一个或多个显示区域中显示从外部获取的图像。其中所述控制部件执行控制,使得执行图像捕获时的定时和在显示区域中显示从外部获得的图像时的定时彼此不同。

21. 《

Sony Patent | Dynamic transmission parameter values for retransmissions(索尼专利:用于重传的动态传输参数值)

》

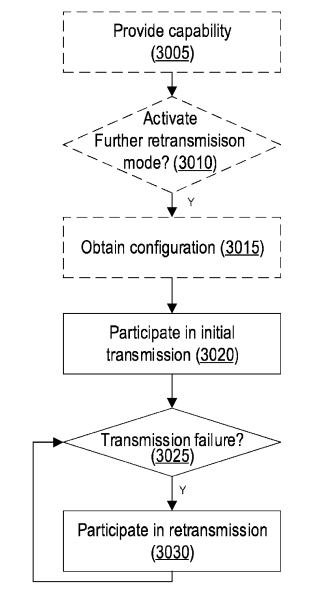

在一个实施例中,专利描述的无线通信设备与通信网络的节点进行数据通信。所述方法包括使用传输参数的第一值参与传输块的多个代码块组的初始传输。多个代码块组分别包括数据的一部分;使用传输参数的一个或多个第二值来参与对多个代码块组中的至少一个的一次或多次重传。第一值不同于一个或多个第二值中的至少一个。

22. 《

Sony Patent | Information processing apparatus, information processing method, and information processing system(索尼专利:信息处理设备、信息处理方法和信息处理系统)

》

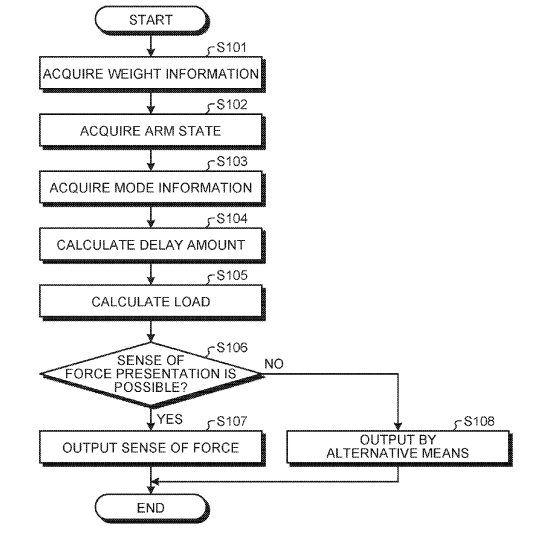

在一个实施例中,专利描述的信息处理设备包括信息获取单元和力感控制单元,信息获取单元获取与用户对叠加并显示在真实空间或虚拟空间上的虚拟对象执行的操作有关的操作信息,力感控制单元基于操作信息经由附接到用户身体的一部分的力感装置输出用于使用户识别体重的力感。

23. 《

Sony Patent | Image processing apparatus and image processing method(索尼专利:图像处理设备和图像处理方法)

》

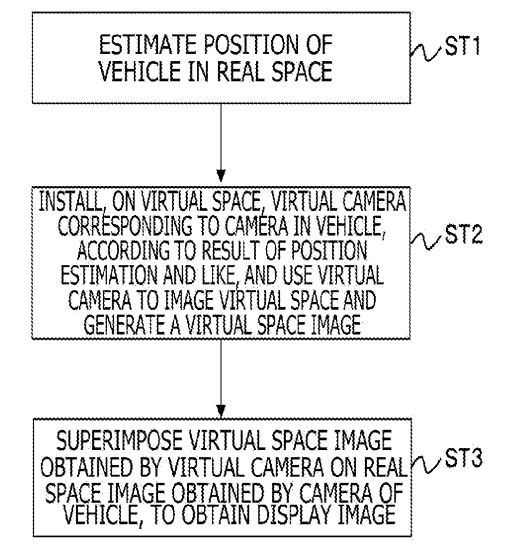

在一个实施例中,图像生成部分参考

CG

数据生成与成像部分在真实空间上的成像范围相对应的虚拟空间图像。例如,以与真实空间上的成像部分相对应的方式将虚拟成像部分组装在虚拟空间,并且对虚拟空间的CG对象进行成像以生成虚拟空间图像。图像叠加部分将虚拟空间图像叠加在通过成像部分对真实空间上的对象成像而获得的真实空间图像之上,从而获得显示图像。

24. 《

Sony Patent | Event driven sensor (eds) tracking of light emitting diode (led) array(索尼专利:事件驱动传感器追踪LED阵列)

》

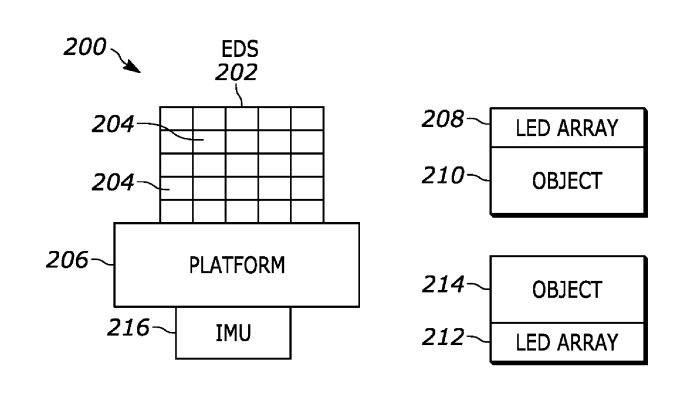

在一个实施例中,事件驱动传感器EDS用于SLAM,特别是与LED阵列一起使用,以同时定位所有LED并追踪EDS在空间中的姿态。EDS可以是固定的或可移动的,并且可以作为刚体来追踪可移动的LED阵列。使用最小的计算资源(无图像处理)以高速率区分每个单独的LED。因此,代替摄像头和图像处理,EDS检测到的快速脉冲LED用于特征点,使得EDS事件一次只与一个LED相关。

25. 《

Sony Patent | Inferring vr body movements including vr torso translational movements from foot sensors on a person whose feet can move but whose torso is stationary(索尼专利:从脚可以移动但躯干静止的人身上的脚步传感器推断VR身体运动)

》

在一个实施例中,相应的姿势和运动传感器与坐着的人的左脚和右脚接合,并且来自传感器的信号用于控制呈现在例如该人佩戴的头戴式显示器的VR对象的运动。传感器信号可以映射到VR对象的平移、旋转和仰角运动,和/或可以用于选择控制以将类似控制器的信号发送到游戏引擎以控制VR对象。

26. 《

Qualcomm Patent | Communicating pre-rendered media(高通专利:传播预渲染的媒体)

》

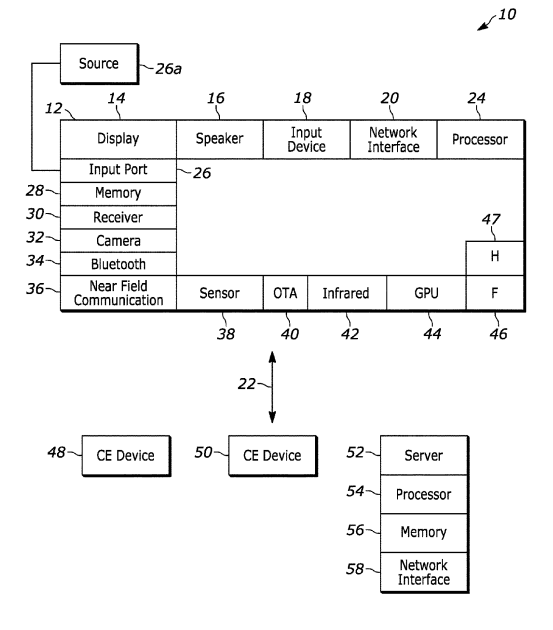

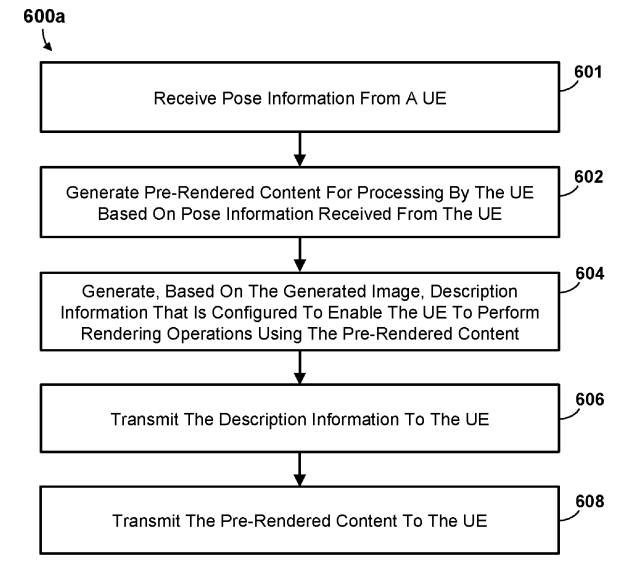

在一个实施例中,用于将渲染媒体传送到用户设备UE的方法可以包括:基于从UE接收到的姿势信息来生成用于由UE处理的预渲染内容,基于预渲染内容来生成配置为使得UE能够使用预渲染内容执行渲染操作的描述信息,以及向UE发送描述信息和预渲染内容。

27. 《

Qualcomm Patent | Augmented reality enhanced media(高通专利:增强现实增强媒体)

》

在一个实施例中,专利描述的过程可以包括:为与应用引擎的应用状态相关联的应用引擎生成第一媒体内容元素;为所述应用引擎生成与所述应用程序引擎的所述应用状态相关联的第二媒体内容元素;在第一设备的第一显示器显示所述第一媒体内容元素;以及相对于第一设备的第一显示器的姿势输出第二媒体内容元素以在第二设备的第二显示器显示。

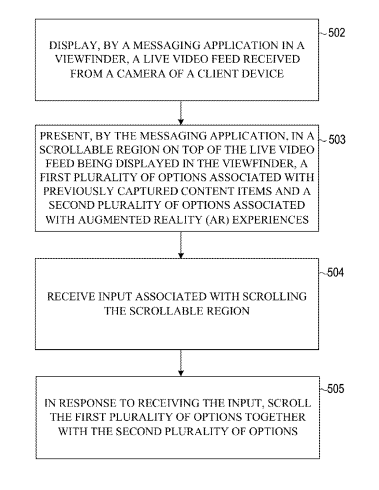

28. 《

Snap Patent | Navigating previously captured images and ar experiences(Snap专利:浏览以前拍摄的图像和AR体验)

》

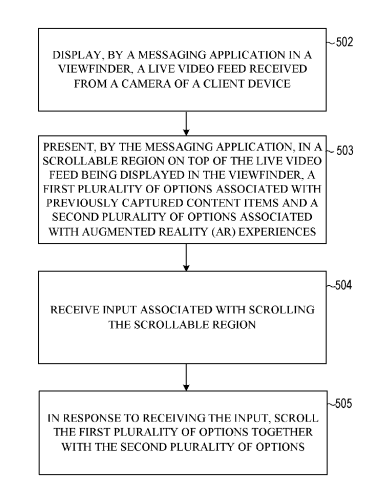

在一个实施例中,专利描述了用于导航图像和AR体验的系统和方法。所述方法执行包括通过取景器中的消息应用程序显示从客户端设备摄像头接收的实时视频馈送的操作。所述操作包括由消息收发应用程序在取景器中显示的实时视频馈送顶部的可滚动区域中呈现与先前捕获内容项目相关联的第一多个选项,以及与增强现实AR体验相关联的第二多个选项。操作包括接收与滚动可滚动区域相关联的输入,并且响应于接收到输入,将第一多个选项与第二多个选项一起滚动。

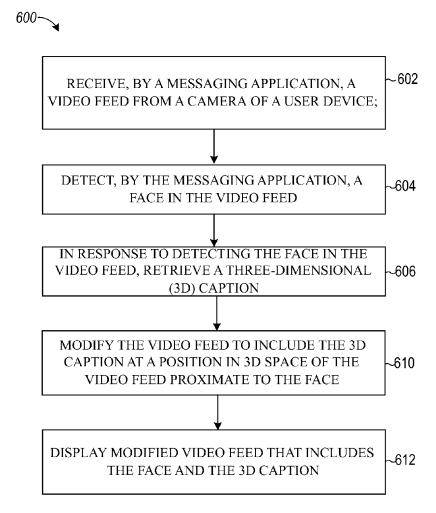

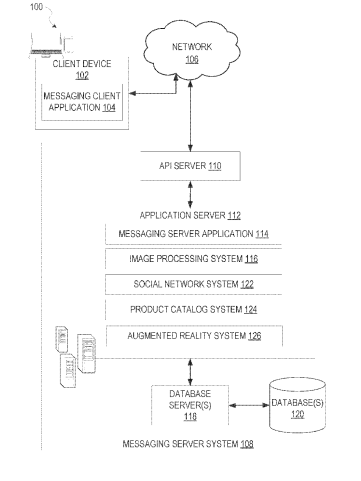

29. 《

Snap Patent | 3d captions with semantic graphical elements(Snap专利:具有语义图形元素的三维字幕)

》

在一个实施例中,专利描述的操作包括:通过消息收发应用接收来自描绘面部的用户设备摄像头的视频馈送;接收向所述视频馈送添加3D字幕的请求;识别与所述3D字幕的情景相关联的图形元素;以及在视频馈送的3D空间中靠近视频馈送中所描绘的面部的位置处显示视频馈送中的3D字幕和所识别的图形元素。

30. 《

Snap Patent | Augmented reality experiences for physical products in a messaging system(Snap专利:消息系统中物理产品的增强现实体验)

》

在一个实施例中,多个可用的增强现实内容生成器中选择一组增强现实内容发生器,所选择的增强现实属性发生器包括用于基于产品提供增强现实内容的至少一个增强现实属性生成器。可以显示可选图形项目的转盘界面,每个可选图形项目对应于相应的增强现实内容生成器。在客户端设备处接收对多个可选图形项目中的第一可选图形项目的选择。将与所选择的第一可选图形项目相对应的第一增强现实内容生成器应用于第一图像数据。引起第二图像数据的显示,第二图像图像数据包括将第一增强现实内容生成器应用于第一图像数据。

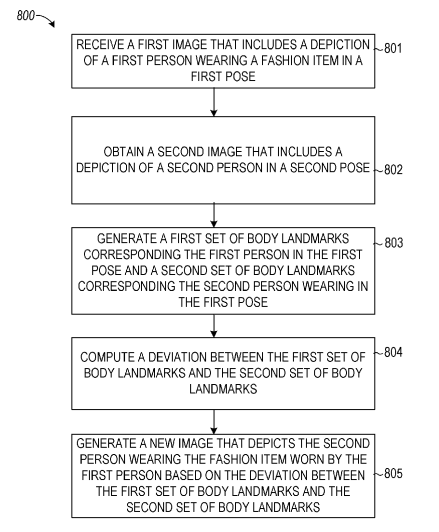

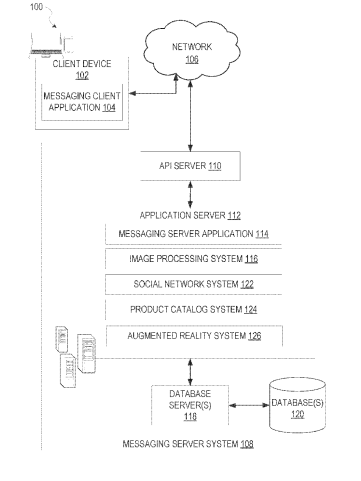

31. 《

Snap Patent | Real-time try-on using body landmarks(Snap专利:实时试用身体标志)

》

在一个实施例中,使用身体标志将衣服从一个真实世界对象实时转移到另一个现实世界对象。系统接收第一图像,第一图像包括以第一姿势穿着时尚物品的第一人的描绘。系统获得包括对处于第二姿势的第二个人的描绘的第二图像,并且生成与处于第一姿势的第一个人相对应的第一组身体标志和与处于第一姿态的第二人相对应的第二组身体标志。系统计算第一组身体标志和第二组身体标志之间的偏差。系统基于第一组身体标志和第二组身体标志之间的偏差生成新图像,新图像描绘穿着第一人所穿的时尚物品的第二人。

32. 《

Snap Patent | Identification of physical products for augmented reality experiences in a messaging system(Snap专利:在消息系统中识别用于增强现实体验的物理产品)

》

在一个实施例中,接收包括物理项目的表示的图像数据。分析图像数据以确定与物理项目相对应的对象。基于所确定的对象来提取产品元数据。向服务器发送产品元数据以确定与产品元数据相关联的第二产品元数据。从服务器接收第二产品元数据,第二产品元数据包括与物理项目相关的附加信息。使得至少部分地基于第二产品元数据在客户端设备处显示与物理项目相关的附加信息。

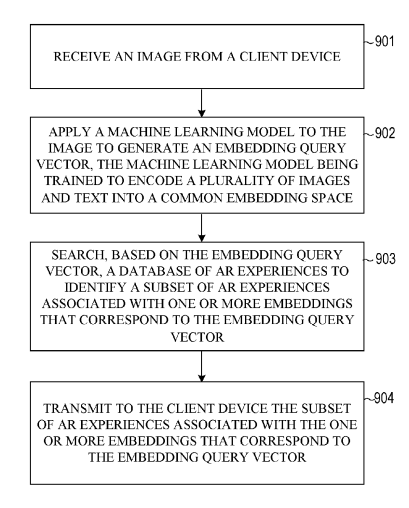

33. 《

Snap Patent | Searching augmented reality experiences using visual embeddings(Snap专利:使用视觉嵌入搜索增强现实体验)

》

在一个实施例中,专利描述的操作包括:从客户端设备接收图像;将机器学习模型应用于所述图像以生成嵌入查询向量,所述机器学习模型被训练为将多个图像和文本编码到公共嵌入空间中;基于所述嵌入查询向量搜索AR体验的数据库,以识别与对应于所述嵌入询问向量的一个或多个嵌入相关联的AR体验的子集;以及向客户端设备发送与对应于嵌入查询向量的一个或多个嵌入相关联的AR体验的子集。

34. 《

Snap Patent | Selectively modifying a gui(Snap专利:选择性修改GUI)

》

在一个实施例中,专利描述的方法由消息应用程序呈现在GUI中显示的实时视频馈送顶部的可滚动区域中。GUI包括取景器、与先前捕获的内容项目相关联的第一多个选项和与AR体验相关联的第二多个选项。系统将所述第一多个选项与所述可滚动区域的所述第二多个选项一起滚动,以将所述第一多个选项中的一个或所述第二多个选项之一聚焦。作为响应,系统根据第一方式修改GUI的配置,或者根据第二方式修改GUI配置。

35. 《

Magic Leap Patent | Method of waking a device using spoken voice commands(Magic Leap专利:使用语音命令唤醒设备的方法)

》

在一个实施例中,专利描述了在混合现实应用中处理语音信号的系统和方法。一种方法可以包括接收音频信号;经由第一处理器确定音频信号是否包括语音开始事件;根据音频信号包括语音开始事件的确定:唤醒一个或多个处理器;经由第二处理器确定所述音频信号包括预定触发信号;根据音频信号包括预定触发信号的确定:唤醒第三处理器;通过第三处理器执行基于音频信号的自动语音识别;以及根据音频信号不包括预定触发信号的确定:放弃唤醒第三处理器;以及根据音频信号不包括语音开始事件的确定:放弃唤醒第二处理器。

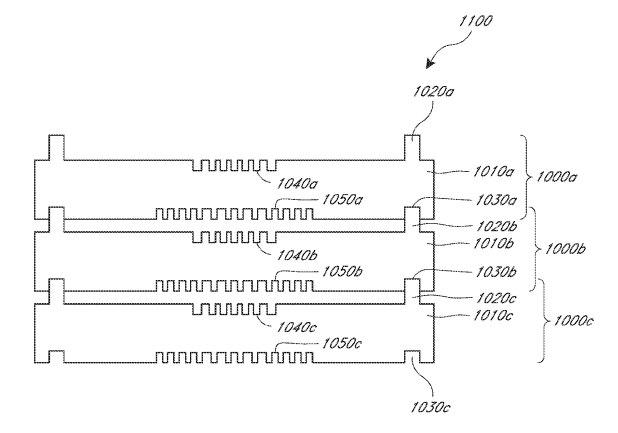

36. 《

Magic Leap Patent | Waveguides having integrated spacers, waveguides having edge absorbers, and methods for making the same(Magic Leap专利:具有集成垫片的波导、具有边缘吸收体的波导及其制造方法)

》

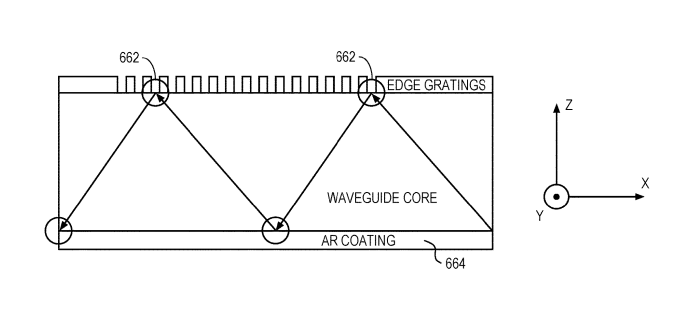

在一个实施例中,头戴式近眼显示系统包括波导的堆叠,所述波导具有分隔波导的整体间隔件。每个波导可以包括衍射光学元件,衍射光学元件通过压印与间隔物同时形成。间隔物设置在每个波导的一个主表面上,并且凹陷提供在每个波导相对的主表面上。凹陷的尺寸和位置设定为与间隔物对准,从而形成波导的自对准堆叠。间隔物的顶部可以设置有光散射特征、抗反射涂层和/或光吸收粘合剂,以防止波导之间的光泄漏。

37. 《

Magic Leap Patent | Anti-reflective coatings on optical waveguides(Magic Leap专利:光波导上的防反射涂层)

》

在一个实施例中,专利描述的抗反射波导组件包括具有第一折射率的波导衬底、设置在波导的第一表面上的多个衍射光学元件和设置在波导第二表面上的抗反射涂层。抗反射涂层优选地增加通过其被施加到波导中的表面的光的吸收,使得至少97%的光被透射。抗反射涂层由四层具有不同折射率的材料组成,第一折射率和虚折射率小于1×10−3,但优选小于5×10−4。

38. 《

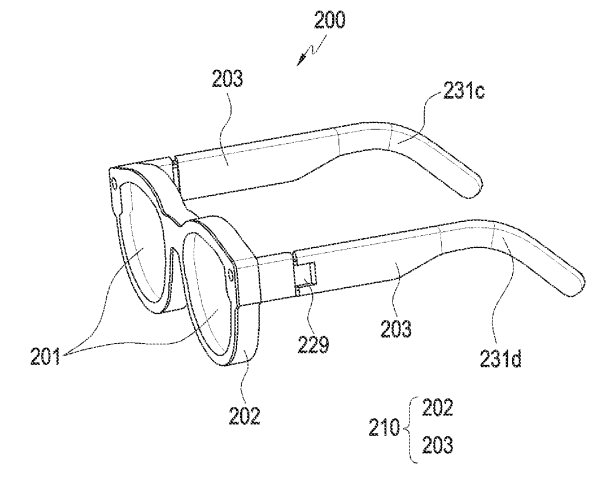

HTC Patent | Wearable device(HTC专利:可穿戴设备)

》

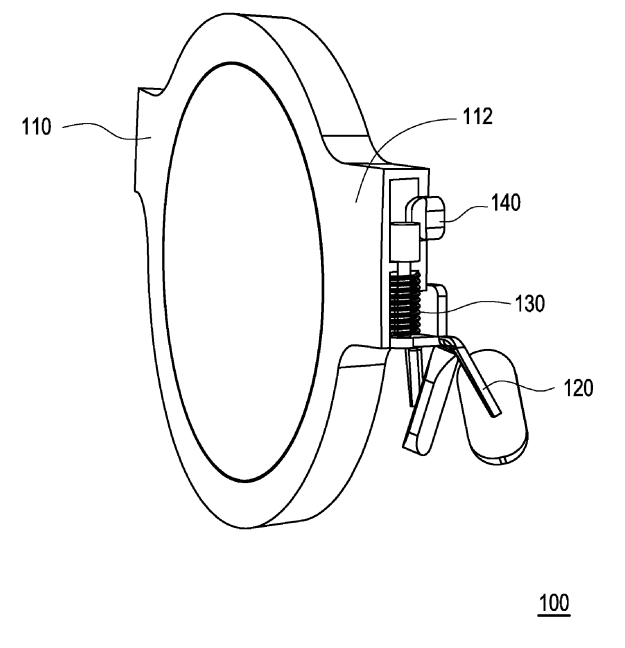

在一个实施例中,专利描述的可穿戴设备包括主体、鼻垫框架、第一弹性元件和固定元件。鼻垫架可移动地设置在鼻梁处。第一弹性元件设置在鼻梁和鼻垫框架之间。固定元件可移动地设置在鼻梁处,用于固定鼻垫框架或允许鼻垫框架移动。

39. 《

HTC Patent | Head-mounted display device and adjustment module(HTC专利:头戴式显示设备和调节模块)

》

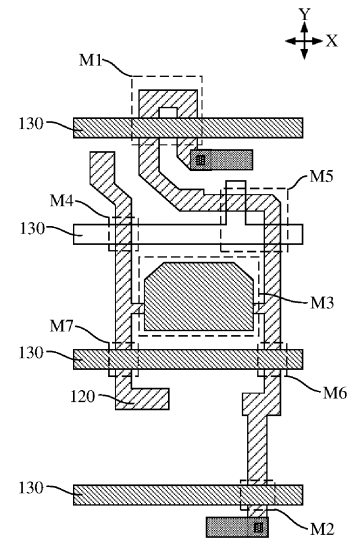

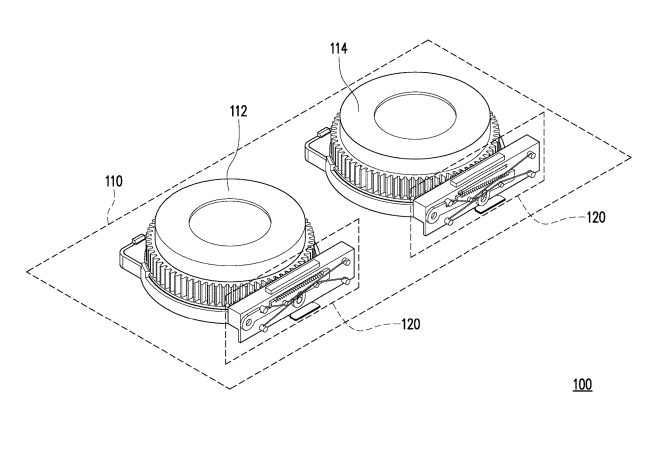

在一个实施例中,专利描述了一种头显和调节模块。头显包括主体和两个调节模块。所述两个调节模块配置为组装到机身的两个变焦透镜组。每个调节模块包括底座、滑块、第一形状记忆合金(SMA)元件、第一恢复元件、制动元件、第二SMA元件和第二恢复元件。第一SMA元件连接在基座和滑块的致动端之间,并且配置为致动滑块,使得滑块的传输端驱动变焦透镜组进行变焦。第一恢复元件连接在基座和致动端之间,并且配置为当第一SMA元件处于断电状态时将滑块保持在原始位置。当致动元件处于致动位置时,致动元件与滑块的致动端接合。当致动元件处于可移动位置时,致动元件与致动端分离。第二SMA元件连接在基座和致动元件之间,并且配置为致动致动元件以在致动位置和可移动位置之间移动。第二恢复元件连接在基座和致动元件之间,并且配置为当第二SMA元件处于断电状态时将致动元件保持在致动位置或可移动位置。

40. 《

HTC Patent | Tracking system and calibration method(HTC专利:追踪系统和校准方法)

》

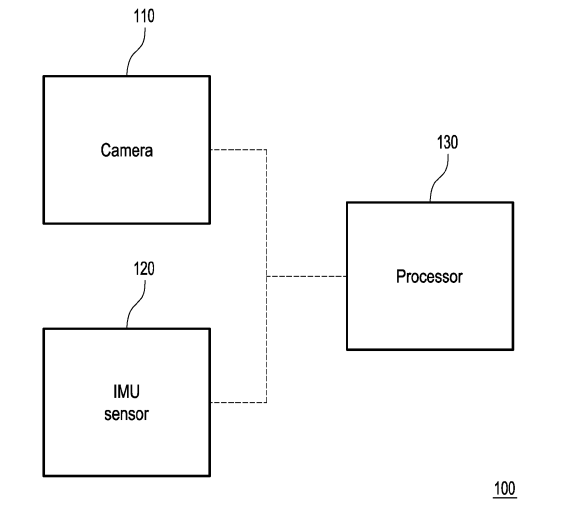

在一个实施例中,摄像头配置为获得包括用户身体部分的身体图像的摄像头数据。IMU传感器配置为获得传感器数据。处理器配置为基于摄像头数据或传感器数据来确定身体部分是静态的还是动态的。响应于身体部分是静态的,处理器配置为基于摄像头数据确定身体部分的当前姿势的姿势置信度,并基于姿势置信度和摄像头数据校准传感器数据的累积误差。响应于主体部分是动态的,处理器配置为基于第一移动轨迹和第二移动轨迹来校准累积误差。处理器配置为基于传感器数据来跟踪身体部分。

41. 《

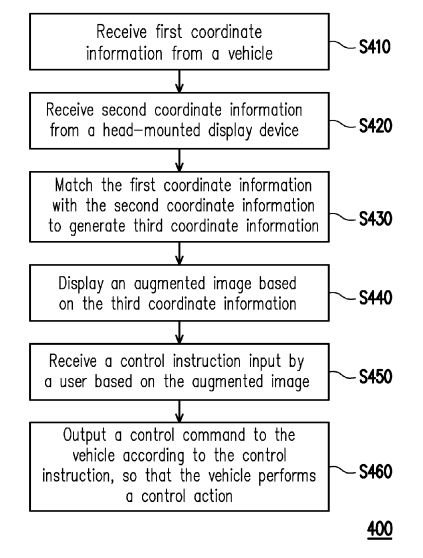

HTC Patent | Vehicle control system, head-mounted display device, and vehicle control method(HTC专利:车辆控制系统、头戴式显示设备和车辆控制方法)

》

在一个实施例中,专利描述的车辆控制系统包括车辆和头戴式显示设备。车辆用于提供第一坐标信息。头戴式显示设备用于提供和显示第二坐标信息。响应于头戴式显示设备接收到第一坐标信息,头戴式显示器设备将第一坐标信息与第二坐标信息相匹配,以提供第三坐标信息并基于第三坐标信号显示增强图像。响应于头戴式显示设备接收到用户基于增强图像输入的控制指令,头戴式显示器设备向车辆输出控制命令,使得车辆执行控制动作。